Понятие

регрессии.

Зависимость между переменными величинами

x

и

y

может быть описана разными способами.

В частности, любую форму связи можно

выразить уравнением общего вида

гдеy

рассматривается в качестве зависимой

переменной, или функции

от другой – независимой переменной

величины x, называемой аргументом.

Соответствие между аргументом и функцией

может быть задано таблицей, формулой,

графиком и т.д. Изменение функции в

зависимости от изменения одного или

нескольких аргументов называется

регрессией.

Все средства, применяемые для описания

корреляционных связей, составляет

содержание регрессионного

анализа.

Для

выражения регрессии служат корреляционные

уравнения, или уравнения регрессии,

эмпирические и теоретически вычисленные

ряды регрессии, их графики, называемые

линиями регрессии, а также коэффициенты

линейной и нелинейной регрессии.

Показатели

регрессии выражают корреляционную

связь двусторонне, учитывая изменение

усредненных значений

при изменении значений xi

признака X,

и, наоборот, показывают изменение средних

значений

по измененным значениям yi

признака Y.

Исключение составляют временные ряды,

или ряды динамики, показывающие изменение

признаков во времени. Регрессия таких

рядов является односторонней.

Различных

форм и видов корреляционных связей

много. Задача сводится к тому, чтобы в

каждом конкретном случае выявить форму

связи и выразить ее соответствующим

корреляционным уравнением, что позволяет

предвидеть возможные изменения одного

признака Y

на основании известных изменений другого

X,

связанного с первым корреляционно.

12.1 Линейная регрессия

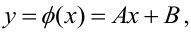

Уравнение

регрессии.

Результаты наблюдений, проведенных над

тем или иным биологическим объектом по

корреляционно связанным признакам x

и

y,

можно изобразить точками на плоскости,

построив систему прямоугольных координат.

В результате получается некая диаграмма

рассеяния, позволяющая судить о форме

и тесноте связи между варьирующими

признаками. Довольно часто эта связь

выглядит в виде прямой или может быть

аппроксимирована прямой линией.

Линейная

зависимость между переменными x

и

y

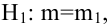

описывается уравнением общего вида

гдеa,

b, c, d,

… – параметры уравнения, определяющие

соотношения между аргументами x1,

x2,

x3,

…, xm

и функций

В

практике учитывают не все возможные, а

лишь некоторые аргументы, в простейшем

случае – всего один:

В

уравнении линейной регрессии (1) a

– свободный член, а параметр b

определяет наклон линии регрессии по

отношению к осям прямоугольных координат.

В аналитической геометрии этот параметр

называют угловым

коэффициентом,

а в биометрии – коэффициентом

регрессии.

Наглядное представление об этом параметре

и о положении линий регрессии Y

по X

и X

по Y

в системе прямоугольных координат дает

рис.1.

Рис.

1 Линии регрессии Y по X и X поY в системе

прямоугольных

координат

Линии

регрессии, как показано на рис.1,

пересекаются в точке О (

соответствующей средним арифметическим

значениям корреляционно связанных друг

с другом признаковY

и X.

При построении графиков регрессии по

оси абсцисс откладывают значения

независимой переменной X, а по оси ординат

– значения зависимой переменной, или

функции Y. Линия АВ, проходящая через

точку О (

соответствует полной (функциональной)

зависимости между переменными величинамиY

и X,

когда коэффициент корреляции

Чем сильнее связь междуY

и X,

тем ближе линии регрессии к АВ, и,

наоборот, чем слабее связь между этими

величинами, тем более удаленными

оказываются линии регрессии от АВ. При

отсутствии связи между признаками линии

регрессии оказываются под прямым углом

по отношению друг к другу и

Поскольку

показатели регрессии выражают

корреляционную связь двусторонне,

уравнение регрессии (1) следует записывать

так:

По

первой формуле определяют усредненные

значения

на единицу меры, по второй – усредненные

значения

Коэффициент

регрессии.

Коэффициент регрессии показывает,

насколько в среднем величина одного

признака y

изменяется при изменении на единицу

меры другого, корреляционно связанного

с Y

признака X.

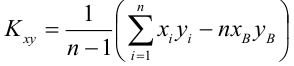

Этот показатель определяют по формуле

Здесь

значения s

умножают на размеры классовых интервалов

λ,

если их находили по вариационным рядам

или корреляционным таблицам.

Коэффициент

регрессии можно вычислить минуя расчет

средних квадратичных отклонений sy

и sx

по формуле

Если

же коэффициент корреляции неизвестен,

коэффициент регрессии определяют

следующим образом:

(5)

Связь

между коэффициентами регрессии и

корреляции.

Сравнивая формулы (11.1) (тема 11) и (12.5),

видим: в их числителе одна и та же величина

что указывает на наличие связи между

этими показателями. Эта связь выражается

равенством

Таким

образом, коэффициент корреляции равен

средней геометрической из коэффициентов

byx

и bxy.

Формула (6) позволяет, во-первых, по

известным значениям коэффициентов

регрессии byx

и bxy

определять коэффициент регрессии Rxy,

а во-вторых, проверять правильность

расчета этого показателя корреляционной

связи Rxy

между варьирующими признаками X

и Y.

Как

и коэффициент корреляции, коэффициент

регрессии характеризует только линейную

связь и сопровождается знаком плюс при

положительной и знаком минус при

отрицательной связи.

Определение

параметров линейной регрессии.

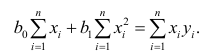

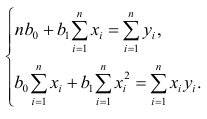

Известно, что сумма квадратов отклонений

вариант xi

от средней

Эта теорема составляет основу метода

наименьших квадратов. В отношении

линейной регрессии [см. формулу (1)]

требованию этой теоремы удовлетворяет

некоторая система уравнений, называемыхнормальными:

Совместное

решение этих уравнений относительно

параметров a

и b

приводит к следующим результатам:

откуда

Учитывая

двусторонний характер связи между

переменными Y

и X,

формулу для определения параметра а

следует выразить так:

Параметр

b,

или коэффициент регрессии, определяют

по следующим формулам:

В

практической работе рекомендуется

использовать следующие формулы:

(9)

Построение

эмпирических рядов регрессии.

При наличии большого числа наблюдений

регрессионный анализ начинается с

построения эмпирических рядов регрессии.

Эмпирический

ряд регрессии

образуется путем вычисления по значениям

одного варьирующего признака X

средних значений

связанного корреляционно сX

признака Y.

Иными словами, построение эмпирических

рядов регрессии сводится к нахождению

групповых средних

и X.

Эмпирический

ряд регрессии – это двойной ряд чисел,

которые можно изобразить точками на

плоскости, а затем, соединив эти точки

отрезками прямой, получить эмпирическую

линию регрессии. Эмпирические ряды

регрессии, особенно их графики, называемые

линиями

регрессии,

дают наглядное представление о форме

и тесноте корреляционной зависимости

между варьирующими признаками.

Выравнивание

эмпирических рядов регрессии.

Графики эмпирических рядов регрессии

оказываются, как правило, не плавно

идущими, а ломаными линиями. Это

объясняется тем, что наряду с главными

причинами, определяющими общую

закономерность в изменчивости

коррелируемых признаков, на их величине

сказывается влияние многочисленных

второстепенных причин, вызывающих

случайные колебания узловых точек

регрессии. Чтобы выявить основную

тенденцию (тренд) сопряженной вариации

коррелируемых признаков, нужно заменить

ломанные линии на гладкие, плавно идущие

линии регрессии. Процесс замены ломанных

линий на плавно идущие называют

выравниванием

эмпирических рядов

и линий

регрессий.

Графический

способ выравнивания.

Это наиболее простой способ, не требующий

вычислительной работы. Его сущность

сводится к следующему. Эмпирический

ряд регрессии изображают в виде графика

в системе прямоугольных координат.

Затем визуально намечаются средние

точки регрессии, по которым с помощью

линейки или лекала проводят сплошную

линию. Недостаток этого способа очевиден:

он не исключает влияние индивидуальных

свойств исследователя на результаты

выравнивания эмпирических линий

регрессии. Поэтому в тех случаях, когда

необходима более высокая точность при

замене ломанных линий регрессии на

плавно идущие, используют другие способы

выравнивания эмпирических рядов.

Способ

скользящей средней.

Суть этого способа сводится к

последовательному вычислению средних

арифметических из двух или трех соседних

членов эмпирического ряда. Этот способ

особенно удобен в тех случаях, когда

эмпирический ряд представлен большим

числом членов, так что потеря двух из

них – крайних, что неизбежно при этом

способе выравнивания, заметно не

отразится на его структуре.

Метод

наименьших квадратов.

Этот способ предложен в начале XIX

столетия А.М. Лежандром и независимо от

него К. Гауссом. Он позволяет наиболее

точно выравнивать эмпирические ряды.

Этот метод, как было показано выше,

основан на предположении, что сумма

квадратов отклонений вариант xi

от

их средней

Отсюда и название метода, который

применяется не только в экологии, но и

в технике. Метод наименьших квадратов

объективен и универсален, его применяют

в самых различных случаях при отыскании

эмпирических уравнений рядов регрессии

и определении их параметров.

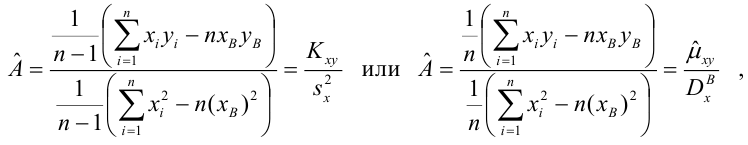

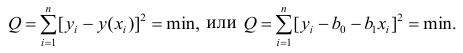

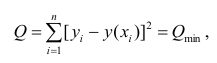

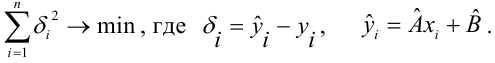

Требование

метода наименьших квадратов заключается

в том, что теоретические точки линии

регрессии

чтобы сумма квадратов отклонений от

этих точек для эмпирических наблюденийyi

была минимальной, т.е.

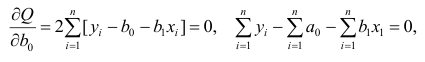

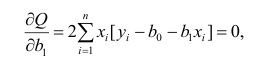

Вычисляя

в соответствии с принципами математического

анализа минимум этого выражения и

определенным образом преобразуя его,

можно получить систему так называемых

нормальных

уравнений,

в которых неизвестными величинами

оказываются искомые параметры уравнения

регрессии, а известные коэффициенты

определяются эмпирическими величинами

признаков, обычно суммами их значений

и их перекрестных произведений.

Множественная

линейная регрессия.

Зависимость между несколькими переменными

величинами принято выражать уравнением

множественной регрессии, которая может

быть линейной

и нелинейной.

В простейшем виде множественная регрессия

выражается уравнением с двумя независимыми

переменными величинами (x,

z):

где

a

– свободный член уравнения; b

и c

– параметры уравнения. Для нахождения

параметров уравнения (10) (по способу

наименьших квадратов) применяют следующую

систему нормальных уравнений:

Ряды

динамики.

Выравнивание

рядов.

Изменение признаков во времени образует

так называемые временные

ряды

или ряды

динамики.

Характерной особенностью таких рядов

является то, что в качестве независимой

переменной X

здесь всегда выступает фактор времени,

а зависимой Y

– изменяющийся признак. В зависимости

от рядов регрессии зависимость между

переменными X

и Y

носит односторонний характер, так как

фактор времени не зависит от изменчивости

признаков. Несмотря на указанные

особенности, ряды динамики можно

уподобить рядам регрессии и обрабатывать

их одними и теми же методами.

Как

и ряды регрессии, эмпирические ряды

динамики несут на себе влияние не только

основных, но и многочисленных второстепенных

(случайных) факторов, затушевывающих

ту главную тенденцию в изменчивости

признаков, которая на языке статистики

называют трендом.

Анализ

рядов динамики начинается с выявления

формы тренда. Для этого временной ряд

изображают в виде линейного графика в

системе прямоугольных координат. При

этом по оси абсцисс откладывают временные

точки (годы, месяцы и другие единицы

времени), а по оси ординат – значения

зависимой переменной Y.

При наличии линейной зависимости между

переменными X

и Y

(линейного тренда) для выравнивания

рядов динамики способом наименьших

квадратов наиболее подходящим является

уравнение регрессии в виде отклонений

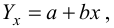

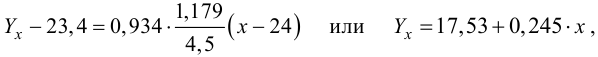

членов ряда зависимой переменной Y

от средней арифметической

Здесь

Числовые

характеристики рядов динамики.

К числу основных обобщающих числовых

характеристик рядов динамики относят

среднюю

геометрическую

скорость, с какой изменяется величина

зависимой переменной за определенные

периоды времени:

Оценкой

изменчивости членов ряда динамики

служит среднее

квадратическое отклонение.

При выборе уравнений регрессии для

описания рядов динамики учитывают форму

тренда, которая может быть линейной

(или приведена к линейной) и нелинейной.

О правильности выбора уравнения регрессии

обычно судят по сходству эмпирически

наблюденных и вычисленных значений

зависимой переменной. Более точным в

решении этой задачи является метод

дисперсионного анализа регрессии (тема

12 п.4).

Корреляция

рядов динамики.

Нередко приходится сопоставлять динамику

параллельно идущих временных рядов,

связанных друг с другом некоторыми

общими условиями, например выяснить

связь между производством сельскохозяйственной

продукции и ростом поголовья скота за

определенный промежуток времени. В

таких случаях характеристикой связи

между переменными X

и Y

служит коэффициент

корреляции

Rxy

(при наличии линейного тренда).

Известно,

что тренд рядов динамики, как правило,

затушевывается колебаниями членов ряда

зависимой переменной Y.

Отсюда возникает задача двоякого рода:

измерение зависимости между сопоставляемыми

рядами, не исключая тренд, и измерение

зависимости между соседними членами

одного и того же ряда, исключая тренд.

В первом случае показателем тесноты

связи между сопоставляемыми рядами

динамики служит коэффициент

корреляции

(если связь линейна), во втором –

коэффициент

автокорреляции.

Эти показатели имеют разные значения,

хотя и вычисляются по одним и тем же

формулам (см. тему 11).

Нетрудно

заметить, что на значении коэффициента

автокорреляции сказывается изменчивость

членов ряда зависимой переменной: чем

меньше члены ряда отклоняются от тренда,

тем выше коэффициент автокорреляции,

и наоборот.

Содержание:

Регрессионный анализ:

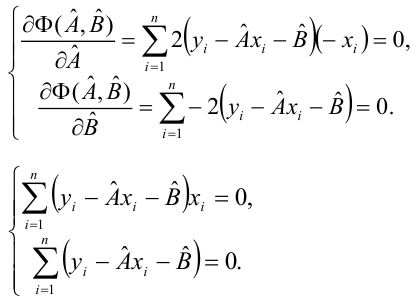

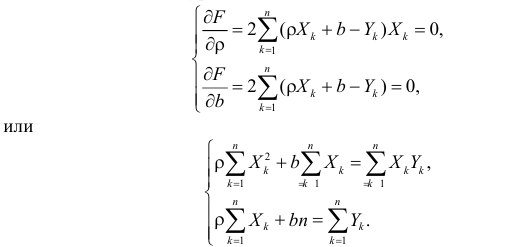

Регрессионным анализом называется раздел математической статистики, объединяющий практические методы исследования корреляционной зависимости между случайными величинами по результатам наблюдений над ними. Сюда включаются методы выбора модели изучаемой зависимости и оценки ее параметров, методы проверки статистических гипотез о зависимости.

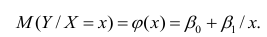

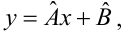

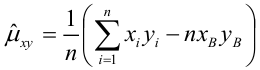

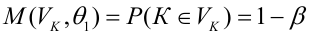

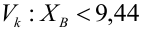

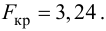

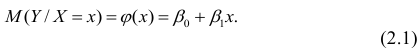

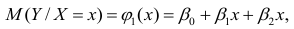

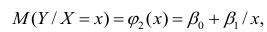

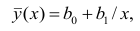

Пусть между случайными величинами X и Y существует линейная корреляционная зависимость. Это означает, что математическое ожидание Y линейно зависит от значений случайной величины X. График этой зависимости (линия регрессии Y на X) имеет уравнение

Линейная модель пригодна в качестве первого приближения и в случае нелинейной корреляции, если рассматривать небольшие интервалы возможных значений случайных величин.

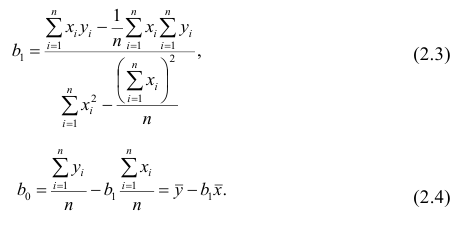

Пусть параметры линии регрессии

Неизвестная нам линия регрессии

Такие значения

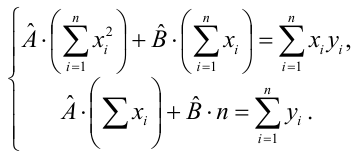

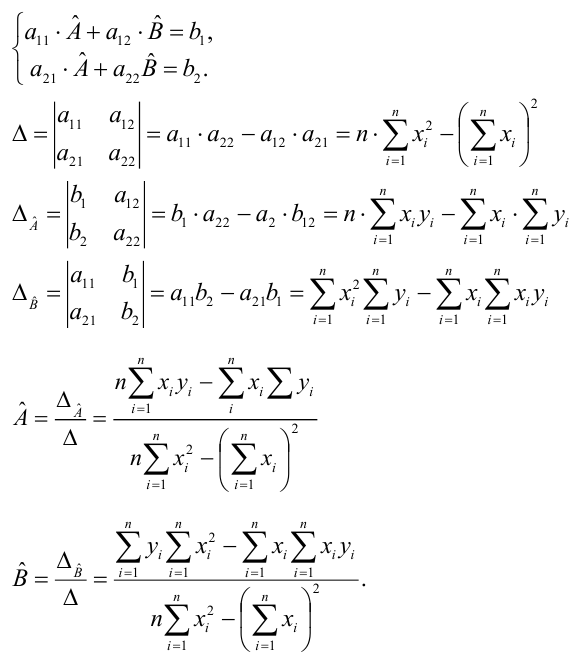

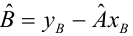

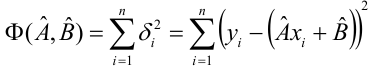

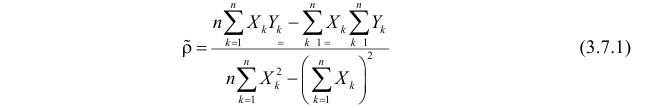

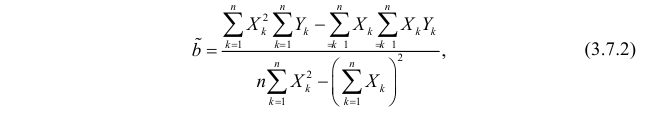

Решения этой системы уравнений дают оценки называемые оценками по методу наименьших квадратов.

и

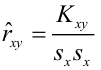

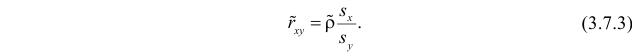

Известно, что оценки по методу наименьших квадратов являются несмещенными и, более того, среди всех несмещенных оценок обладают наименьшей дисперсией. Для оценки коэффициента корреляции можно воспользоваться тем, что

По методу наименьших квадратов можно находить оценки параметров линии регрессии и при нелинейной корреляции. Например, для линии регрессии вида

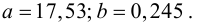

Пример:

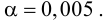

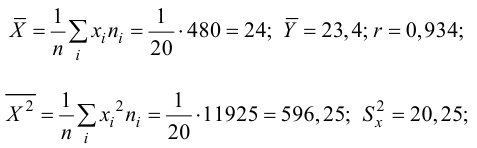

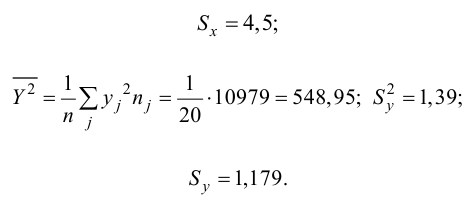

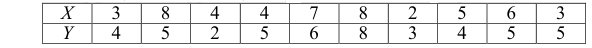

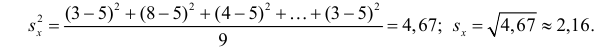

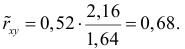

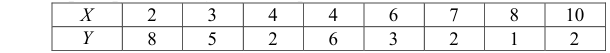

По данным наблюдений двух случайных величин найти коэффициент корреляции и уравнение линии регрессии Y на X

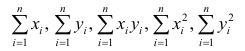

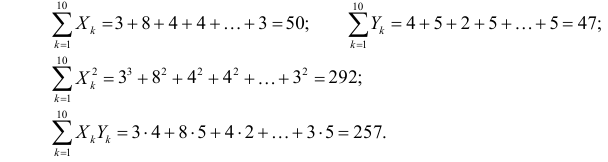

Решение. Вычислим величины, необходимые для использования формул (3.7.1)–(3.7.3):

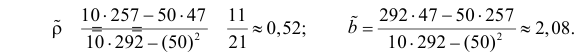

По формулам (3.7.1) и (3.7.2) получим

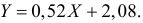

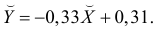

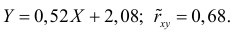

Итак, оценка линии регрессии имеет вид

Аналогично,

Ответ.

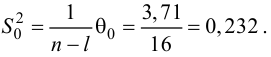

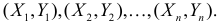

Пример:

Получена выборка значений величин X и Y

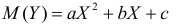

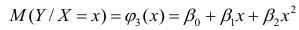

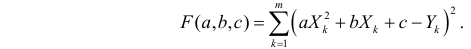

Для представления зависимости между величинами предполагается использовать модель

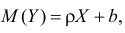

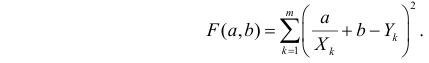

Решение. Рассмотрим сначала задачу оценки параметров этой модели в общем виде. Линия

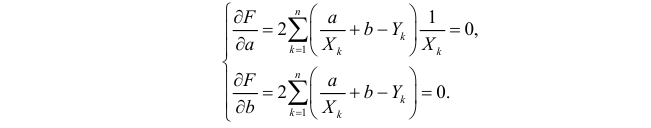

Необходимые условия экстремума приводят к системе из двух уравнений:

Откуда

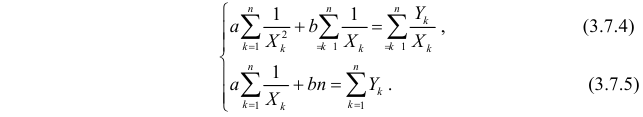

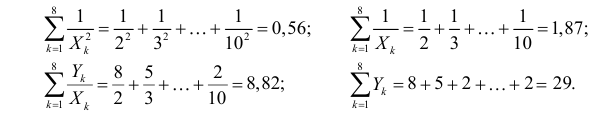

Решения системы уравнений (3.7.4) и (3.7.5) и будут оценками по методу наименьших квадратов для параметров

На основе опытных данных вычисляем:

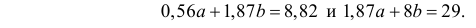

В итоге получаем систему уравнений (?????) и (?????) в виде

Эта система имеет решения

Ответ.

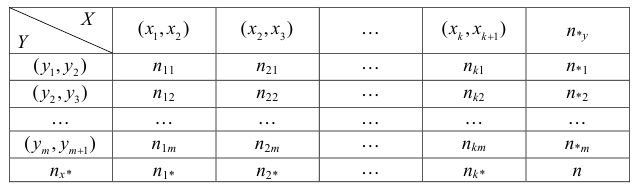

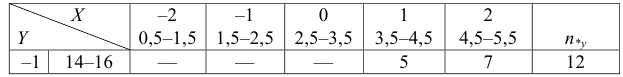

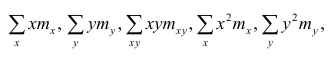

Если наблюдений много, то результаты их обычно группируют и представляют в виде корреляционной таблицы.

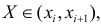

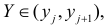

В этой таблице

Если величины дискретны, то вместо интервалов указывают отдельные значения этих величин. Для непрерывных случайных величин представителем каждого интервала считают его середину и полагают, что

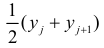

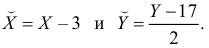

При больших значениях X и Y можно для упрощения вычислений перенести начало координат и изменить масштаб по каждой из осей, а после завершения вычислений вернуться к старому масштабу.

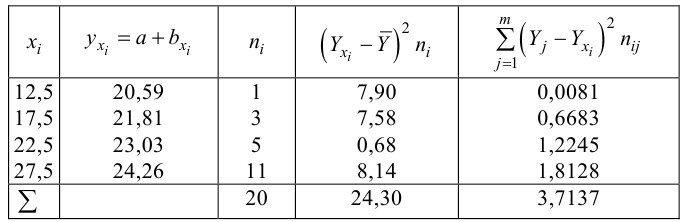

Пример:

Проделано 80 наблюдений случайных величин X и Y. Результаты наблюдений представлены в виде таблицы. Найти линию регрессии Y на X. Оценить коэффициент корреляции.

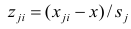

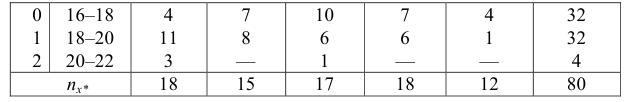

Решение. Представителем каждого интервала будем считать его середину. Перенесем начало координат и изменим масштаб по каждой оси так, чтобы значения X и Y были удобны для вычислений. Для этого перейдем к новым переменным

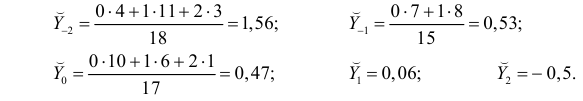

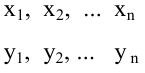

Чтобы иметь представление о виде линии регрессии, вычислим средние значения

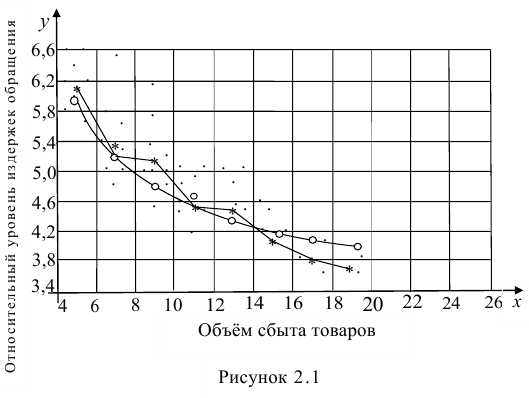

Нанесем эти значения на координатную плоскость, соединив для наглядности их отрезками прямой (рис. 3.7.1).

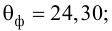

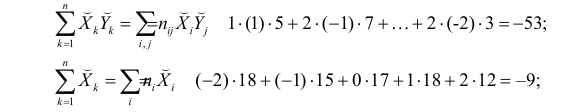

По виду полученной ломанной линии можно предположить, что линия регрессии Y на X является прямой. Оценим ее параметры. Для этого сначала вычислим с учетом группировки данных в таблице все величины, необходимые для использования формул (3.31–3.33):

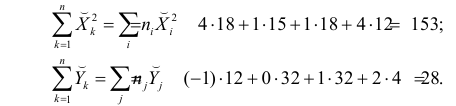

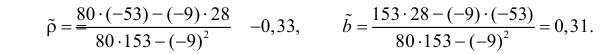

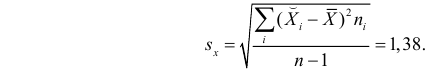

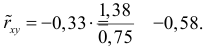

Тогда

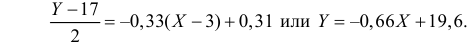

В новом масштабе оценка линии регрессии имеет вид

Для оценки

Подобным же образом можно оценить

Вернемся к старому масштабу:

Коэффициент корреляции пересчитывать не нужно, так как это величина безразмерная и от масштаба не зависит.

Ответ.

Пусть некоторые физические величины X и Y связаны неизвестной нам функциональной зависимостью

Регрессионный анализ

Основные положения регрессионного анализа:

Основная задача регрессионного анализа — изучение зависимости между результативным признаком Y и наблюдавшимся признаком X, оценка функции регрессий.

Предпосылки регрессионного анализа:

- Y — независимые случайные величины, имеющие постоянную дисперсию;

- X— величины наблюдаемого признака (величины не случайные);

- условное математическое ожидание

можно представить в виде

Выражение (2.1), как уже упоминалось в п. 1.2, называется функцией регрессии (или модельным уравнением регрессии) Y на X. Оценке в этом выражении подлежат параметры

Остаточной дисперсией называется та часть рассеивания результативного признака, которую нельзя объяснить действием наблюдаемого признака; Остаточная дисперсия может служить для оценки точности подбора вида функции регрессии (модельного уравнения регрессии), полноты набора признаков, включенных в анализ. Оценки параметров функции регрессии находят, используя метод наименьших квадратов.

В данном вопросе рассмотрен линейный регрессионный анализ. Линейным он называется потому, что изучаем лишь те виды зависимостей

Важное место в линейном регрессионном анализе занимает так называемая «нормальная регрессия». Она имеет место, если сделать предположения относительно закона распределения случайной величины Y. Предпосылки «нормальной регрессии»:

- Y — независимые случайные величины, имеющие постоянную дисперсию и распределенные по нормальному закону;

- X— величины наблюдаемого признака (величины не случайные);

- условное математическое ожидание

можно представить в виде (2.1).

В этом случае оценки коэффициентов регрессии — несмещённые с минимальной дисперсией и нормальным законом распределения. Из этого положения следует что при «нормальной регрессии» имеется возможность оценить значимость оценок коэффициентов регрессии, а также построить доверительный интервал для коэффициентов регрессии и условного математического ожидания M(YX=x).

Линейная регрессия

Рассмотрим простейший случай регрессионного анализа — модель вида (2.1), когда зависимость

по переменным. Оценки параметров модели (2.1)

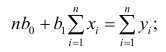

Составим систему нормальных уравнений: первое уравнение

откуда

второе уравнение

откуда

Итак,

Оценки, полученные по способу наименьших квадратов, обладают минимальной дисперсией в классе линейных оценок. Решая систему (2.2) относительно

Остаётся получить оценку параметра

где т — количество наблюдений.

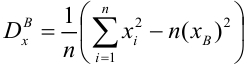

Еслит велико, то для упрощения расчётов наблюдавшиеся данные принята группировать, т.е. строить корреляционную таблицу. Пример построения такой таблицы приведен в п. 1.5. Формулы для нахождения коэффициентов регрессии по сгруппированным данным те же, что и для расчёта по несгруппированным данным, но суммы

где

Нелинейная регрессия

Рассмотрим случай, когда зависимость нелинейна по переменным х, например модель вида

На рис. 2.1 изображено поле корреляции. Очевидно, что зависимость между Y и X нелинейная и её графическим изображением является не прямая, а кривая. Оценкой выражения (2.6) является уравнение регрессии

где

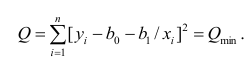

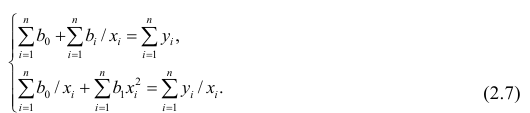

Принцип нахождения коэффициентов тот же — метод наименьших квадратов, т.е.

или

Дифференцируя последнее равенство по

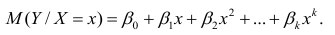

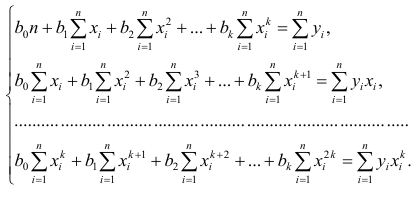

В общем случае нелинейной зависимости между переменными Y и X связь может выражаться многочленом k-й степени от x:

Коэффициенты регрессии определяют по принципу наименьших квадратов. Система нормальных уравнений имеет вид

Вычислив коэффициенты системы, её можно решить любым известным способом.

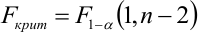

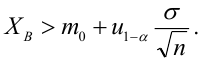

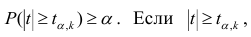

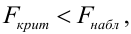

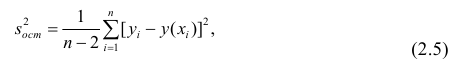

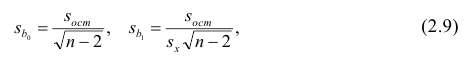

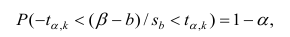

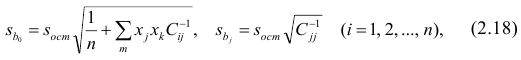

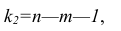

Оценка значимости коэффициентов регрессии. Интервальная оценка коэффициентов регрессии

Проверить значимость оценок коэффициентов регрессии — значит установить, достаточна ли величина оценки для статистически обоснованного вывода о том, что коэффициент регрессии отличен от нуля. Для этого проверяют гипотезу о равенстве нулю коэффициента регрессии, соблюдая предпосылки «нормальной регрессии». В этом случае вычисляемая для проверки нулевой гипотезы

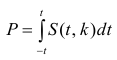

имеет распределение Стьюдента с к= n-2 степенями свободы (b — оценка коэффициента регрессии,

коэффициента регрессии, иначе стандартная ошибка оценки). По уровню значимости а и числу степеней свободы к находят по таблицам распределения Стьюдента (см. табл. 1 приложений) критическое значение

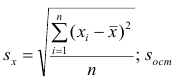

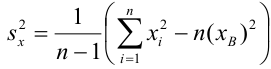

Оценки среднеквадратического отклонения коэффициентов регрессии вычисляют по следующим формулам:

где

формуле (2.5).

Доверительный интервал для значимых параметров строят по обычной схеме. Из условия

где а — уровень значимости, находим

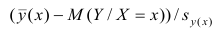

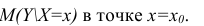

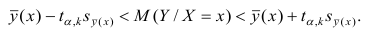

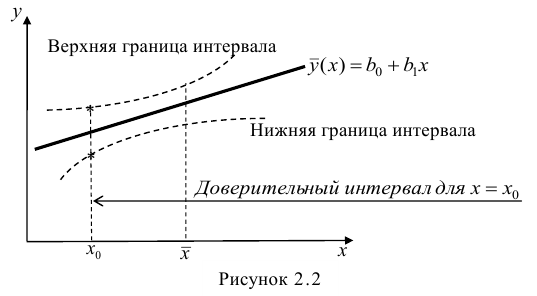

Интервальная оценка для условного математического ожидания

Линия регрессии характеризует изменение условного математического ожидания результативного признака от вариации остальных признаков.

Точечной оценкой условного математического ожидания

построить доверительный интервал в точке

Известно, что

Стьюдента с k=n—2 степенями свободы. Найдя оценку среднеквадратического отклонения для условного среднего, можно построить доверительный интервал для условного математического ожидания

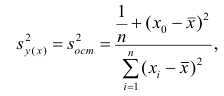

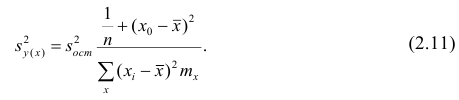

Оценку дисперсии условного среднего вычисляют по формуле

или для интервального ряда

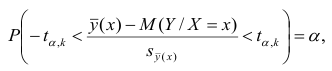

Доверительный интервал находят из условия

где а — уровень значимости. Отсюда

Доверительный интервал для условного математического ожидания можно изобразить графически (рис, 2.2).

Из рис. 2.2 видно, что в точке

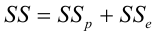

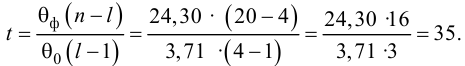

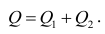

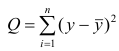

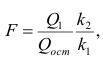

Проверка значимости уравнения регрессии

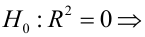

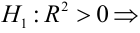

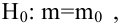

Оценить значимость уравнения регрессии — значит установить, соответствует ли математическая, модель, выражающая зависимость между Y и X, экспериментальным данным. Для оценки значимости в предпосылках «нормальной регрессии» проверяют гипотезу

X) и

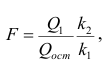

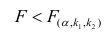

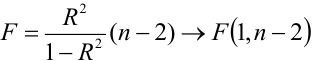

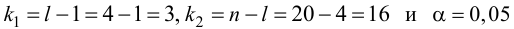

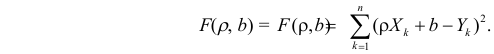

Для проверки нулевой гипотезы вычисляют статистику

Многомерный регрессионный анализ

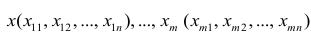

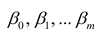

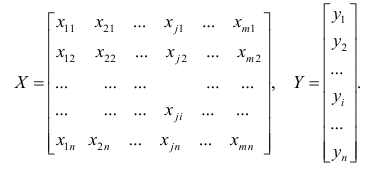

В случае, если изменения результативного признака определяются действием совокупности других признаков, имеет место многомерный регрессионный анализ. Пусть результативный признак У, а независимые признаки

Оценке подлежат параметры

Заменив параметры их оценками, запишем уравнение регрессии

Коэффициенты в этом выражении находят методом наименьших квадратов.

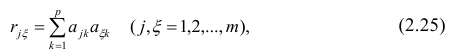

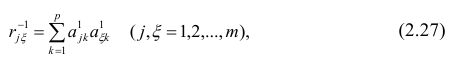

Исходными данными для вычисления коэффициентов

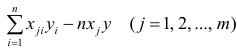

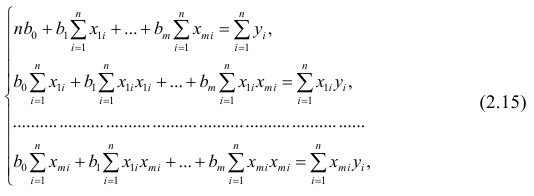

Как и в двумерном случае, составляют систему нормальных уравнений

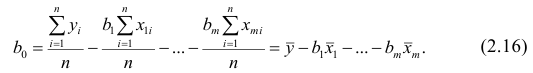

которую можно решить любым способом, известным из линейной алгебры. Рассмотрим один из них — способ обратной матрицы. Предварительно преобразуем систему уравнений. Выразим из первого уравнения значение

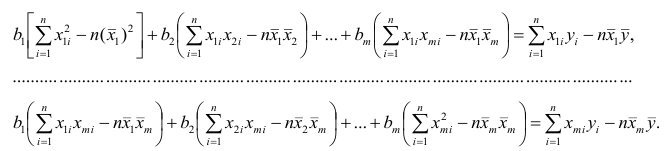

Подставим в остальные уравнения системы вместо

Пусть С — матрица коэффициентов при неизвестных параметрах

запишем окончательные выражения для параметров:

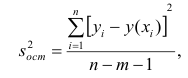

Оценкой остаточной дисперсии

где

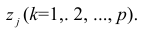

Если выборка получена из нормально распределенной генеральной совокупности, то, аналогично изложенному в п. 2.4, можно проверить значимость оценок коэффициентов регрессии, только в данном случае статистику

где

го столбца;

При заданном уровне значимости а и числе степеней свободы к=n— m—1 по табл. 1 приложений находят критическое значение

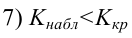

Для значимых коэффициентов регрессии целесообразно построить доверительные интервалы по формуле (2.10). Для оценки значимости уравнения регрессии следует проверить нулевую гипотезу о том, что все коэффициенты регрессии (кроме свободного члена) равны нулю:

Факторный анализ

Основные положения. В последнее время всё более широкое распространение находит один из новых разделов многомерного статистического анализа — факторный анализ. Первоначально этот метод

разрабатывался для объяснения многообразия корреляций между исходными параметрами. Действительно, результатом корреляционного анализа является матрица коэффициентов корреляций. При малом числе параметров можно произвести визуальный анализ этой матрицы. С ростом числа параметра (10 и более) визуальный анализ не даёт положительных результатов. Оказалось, что всё многообразие корреляционных связей можно объяснить действием нескольких обобщённых факторов, являющихся функциями исследуемых параметров, причём сами обобщённые факторы при этом могут быть и неизвестны, однако их можно выразить через исследуемые параметры.

Один из основоположников факторного анализа Л. Терстоун приводит такой пример: несколько сотен мальчиков выполняют 20 разнообразных гимнастических упражнений. Каждое упражнение оценивают баллами. Можно рассчитать матрицу корреляций между 20 упражнениями. Это большая матрица размером 20><20. Изучая такую матрицу, трудно уловить закономерность связей между упражнениями. Нельзя ли объяснить скрытую в таблице закономерность действием каких-либо обобщённых факторов, которые в результате эксперимента непосредственно, не оценивались? Оказалось, что обо всех коэффициентах корреляции можно судить по трём обобщённым факторам, которые и определяют успех выполнения всех 20 гимнастических упражнений: чувство равновесия, усилие правого плеча, быстрота движения тела.

Дальнейшие разработки факторного анализа доказали, что этот метод может быть с успехом применён в задачах группировки и классификации объектов. Факторный анализ позволяет группировать объекты со сходными сочетаниями признаков и группировать признаки с общим характером изменения от объекта к объекту. Действительно, выделенные обобщённые факторы можно использовать как критерии при классификации мальчиков по способностям к отдельным группам гимнастических упражнений.

Методы факторного анализа находят применение в психологии и экономике, социологии и экономической географии. Факторы, выраженные через исходные параметры, как правило, легко интерпретировать как некоторые существенные внутренние характеристики объектов.

Факторный анализ может быть использован и как самостоятельный метод исследования, и вместе с другими методами многомерного анализа, например в сочетании с регрессионным анализом. В этом случае для набора зависимых переменных наводят обобщённые факторы, которые потом входят в регрессионный анализ в качестве переменных. Такой подход позволяет сократить число переменных в регрессионном анализе, устранить коррелированность переменных, уменьшить влияние ошибок и в случае ортогональности выделенных факторов значительно упростить оценку значимости переменных.

Представление, информации в факторном анализе

Для проведения факторного анализа информация должна быть представлена в виде двумерной таблицы чисел размерностью

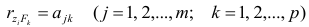

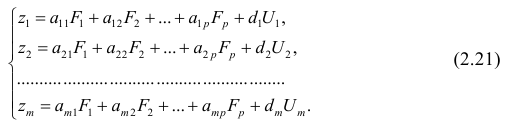

Основная модель факторного анализа. Основная модель факторного анализа имеет вид

где

Модель предполагает, что каждый из j признаков, входящих в исследуемый набор и заданных в стандартной форме, может быть представлен в виде линейной комбинации небольшого числа общих факторов

Термин «общий фактор» подчёркивает, что каждый такой фактор имеет существенное значение для анализа всех признаков

Термин «характерный фактор» показывает, что он относится только к данному j-му признаку. Это специфика признака, которая не может быть, выражена через факторы

Факторные нагрузки

Для j-го признака и i-го объекта модель (2.19) можно записать в. виде

где

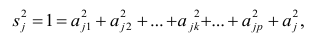

Дисперсию признака

Если общие и характерные факторы не коррелируют между собой, то дисперсию j-го признака можно представить в виде

где

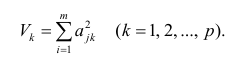

Полный вклад k-го фактора в суммарную дисперсию признаков

Вклад общих факторов в суммарную дисперсию

Факторное отображение

Используя модель (2.19), запишем выражения для каждого из параметров:

Коэффициенты системы (2,21) — факторные нагрузки — можно представить в виде матрицы, каждая строка которой соответствует параметру, а столбец — фактору.

Факторный анализ позволяет получить не только матрицу отображений, но и коэффициенты корреляции между параметрами и

факторами, что является важной характеристикой качества факторной модели. Таблица таких коэффициентов корреляции называется факторной структурой или просто структурой.

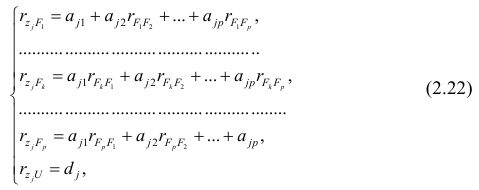

Коэффициенты отображения можно выразить через выборочные парные коэффициенты корреляции. На этом основаны методы вычисления факторного отображения.

Рассмотрим связь между элементами структуры и коэффициентами отображения. Для этого, учитывая выражение (2.19) и определение выборочного коэффициента корреляции, умножим уравнения системы (2.21) на соответствующие факторы, произведём суммирование по всем n наблюдениям и, разделив на n, получим следующую систему уравнений:

где

м фактором;

Если предположить, что общие факторы между собой, не коррелированы, то уравнения (2.22) можно записать в виде

элементам структуры.

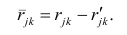

Введём понятие, остаточного коэффициента корреляции и остаточной корреляционной матрицы. Исходной информацией для построения факторной модели (2.19) служит матрица выборочных парных коэффициентов корреляции. Используя построенную факторную модель, можно снова вычислить коэффициенты корреляции между признаками и сравнись их с исходными Коэффициентами корреляции. Разница между ними и есть остаточный коэффициент корреляции.

В случае независимости факторов имеют место совсем простые выражения для вычисляемых коэффициентов корреляции между параметрами: для их вычисления достаточно взять сумму произведений коэффициентов отображения, соответствующих наблюдавшимся признакам:

где

и к-м признаком. Остаточный коэффициент корреляции

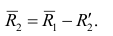

Матрица остаточных коэффициентов корреляции называется остаточной матрицей или матрицей остатков

где

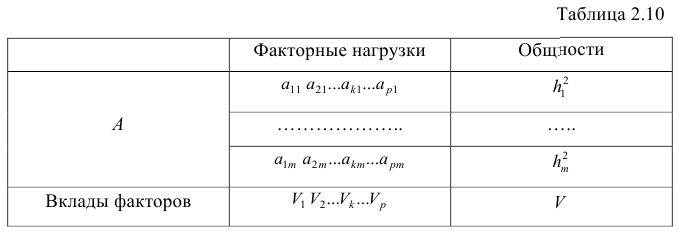

Результаты факторного анализа удобно представить в виде табл. 2.10.

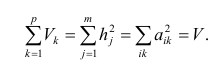

Здесь суммы квадратов нагрузок по строкам — общности параметров, а суммы квадратов нагрузок по столбцам — вклады факторов в суммарную дисперсию параметров. Имеет место соотношение

Определение факторных нагрузок

Матрицу факторных нагрузок можно получить различными способами. В настоящее время наибольшее распространение получил метод главных факторов. Этот метод основан на принципе последовательных приближений и позволяет достичь любой точности. Метод главных факторов предполагает использование ЭВМ. Существуют хорошие алгоритмы и программы, реализующие все вычислительные процедуры.

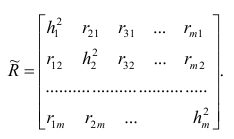

Введём понятие редуцированной корреляционной матрицы или просто редуцированной матрицы. Редуцированной называется матрица выборочных коэффициентов корреляции

Редуцированная и полная матрицы связаны соотношением

где D — матрица характерностей.

Общности, как правило, неизвестны, и нахождение их в факторном анализе представляет серьезную проблему. Вначале определяют (хотя бы приближённо) число общих факторов, совокупность, которых может с достаточной точностью аппроксимировать все взаимосвязи выборочной корреляционной матрицы. Доказано, что число общих факторов (общностей) равно рангу редуцированной матрицы, а при известном ранге можно по выборочной корреляционной матрице найти оценки общностей. Числа общих факторов можно определить априори, исходя из физической природы эксперимента. Затем рассчитывают матрицу факторных нагрузок. Такая матрица, рассчитанная методом главных факторов, обладает одним интересным свойством: сумма произведений каждой пары её столбцов равна нулю, т.е. факторы попарно ортогональны.

Сама процедура нахождения факторных нагрузок, т.е. матрицы А, состоит из нескольких шагов и заключается в следующем: на первом шаге ищут коэффициенты факторных нагрузок при первом факторе так, чтобы сумма вкладов данного фактора в суммарную общность была максимальной:

Максимум

где

Затем рассчитывают матрицу коэффициентов корреляции с учётом только первого фактора

На втором шаге определяют коэффициенты нагрузок при втором факторе так, чтобы сумма вкладов второго фактора в остаточную общность (т.е. полную общность без учёта той части, которая приходится на долю первого фактора) была максимальной. Сумма квадратов нагрузок при втором факторе

Максимум

где

Факторный анализ учитывает суммарную общность. Исходная суммарная общность

Адекватность факторной модели оценивается по матрице остатков (если величины её коэффициентов малы, то модель считают адекватной).

Такова последовательность шагов для нахождения факторных нагрузок. Для нахождения максимума функции (2.24) при условии (2.25) используют метод множителей Лагранжа, который приводит к системе т уравнений относительно m неизвестных

Метод главных компонент

Разновидностью метода главных факторов является метод главных компонент или компонентный анализ, который реализует модель вида

где m — количество параметров (признаков).

Каждый из наблюдаемых, параметров линейно зависит от m не коррелированных между собой новых компонент (факторов)

Если для дальнейшего анализа оставить все найденные т компонент, то тем самым будет использована вся информация, заложенная в корреляционной матрице. Однако это неудобно и нецелесообразно. На практике обычно оставляют небольшое число компонент, причём количество их определяется долей суммарной дисперсии, учитываемой этими компонентами. Существуют различные критерии для оценки числа оставляемых компонент; чаще всего используют следующий простой критерий: оставляют столько компонент, чтобы суммарная дисперсия, учитываемая ими, составляла заранее установленное число процентов. Первая из компонент должна учитывать максимум суммарной дисперсии параметров; вторая — не коррелировать с первой и учитывать максимум оставшейся дисперсии и так до тех пор, пока вся дисперсия не будет учтена. Сумма учтённых всеми компонентами дисперсий равна сумме дисперсий исходных параметров. Математический аппарат компонентного анализа полностью совпадает с аппаратом метода главных факторов. Отличие только в исходной матрице корреляций.

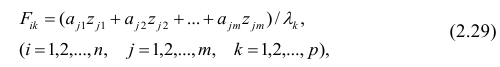

Компонента (или фактор) через исходные переменные выражается следующим образом:

где

компонент.

Для иллюстрации возможностей факторного анализа покажем, как, используя метод главных компонент, можно сократить размерность пространства независимых переменных, перейдя от взаимно коррелированных параметров к независимым факторам, число которых р

Следует особо остановиться на интерпретации результатов, т.е. на смысловой стороне факторного анализа. Собственно факторный анализ состоит из двух важных этапов; аппроксимации корреляционной матрицы и интерпретации результатов. Аппроксимировать корреляционную матрицу, т.е. объяснить корреляцию между параметрами действием каких-либо общих для них факторов, и выделить сильно коррелирующие группы параметров достаточно просто: из корреляционной матрицы одним из методов

факторного анализа непосредственно получают матрицу нагрузок — факторное решение, которое называют прямым факторным решением. Однако часто это решение не удовлетворяет исследователей. Они хотят интерпретировать фактор как скрытый, но существенный параметр, поведение которого определяет поведение некоторой своей группы наблюдаемых параметров, в то время как, поведение других параметров определяется поведением других факторов. Для этого у каждого параметра должна быть наибольшая по модулю факторная нагрузка с одним общим фактором. Прямое решение следует преобразовать, что равносильно повороту осей общих факторов. Такие преобразования называют вращениями, в итоге получают косвенное факторное решение, которое и является результатом факторного анализа.

Приложения

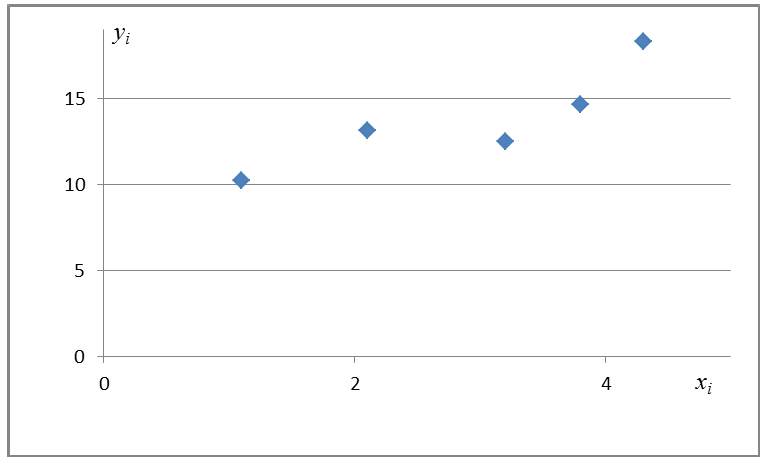

Значение t — распределения Стьюдента

Понятие о регрессионном анализе. Линейная выборочная регрессия. Метод наименьших квадратов (МНК)

Основные задачи регрессионного анализа:

- Вычисление выборочных коэффициентов регрессии

- Проверка значимости коэффициентов регрессии

- Проверка адекватности модели

- Выбор лучшей регрессии

- Вычисление стандартных ошибок, анализ остатков

Построение простой регрессии по экспериментальным данным.

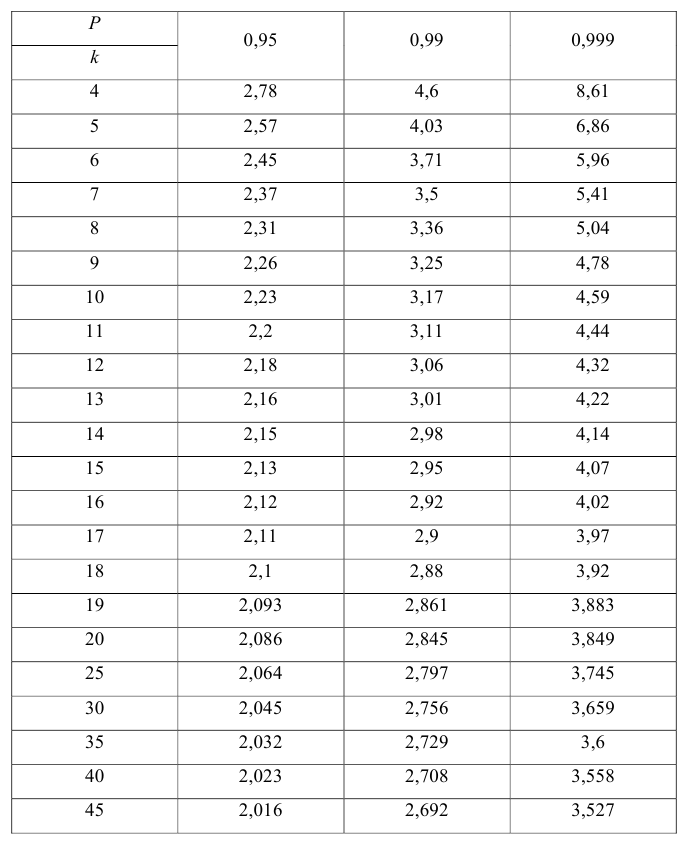

Предположим, что случайные величины

Диаграмма рассеяния (разброса, рассеивания)

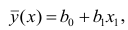

Выборочное уравнение прямой линии регрессии

Задача: подобрать

Для того, что бы провести прямую

чтобы

Постулаты регрессионного анализа, которые должны выполняться при использовании МНК.

подчинены нормальному закону распределения.

- Дисперсия

постоянна и не зависит от номера измерения.

- Результаты наблюдений

в разных точках независимы.

- Входные переменные

независимы, неслучайны и измеряются без ошибок.

Введем функцию ошибок

Решив систему, получим искомые значения

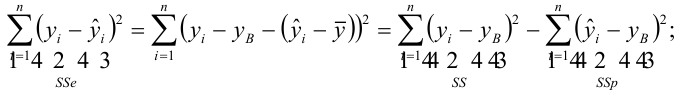

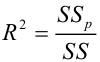

Коэффициент детерминации

Коэффициент детерминации принимает значения от 0 до 1. Чем ближе значение коэффициента к 1, тем сильнее зависимость. При оценке регрессионных моделей это используется для доказательства адекватности модели (качества регрессии). Для приемлемых моделей предполагается, что коэффициент детерминации должен быть хотя бы не меньше 0,5 (в этом случае коэффициент множественной корреляции превышает по модулю 0,7). Модели с коэффициентом детерминации выше 0,8 можно признать достаточно хорошими (коэффициент корреляции превышает 0,9). Подтверждение адекватности модели проводится на основе дисперсионного анализа путем проверки гипотезы о значимости коэффициента детерминации.

Критическая область — правосторонняя;

Если

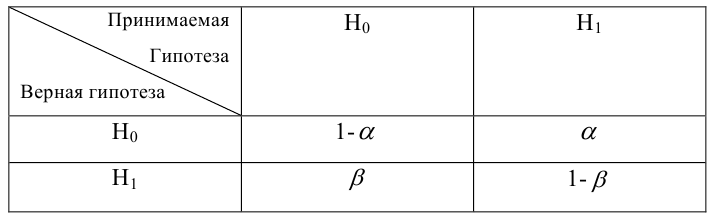

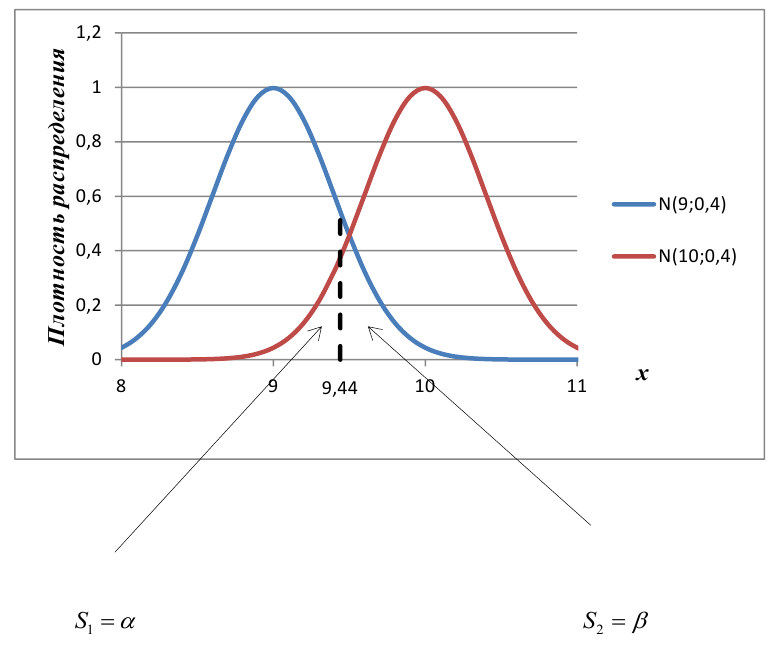

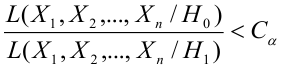

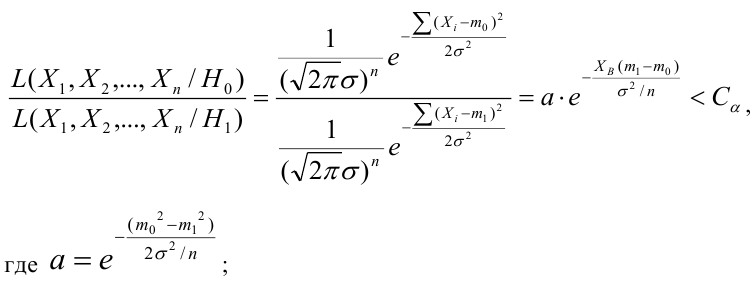

Мощность статистического критерия. Функция мощности

Определение. Мощностью критерия

Задача: построить критическую область таким образом, чтобы мощность критерия была максимальной.

Определение. Наилучшей критической областью (НКО) называют критическую область, которая обеспечивает минимальную ошибку второго рода

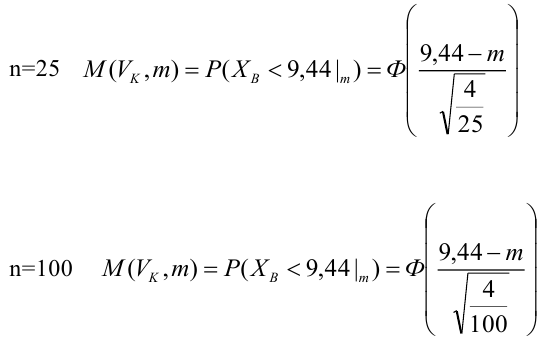

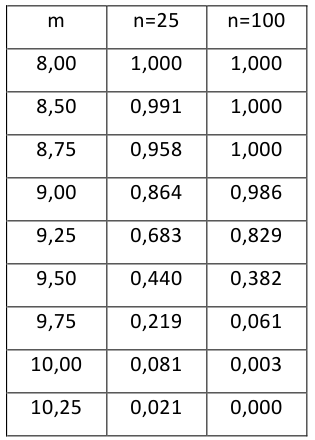

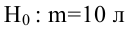

Пример:

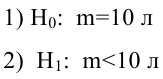

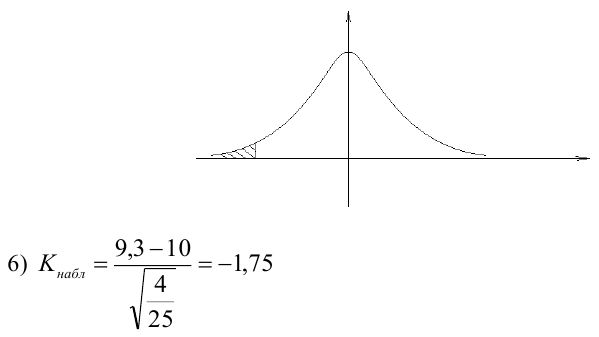

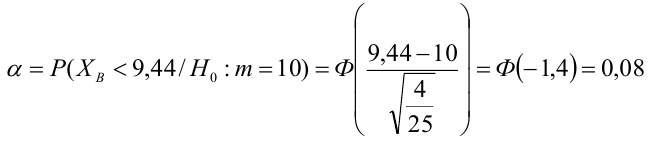

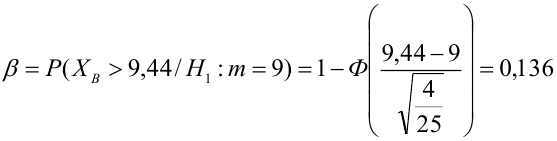

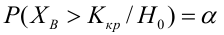

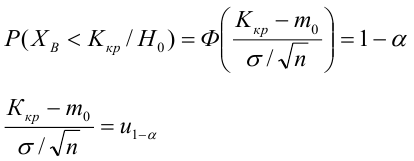

По паспортным данным автомобиля расход топлива на 100 километров составляет 10 литров. В результате измерения конструкции двигателя ожидается, что расход топлива уменьшится. Для проверки были проведены испытания 25 автомобилей с модернизированным двигателем; выборочная средняя расхода топлива по результатам испытаний составила 9,3 литра. Предполагая, что выборка получена из нормально распределенной генеральной совокупности с математическим ожиданием

3) Уровень значимости

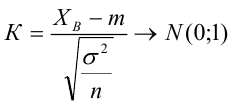

4) Статистический критерий

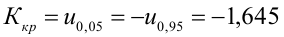

5) Критическая область — левосторонняя

Пример:

В условиях примера 1 предположим, что наряду с

Определение. Пусть проверяется

Пример:

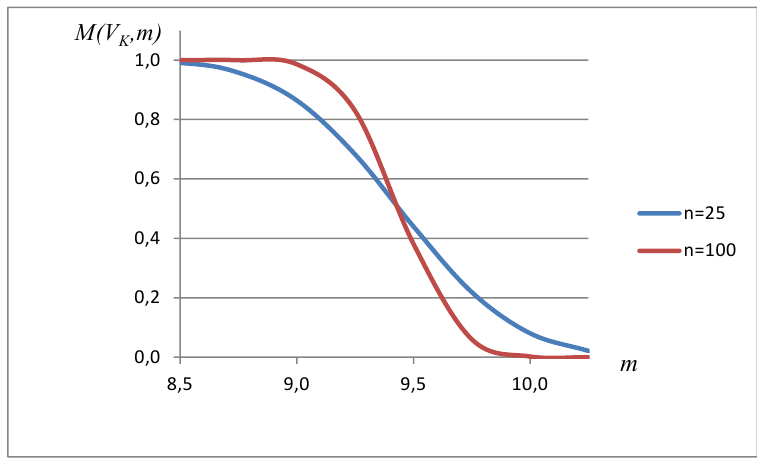

Построить график функции мощности из примера 2 для

Пример:

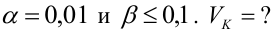

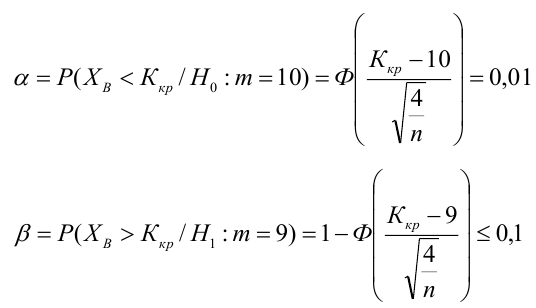

Какой минимальный объем выборки следует взять в условии примера 2 для того, чтобы обеспечить

Лемма Неймана-Пирсона.

При проверке простой гипотезы

Пример:

Случайная величина

Решение:

Ошибка первого рода:

НКО:

Пример:

Для зависимости

Решение. Воспользуемся предыдущими результатами

Согласно формуле (24), уравнение регрессии будет иметь вид

Для выяснения значимости уравнения регрессии вычислим суммы

Из (27) и (28) по данным таблицы получим

Вычислим статистику

Так как

- Корреляционный анализ

- Статистические решающие функции

- Случайные процессы

- Выборочный метод

- Проверка гипотезы о равенстве вероятностей

- Доверительный интервал для математического ожидания

- Доверительный интервал для дисперсии

- Проверка статистических гипотез

Теория

Оценка параметров линейного регрессионного уравнения

Для оценки параметров регрессионного уравнения наиболее часто используют метод наименьших квадратов (МНК), в основе которого лежит предположение о независимости наблюдений исследуемой совокупности. Сущность данного метода заключается в нахождении параметров модели (α, β), при которых минимизируется сумма квадратов отклонений эмпирических (фактических) значений результативного признака от теоретических, полученных по выбранному уравнению регрессии:

В итоге получаем систему нормальных уравнений:

(20)

Эту систему можно записать в виде:

(21)

Решая данную систему линейных уравнений с двумя неизвестными получаем оценки наименьших квадратов:

(22, 23)

В уравнениях регрессии параметр α показывает усредненное влияние на результативный признак неучтенных факторов, а параметр β – коэффициент регрессии показывает, насколько изменяется в среднем значение результативного признака при увеличении факторного на единицу.

Между линейным коэффициентом корреляции и коэффициентом регрессии существует определенная зависимость, выражаемая формулой:

(24)

где – коэффициент регрессии в уравнении связи;

– среднее квадратическое отклонение соответствующего статистически существенного факторного признака.

Пример.

Имеются следующие данные о размере страховой суммы и страховых возмещений на автотранспортные средства одной из страховых компаний.

Таблица 4

Зависимость между размером страховых возмещений и страховой суммой на автотранспорт

|

№ |

Объем страхового возмещения (тыс.долл.), Yi |

Стоимость застрахованного автомобиля (тыс.долл.), Xi |

|

1 |

0,1 |

8,8 |

|

2 |

1,3 |

9,4 |

|

3 |

0,1 |

10,0 |

|

4 |

2,6 |

10,6 |

|

5 |

0,1 |

11,0 |

|

6 |

0,3 |

11,9 |

|

7 |

4,6 |

12,7 |

|

8 |

0,3 |

13,5 |

|

9 |

0,4 |

15,5 |

|

10 |

7,3 |

16,7 |

|

Итого |

17,1 |

120,1 |

Предположим наличие линейной зависимости между рассматриваемыми признаками.

Построим расчетную таблицу для определения параметров линейного уравнения регрессии объема страхового возмещения.

Таблица 5

Расчетная таблица для определения параметров уравнения регрессии

|

№ |

Объем страхового возмещения (тыс.долл.), Yi |

Стоимость застрахованного автомобиля (тыс.долл.), Xi |

х2 |

ху |

|

|

1 |

0,1 |

8,8 |

77,44 |

0,88 |

0,052 |

|

2 |

1,3 |

9,4 |

88,36 |

12,22 |

0,362 |

|

3 |

0,1 |

10,0 |

100,00 |

1,00 |

0,672 |

|

4 |

2,6 |

10,6 |

112,36 |

27,56 |

0,982 |

|

5 |

0,1 |

11,0 |

121,00 |

1,10 |

1,188 |

|

6 |

0,3 |

11,9 |

141,61 |

3,57 |

1,653 |

|

7 |

4,6 |

12,7 |

161,29 |

58,42 |

2,066 |

|

8 |

0,3 |

13,5 |

182,25 |

4,05 |

2,479 |

|

9 |

0,4 |

15,5 |

240,25 |

6,20 |

3,513 |

|

10 |

7,3 |

16,7 |

278,89 |

121,91 |

4,133 |

|

Итого |

17,1 |

120,1 |

1503,45 |

236,91 |

17,100 |

Система нормальных уравнений имеет вид:

,

Отсюда: а0=-4,4944; а1=0,5166.

Следовательно,

Значения в таблице получены путем подстановки значений факторного признака xi (стоимость застрахованного автомобиля) в полученное уравнение регрессии.

Коэффициент регрессии а1=0,5166 означает, что при увеличении стоимости застрахованного автомобиля на 1 тыс.долл., объем страхового возмещения возрастает в среднем на 0,5166 тыс.долл.

можно представить в виде

можно представить в виде

можно представить в виде (2.1).

можно представить в виде (2.1).

подчинены нормальному закону распределения.

подчинены нормальному закону распределения. постоянна и не зависит от номера измерения.

постоянна и не зависит от номера измерения. в разных точках независимы.

в разных точках независимы. независимы, неслучайны и измеряются без ошибок.

независимы, неслучайны и измеряются без ошибок.