При исследовании вопросов зависимости

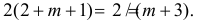

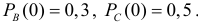

или независимостидвух или более

сечений случайных процессов знание

лишь математического ожидания и дисперсии

с.п. не достаточно.

Для определения связи между различными

случайными процессами используется

понятие корреляционной функции – аналог

понятия ковариации случайных величин

(см. Т.8)

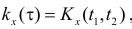

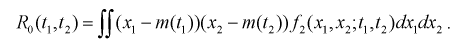

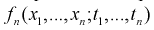

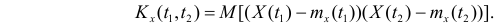

Корреляционной (ковариационной,

автоковариационной, автокорреляционной)функцией случайного процесса

называется неслучайная функция

двух аргументов,

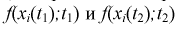

которая при каждой паре значенийравна

корреляционному моменту соответствующих

сеченийи

:

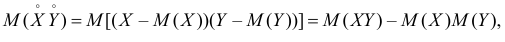

или (с

учётом обозначения центрированной

случайной функции

)

имеем

.

Приведём

основные свойства корреляционной

функции случайного

процесса.

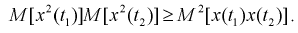

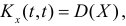

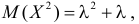

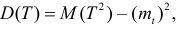

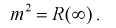

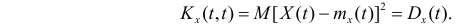

1. Корреляционная функция при одинаковых

значениях аргументов равна дисперсии

с.п.

.

Действительно,

.

Доказанное свойство позволяет вычислить

м.о. и корреляционную функцию являющимися

основными характеристиками случайного

процесса, необходимость в подсчёте

дисперсии отпадает.

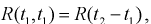

2. Корреляционная функция не меняется

относительно замены аргументов, т.е.

является симметрической функцией

относительно своих аргументов:

.

Это свойство непосредственно выводится

из определения корреляционной функции.

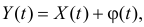

3. Если к случайному процессу прибавить

неслучайную функцию, то корреляционная

функция не меняется, т.е. если

,

то.

Другими словами

является

периодической функцией относительно

любой неслучайной функции.

Действительно, из цепочки рассуждений

,

следует,

что

.

Отсюда получим требуемое свойство 3.

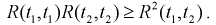

4. Модуль корреляционной функции не

превосходит произведения с.к.о., т.е.

.

Доказательство свойства 4. проводится

аналогично как в пункте 12.2. (теорема

12..2), с учётом первого свойства

корреляционной функции с.п.

.

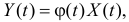

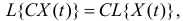

5. При умножении с.п.на

неслучайный множительеё корреляционная функция умножится

на произведение,

т.е., если,

то

.

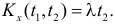

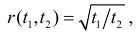

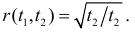

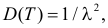

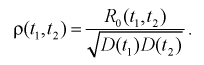

5.1. Нормированная корреляционная функция

Наряду с корреляционной функцией с.п.

рассматривается также нормированная

корреляционная функция (или

автокорреляционнаяфункция)определяемая

равенством

.

Следствие. На основании свойства

1 имеет место равенство

.

По своему смыслу

аналогичен коэффициенту корреляции

для с.в., но не является постоянной

величиной, а зависит от аргументови

.

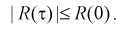

Перечислим свойства нормированной

корреляционной функции:

1.

2.

3.

.

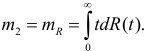

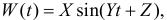

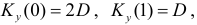

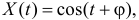

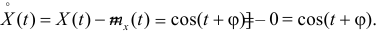

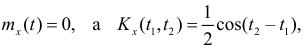

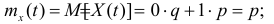

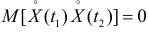

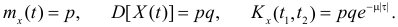

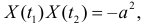

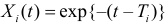

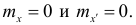

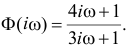

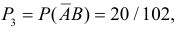

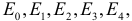

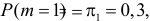

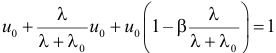

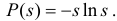

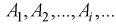

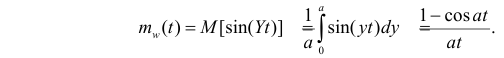

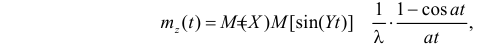

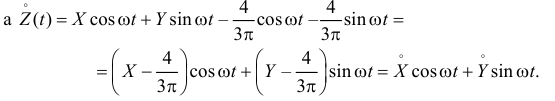

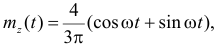

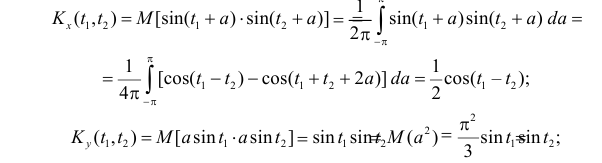

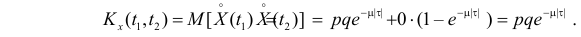

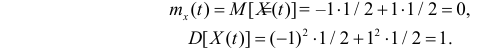

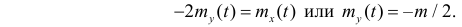

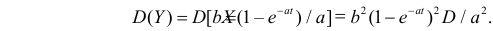

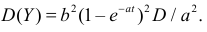

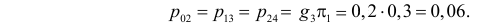

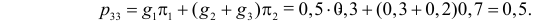

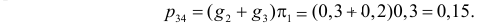

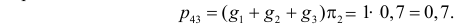

Пример 4. Пусть с.п. определяется

формулой,

т.е.с.в.,

распределена

по нормальному закону с

Найти корреляционную и нормированную

функции случайного процесса

Решение. По определению имеем

,

т.е.

Отсюда с учётом определения нормированной

корреляционной функции и результатов

решения предыдущих примеров получим=1,

т.е..

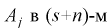

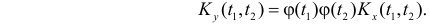

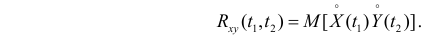

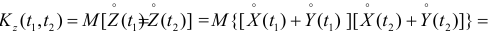

5.2. Взаимная корреляционная функция случайного процесса

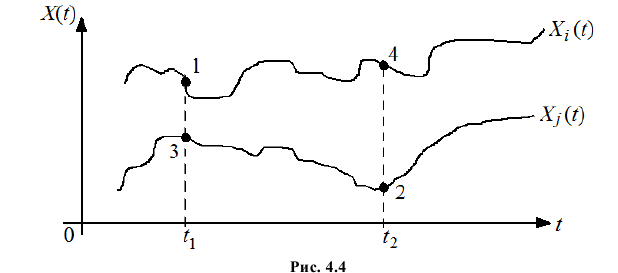

Для определения степени зависимости

сеченийдвух случайных процессов

используют корреляционную функцию

связи или взаимную корреляционную

функцию.

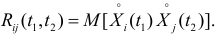

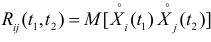

Взаимной корреляционной функцией двух

случайных процессов

и

называется неслучайная функция

двух независимых аргументов

и

,

которая при каждой паре значенийи

равна корреляционному моменту двух

сеченийи

.

Два с.п.

и

называютсянекоррелированными, если

их взаимная корреляционная функция

тождественно равна нулю, т.е. если для

любыхи

имеет место

Если же для любых

и

окажется

,

то случайные процессыи

называютсякоррелированными(илисвязанными).

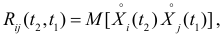

Рассмотрим свойства взаимной корреляционной

функции, которые непосредственно

выводятся из её определения и свойств

корреляционного момента (см. 12.2):

1.При одновременной перестановке индексов

и аргументов взаимная корреляционная

функция не меняется, то есть

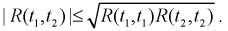

2. Модуль взаимной корреляционной функции

двух случайных процессов не превышает

произведения их средних квадратичных

отклонений, то есть

3. Корреляционная функция не изменится,

если к случайным процессами

прибавить неслучайные функции

и

соответственно, то есть

,

где соответственнои

4. Неслучайные множители

можно

вынести за знак корреляции, то есть,

еслии, то

5. Если

,

то.

6. Если случайные процессы

и

некоррелированные, то корреляционная

функция их суммы равна сумме их

корреляционных функций, то есть.

Для оценки степени зависимости сечений

двух с.п. используют также нормированную

взаимную корреляционную функцию

,

определяемую равенством:

.

Функция

обладает теми же свойствами, что и

функция

,

но свойство 2

заменяется

на следующее двойное неравенство

,

т.е. модуль нормированной взаимной

корреляционной функции не превышает

единицы.

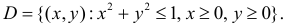

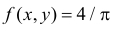

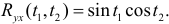

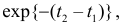

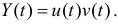

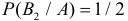

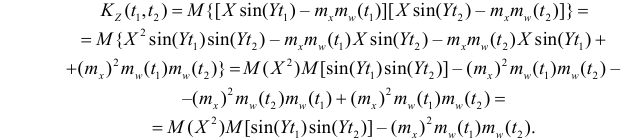

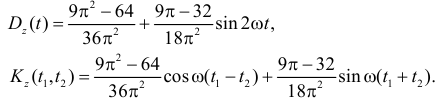

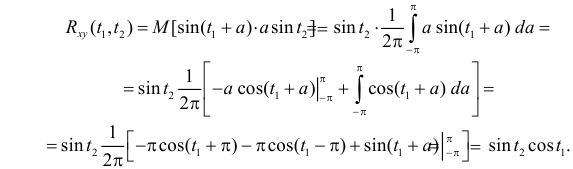

Пример 5. Найти взаимную корреляционную

функцию двух с.п.и

,

гдеслучайная

величина, при этом

Решение. Так как,

.

То

т.е.

Содержание:

Случайные процессы:

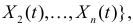

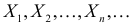

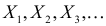

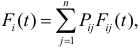

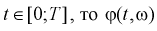

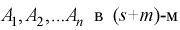

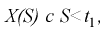

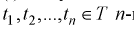

Пусть T – некоторое множество действительных чисел. Случайной функцией называется совокупность случайных величин

Что такое случайный процесс

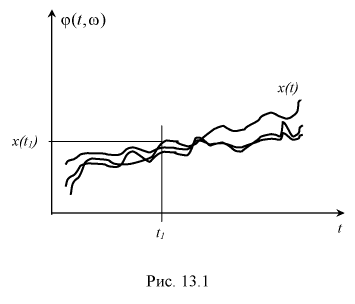

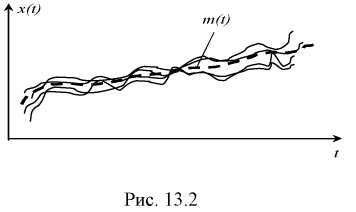

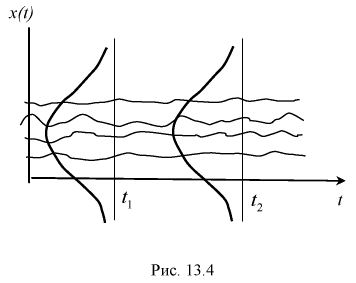

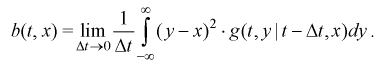

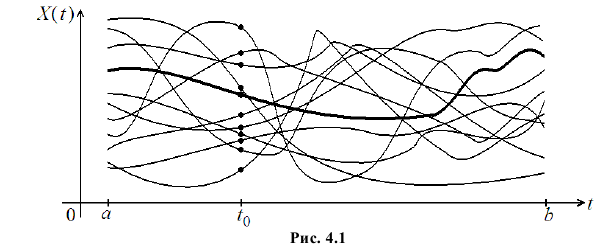

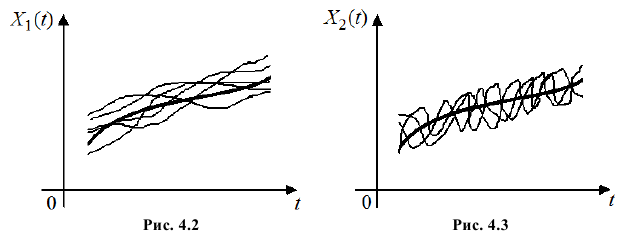

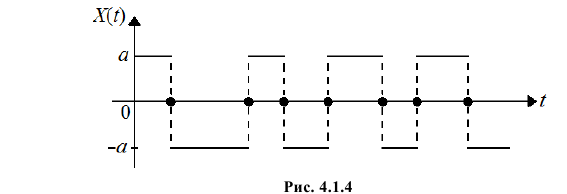

При наблюдении случайной функции мы получаем одну из возможных ее реализаций – неслучайную функцию. Поэтому случайную функцию можно рассматривать как совокупность всех ее возможных реализаций (см. рис. 4.1, на котором жирной линией выделена одна из возможных реализаций, а точками отмечены возможные значения случайной величины

Если роль параметра t играет время, то случайную функцию называют случайным процессом. Если параметр дискретный, то соответствующие ему случайные величины образуют случайную последовательность.

С изменением параметра t изменяется и закон распределения случайной величины

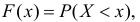

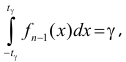

Если функция распределения

называется функцией плотности вероятности.

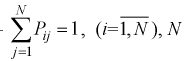

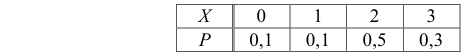

Для дискретной случайной величины одномерный закон распределения задается перечислением возможных значений и соответствующих им вероятностей

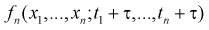

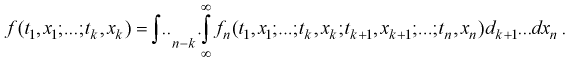

Конечномерным законом распределения случайной функции

Проследить за изменениями всех возможных значений случайной величины и соответствующих им вероятностей, как правило, практически невозможно. Поэтому обычно ограничиваются анализом числовых характеристик случайной величины

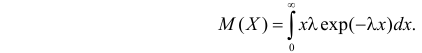

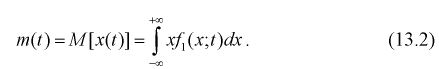

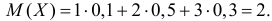

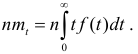

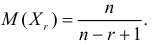

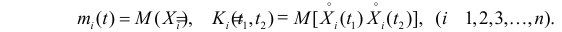

Математическим ожиданием случайного процесса

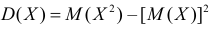

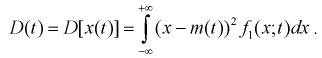

Дисперсией случайного процесса

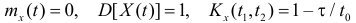

На рис. 4.2 и рис. 4.3 изображены несколько реализаций соответственно случайных процессов

Для описания этих особенностей процесса существует специальная характеристика, которая называется корреляционной функцией (иногда говорят об автокорреляционной функции).

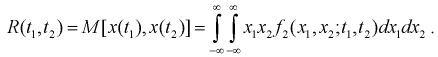

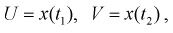

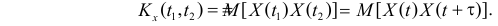

Корреляционной функцией случайного процесса

При равных между собой аргументах

Свойства корреляционной функции

Отметим некоторые свойства корреляционной функции:

1. При перестановке аргументов корреляционная функция не меняется:

2. Прибавление к случайной функции

3. При умножении случайной функции

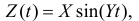

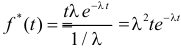

При решении некоторых научно-технических задач приходится иметь дело со случайными процессами, которые удается описать комбинацией простых (элементарных) функций, в которые в качестве параметров входят случайные величины. Такие случайные функции называют элементарными случайными функциями.

Например,

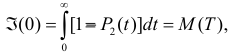

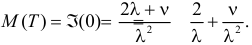

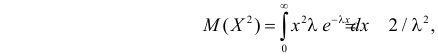

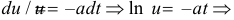

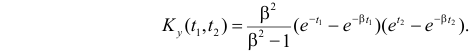

Пример №1

Элементарная случайная функция имеет вид

Решение. Обозначим

Поэтому

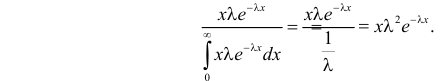

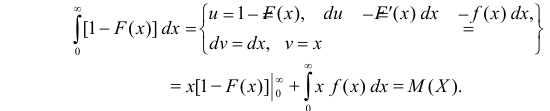

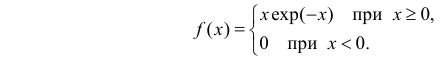

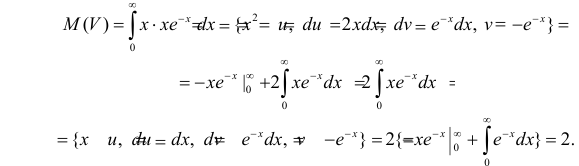

так как для показательного закона распределения

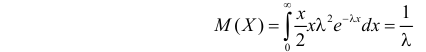

Для показательного закона распределения двукратное интегрирование по частям дает

а

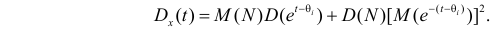

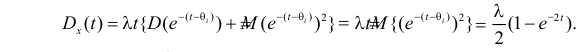

Поэтому и при

Для вычисления дисперсии возьмем в полученном выражении

Ответ.

Пример №2

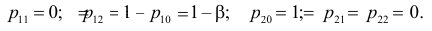

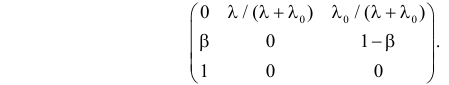

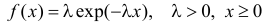

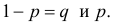

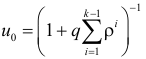

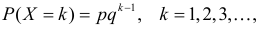

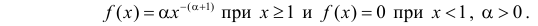

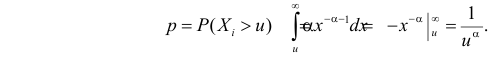

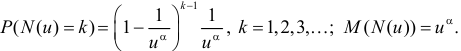

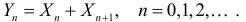

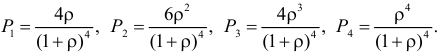

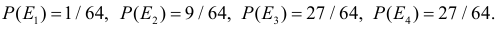

Пусть

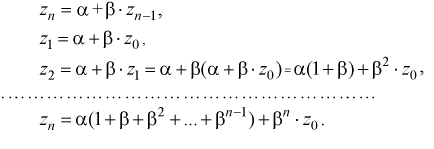

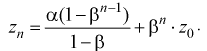

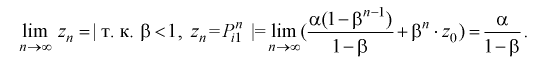

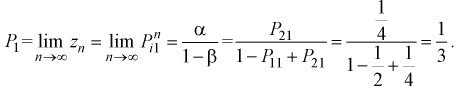

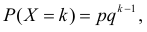

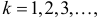

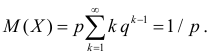

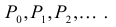

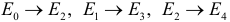

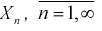

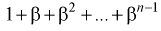

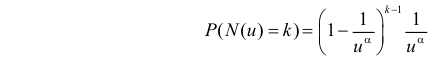

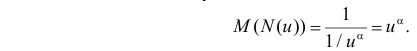

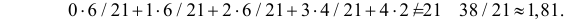

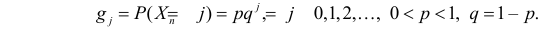

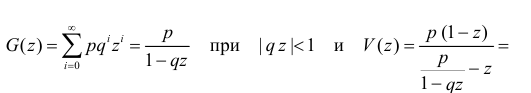

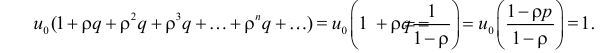

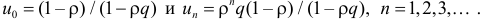

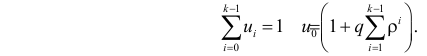

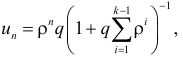

Говорят, что последовательность

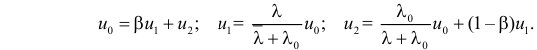

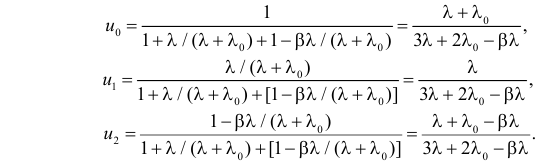

Решение. Вычислим

Тогда

– это геометрический закон распределения.

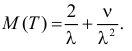

Но для геометрического закона распределения

Ответ.

Пример №3

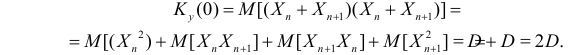

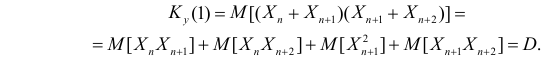

Пусть

Решение. Так как математические ожидания случайных величин равны нулю, то

При

При

При остальных s = 2,3,… величина

Ответ.

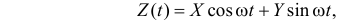

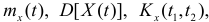

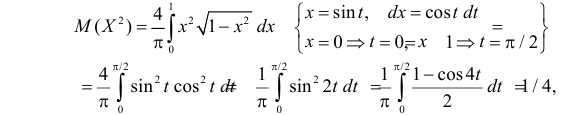

Пример №4

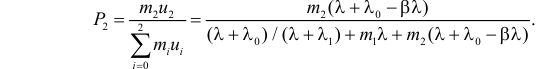

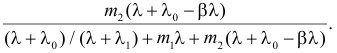

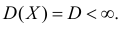

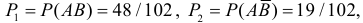

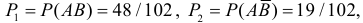

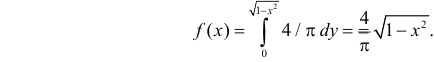

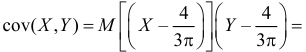

Все положения случайной точки (X,Y) равновозможны в области

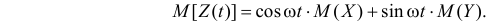

Решение. По свойствам математического ожидания

Так как площадь области D равна

Маргинальная плотность вероятности случайной величины X равна

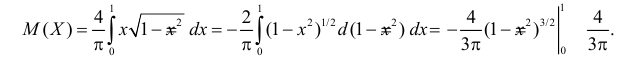

Поэтому

Аналогично,

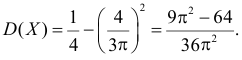

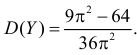

Вычислим дисперсию X. Так как

то

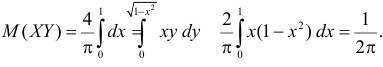

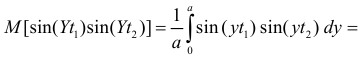

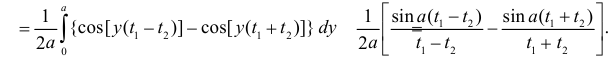

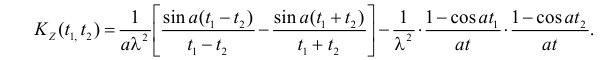

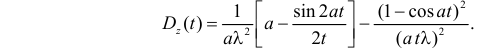

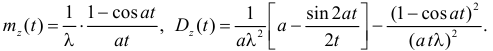

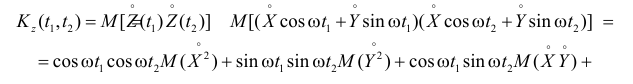

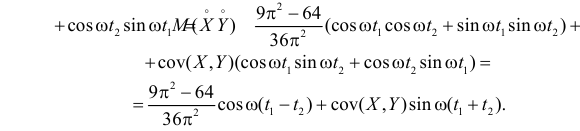

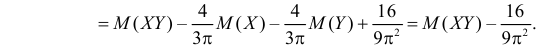

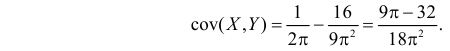

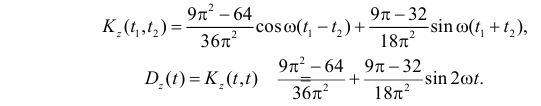

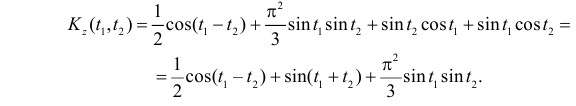

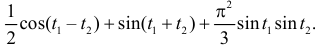

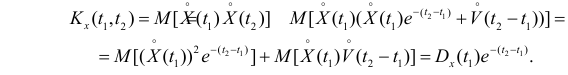

Вычислим теперь корреляционную функцию процесса:

Вычислим

Но

С учетом этого получаем

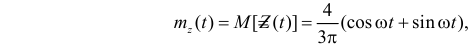

Ответ.

Взаимной корреляционной функцией двух случайных функций X(t) и Y(t) называют неслучайную функцию

Коррелированными называют две случайные функции, если их взаимная корреляционная функция не равна тождественно нулю. В противном случае говорят о некоррелированных случайных функциях.

Если рассматривать многомерный случайный процесс

Эти характеристики описывают поведение отдельно взятых координат случайного процесса, но не учитывают взаимодействие между ними. В качестве характеристики взаимозависимости координат случайного процесса используют взаимную корреляционную функцию

В терминах характеристик второго порядка, например, двумерный случайный процесс

Наглядным примером двумерного случайного процесса (или случайного поля) может служить поверхность моря.

Пример №5

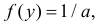

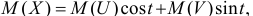

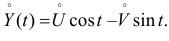

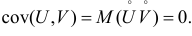

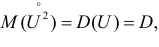

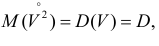

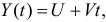

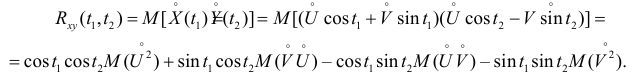

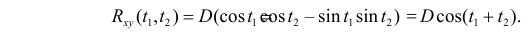

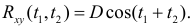

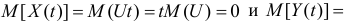

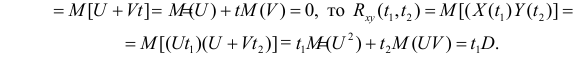

Даны два случайных процесса

где случайные величины U и V независимы и имеют равные дисперсии

Решение. Так как

Аналогично,

Величины U и V независимы, а значит и некоррелированы. Поэтому

Ответ.

Пример №6

Даны два случайных процесса

Решение. Так как

Ответ.

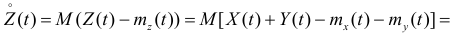

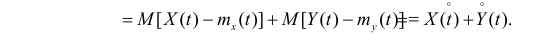

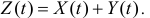

Пусть X(t) и Y(t) – две случайные функции, а случайная функция Z(t) равна

Математическое ожидание суммы двух случайных функций равно сумме математических ожиданий этих функций:

Заметим, что

Поэтому

Легко видеть, что для процесса

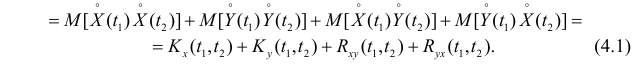

Пример №7

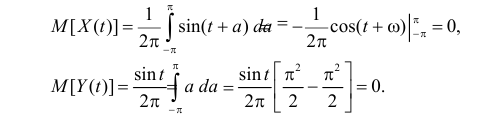

Случайный процесс

Решение. Прежде всего вычислим математические ожидания случайных процессов. Случайная величина

Вычислим величины необходимые для использования формулы (4.1):

Аналогично,

Ответ.

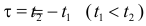

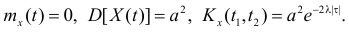

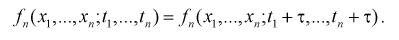

Стационарные случайные процессы

Случайный процесс называется стационарным, если все его характеристики не зависят от времени.

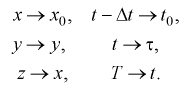

Определение. Случайная функция X(t) называется строго стационарной (стационарной в узком смысле), если все ее конечномерные законы распределения не изменяются от сдвига параметра (времени) на произвольную величину t0. Это в частности означает, что ее математическое ожидание и дисперсия постоянны, а корреляционная функции зависит только от разности аргументов.

Определение. Случайная функция X(t) называется стационарной в широком смысле, если ее математическое ожидание постоянно, а корреляционная функции зависит только от разности аргументов т.е.

Так как

Пример 4.8.

Дан случайный процесс

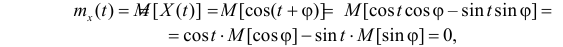

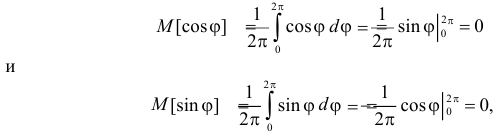

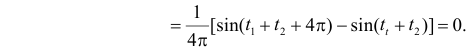

Решение. Для доказательства необходимо проверить выполнение условий (4.1.1). Найдем математическое ожидание

так как

где

так как

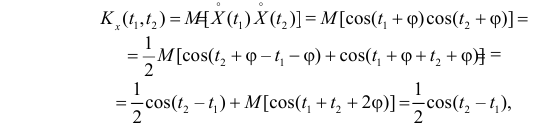

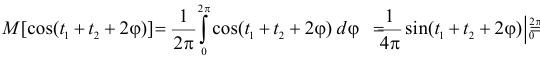

Итак,

Ответ. Процесс стационарен в широком смысле.

Пример 4.9.

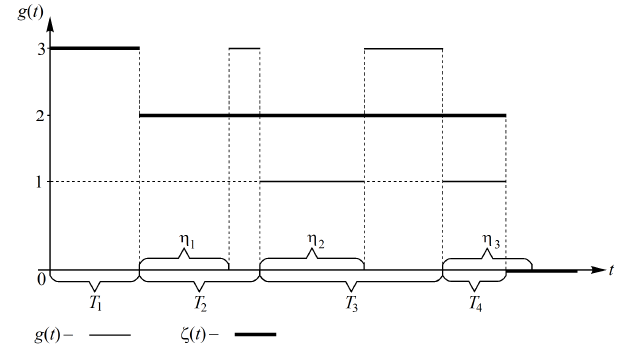

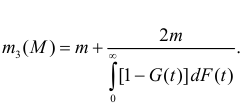

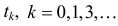

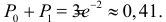

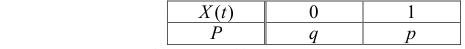

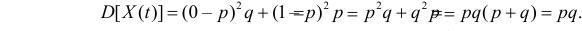

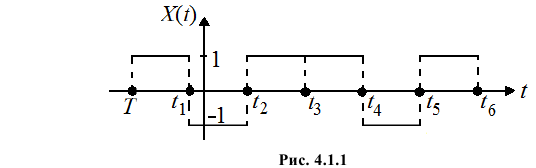

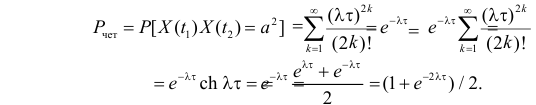

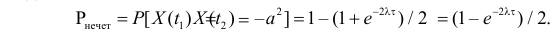

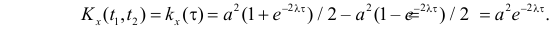

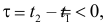

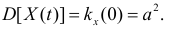

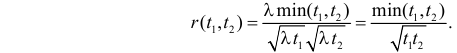

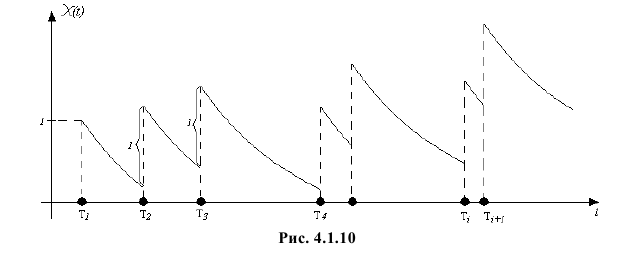

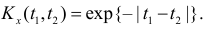

Значения случайного процесса X(t) изменяются скачками в случайные моменты времени

В интервале ,

Необходимо найти

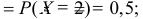

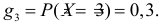

Решение. В произвольный момент времени t значения процесса имеют распределение

Поэтому

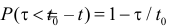

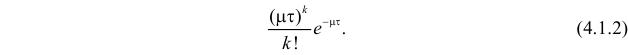

Заметим, что если между моментами t1 и t2 не было скачков процесса (вероятность чего по формуле (4.1.2) равна

Если же между моментами t1 и t2 скачки были, то величины X(t1) и X(t2) независимы и

Итак, математическое ожидание и дисперсия процесса постоянны, а корреляционная функция зависит только от разности значений аргументов. Это означает, что процесс стационарен в широком смысле.

Ответ.

Пример 4.10.

Случайный процесс X(t) строится следующим образом. В некоторый случайный момент времени T появляется прямоугольный импульс длительности t0 и случайной амплитудой A1. В момент времени

Требуется найти

Решение. Для любого момента времени t:

Обозначим

Случайный процесс центрирован

Если вместе

Вероятность этого

Если же

в силу независимости случайных величин

Постоянное значение математического ожидания процесса и зависимость корреляционной функции

Ответ.

Пример 4.11.

Случайный процесс X(t) строится следующим образом. На числовой оси

Требуется найти математическое ожидание, дисперсию и ковариационную функцию этого случайного процесса.

Решение. Так как моменты изменения знака никак не связаны со значениями процесса X(t), нет оснований считать, что какое либо из значений (

Рассмотрим значения процесса в произвольные моменты времени t1 и t2. Так как

Произведение

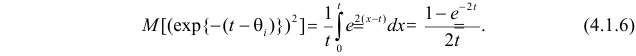

Вероятность появления за время

Тогда

Следовательно,

Аналогично, при

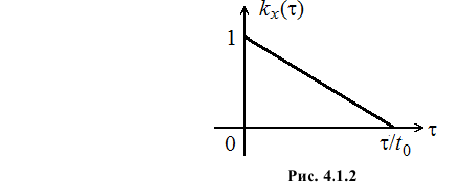

Полученные выражения для

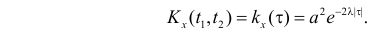

График этой функции изображен на рис. 4.1.5.

Дисперсия процесса равна

Ответ.

Пример 4.12.

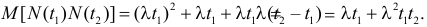

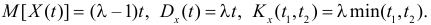

Случайный процесс X(t) устроен следующим образом. На оси времени реализуется простейший поток событий интенсивности

Требуется найти математическое ожидание

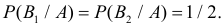

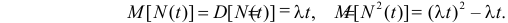

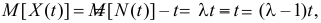

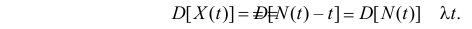

Решение. Каждый скачок процесса равен единице. Поэтому значение процесса в момент времени t можно записать в виде

где N(t) – число скачков за время t.

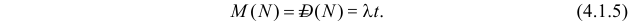

Случайная величина N(t) имеет пуассоновский закон распределения, причем

Поэтому

Так как

В свою очередь

Так как случайные величины

В итоге имеем

Аналогично, при

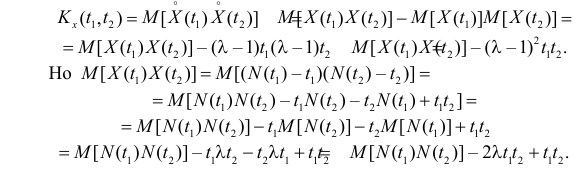

Нормированная корреляционная функция:

Если

Ответ.

Пример 4.13.

Случайный процесс X(t) изменяет свое состояние в моменты времени, которые образуют простейший поток интенсивности

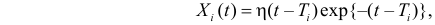

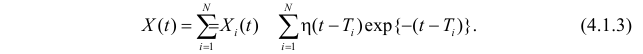

Замечание. Описанный процесс может служить простейшей математической моделью воздействия потока электронов на анод. Поток электронов от катода к аноду близок к простейшему потоку некоторой интенсивности

Решение. Результат воздействия

где

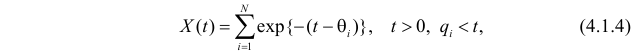

Так как поток скачков простейший, то за время t произойдет случайное число скачков N, распределенных по закону Пуассона с параметром

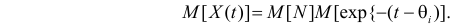

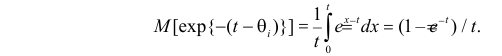

Воспользуемся следующим фактом: Простейший поток событий на (0, )t можно представить как совокупность случайного числа точек, каждая из которых равномерно распределена на

где все

(Здесь мы воспользовались тем, что математическое ожидание суммы случайного числа одинаково распределенных случайных величин равно произведению математического ожидания числа этих величин на математическое ожидание одной из них.)

Так как число слагаемых N распределено по закону Пуассона, то

Каждая из величин равномерно распределена в

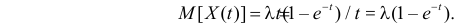

В итоге

Кроме того,

Рассмотрим два момента времени t1 и t2

Величины X(t1), и

Аналогично, при

Поэтому

С учетом (4.1.5), (4.1.6) и того, что

В итоге,

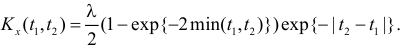

Ответ.

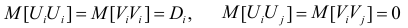

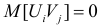

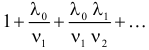

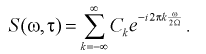

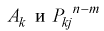

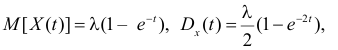

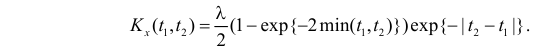

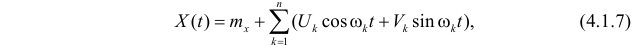

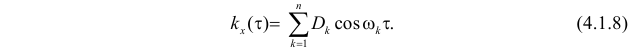

Стационарная в широком смысле функция X(t), представимая во всей области определения в виде

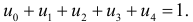

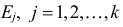

где Uk и Vk – центрированные случайные величины, удовлетворяющие условиям

Такая случайная функция имеет автокорреляционную функцию

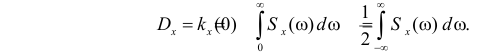

Равенство (4.1.7) называют спектральным разложением случайного процесса, а равенство (4.1.8) спектральным разложением корреляционной функции. Представление (4.1.8) показывает, что дисперсия процесса является суммой дисперсий отдельных гармоник на частотах

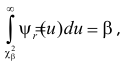

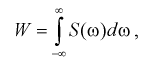

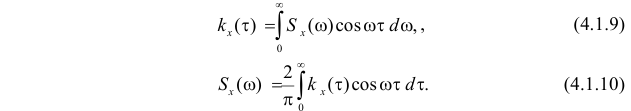

Говорят, что стационарная случайная функция X(t) является случайной функцией с непрерывным спектром, если существует такая действительная неотрицательная функция

Функцию

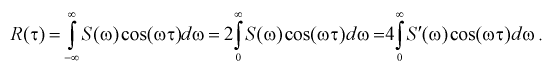

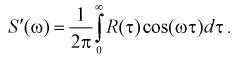

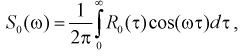

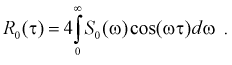

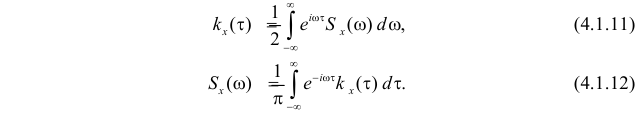

В силу четности корреляционной функции стационарного процесса и

его спектральной плотности формулы (4.1.9) и (4.1.10) можно записать в

виде:

Формулы (4.1.11) и (4.1.12) означают, что корреляционная функция и спектральная плотность связаны взаимно обратными преобразованиями Фурье. Выражения вида (4.1.11) называют интегралом Фурье. Интеграл Фурье является обобщением разложения в ряд Фурье для случая непериодической функции на бесконечном интервале. Это разложение функции на сумму простых гармонических колебаний с непрерывным спектром.

Заметим, что дисперсию стационарного случайного процесса с непрерывным спектром можно выразить в виде интеграла от спектральной плотности:

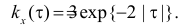

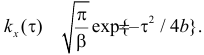

Пример 4.14.

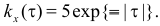

Корреляционная функция стационарного случайного процесса X(t) имеет вид

Требуется найти спектральную плотность процесса.

Решение. В соответствии с формулой (4.1.12)

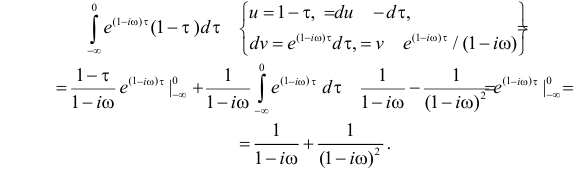

Вычислим сначала первый интеграл

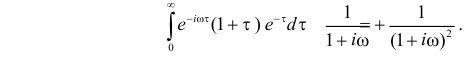

Аналогично

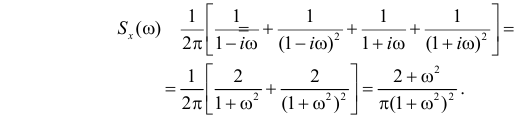

Поэтому

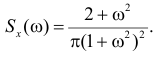

Ответ.

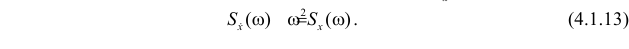

Спектральная плотность производной от случайной функции X(t) связана со спектральной плотностью этой функции

Пример 4.15.

Спектральная плотность случайной функции X(t) имеет вид

Решение. Согласно (4.1.13) спектральная плотность производной X'(t) имеет вид

Ответ.

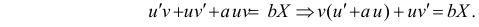

Пусть

Так как

Аналогично

Пример 4.16.

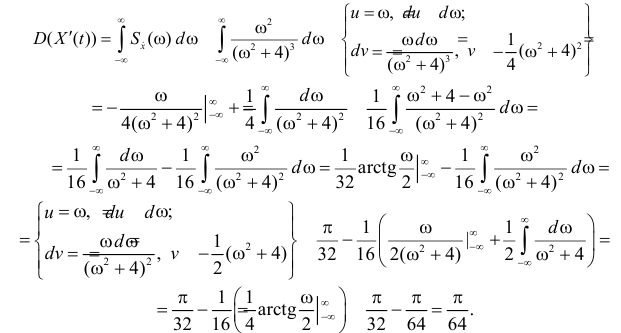

Спектральная плотность случайного стационарного процесса X(t) имеет вид:

Решение. Так как функция

Ответ.

Пример 4.17.

Задана спектральная плотность стационарного случайного процесса

Требуется найти корреляционную функцию этого процесса.

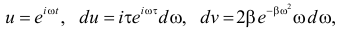

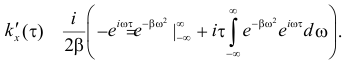

Решение. По формуле (4.1.11) получим:

Непосредственно вычислять такой интеграл трудно. Поэтому воспользуемся следующим приемом. Продифференцируем обе части равенства:

Проинтегрируем по частям:

Тогда

В итоге обнаружилась возможность найти

Это уравнение с разделяющимися переменными. Его общее решение:

Для определения произвольной постоянной зададим начальное условие

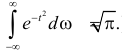

(Напомним, что интеграл Пуассона

При таком начальном условии

Заметим, что и спектральная плотность, и корреляционная функция этого процесса относятся к типу гауссовских кривых.

Ответ.

Преобразование случайных процессов динамическими системами

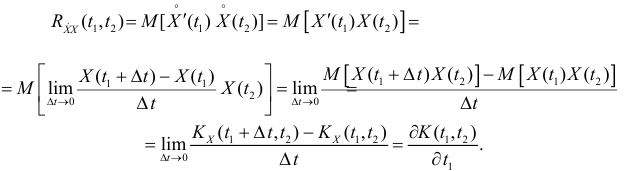

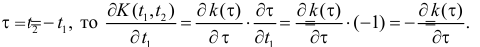

Для случайных процессов оказалось целесообразным расширить трактовку некоторых понятий математического анализа.

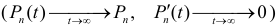

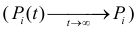

Говорят, что случайная последовательность

(этот факт записывают кратко

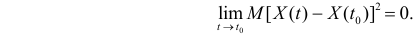

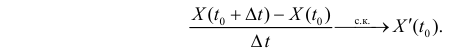

Случайный процесс X(t) называется стохастически непрерывным в точке

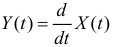

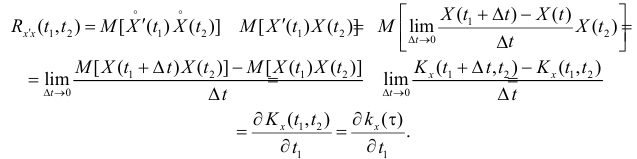

Случайная величина X'(t) называется среднеквадратической производной случайной функции X(t) в точке

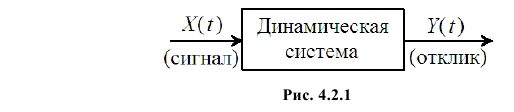

Пусть имеется некоторая динамическая система. Под динамической системой понимается любое радиотехническое устройство, прибор, прицел, система автоматического управления, автопилот, вычислительное устройство и т.д.

На вход системы непрерывно подаются некоторые данные, система их перерабатывает и выдает результат этой переработки. Иногда входящие в систему данные называют «воздействием» или «сигналом», данные на выходе называют «реакцией» или «откликом» на воздействие. Обычно вместе с полезным сигналом поступают и случайные помехи, которые тоже перерабатываются динамической системой и влияют на отклик. Поэтому в общем виде ставится формальная задача о переработке динамической системой некоторого случайного процесса X(t). На выходе тоже получается случайный процесс Y(t). Схема описанной системы приведена на рисунке 4.2.1.

Естественно возникает вопрос: как по характеристикам X(t), с учетом особенностей динамической системы, найти характеристики сигнала на выходе?

С формальной точки зрения, каждая динамическая система задает некоторое соответствие между сигналами на входе и откликами на выходе.

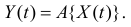

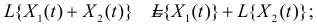

Правило, по которому функция X(t) на входе преобразуется в функцию Y(t) на выходе, называется оператором. Символически это записывают в виде:

Оператор L называется линейным однородным оператором, если он обладает следующими свойствами:

1.

2.

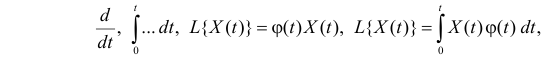

Примерами линейных операторов могут служить операторы

где

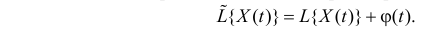

Оператор называют линейным неоднородным, если он состоит из линейной части с прибавлением некоторой определенной функции:

Если случайная функция X(t) с математическим ожиданием

то для нахождения математического ожидания

А для нахождения корреляционной функции

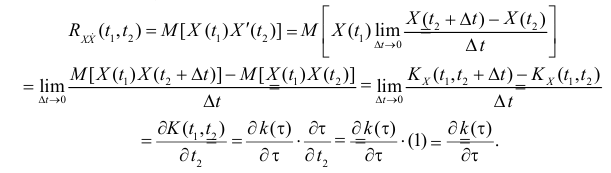

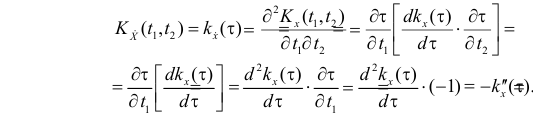

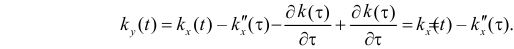

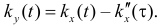

Например, если линейный оператор дифференцирования

Пример 4.18.

Задана

Решение. Воспользуемся формулой (4.1) для корреляционной функции суммы случайных процессов. Вычислим необходимые для этого величины.

Так как процесс X(t) стационарен, то его математическое ожидание и математическое ожидание его производной равны нулю. Поэтому

Но так как

Аналогично,

Так как

В итоге по формуле (4.2)

Ответ.

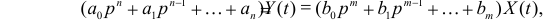

Стационарной линейной динамической системой называется устройство, которое можно описать линейным дифференциальным уравнением с постоянными коэффициентами:

где

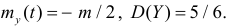

Найдем характеристики Y(t) по характеристикам X(t). Возьмем математическое ожидание от правой и левой частей равенства (4.2.3).Так как X(t) и Y(t) стационарные процессы, то их математические ожидания mx и my постоянны, а производные математических ожиданий равны нулю. Поэтому

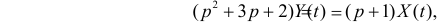

Обозначим оператор дифференцирования

или

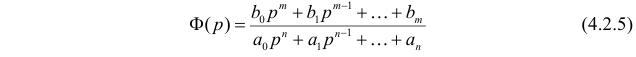

Выражение

называют передаточной функцией.

Уравнение (4.2.3) в операторной форме кратко записывается в виде

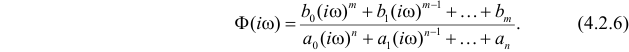

Частотной характеристикой линейной динамической системы называют функцию, которая получается заменой p на

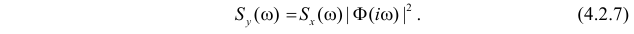

Доказано, что спектральные плотности процессов X(t) и Y(t) связаны соотношением

Это означает, что для получения спектральной плотности выходного случайного процесса необходимо умножить спектральную плотность входного процесса на квадрат модуля частотной характеристики динамической системы.

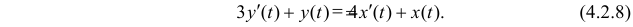

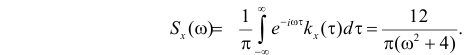

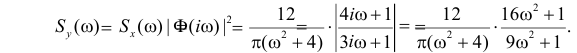

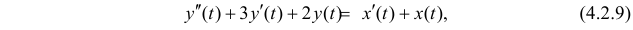

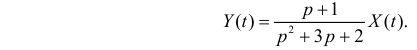

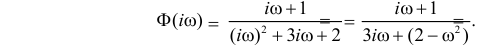

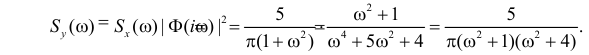

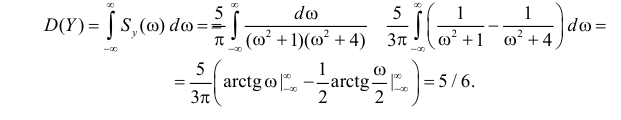

Пример 4.19.

Динамическая система задана уравнением

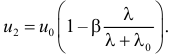

На вход системы подается стационарный случайный процесс X(t) с корреляционной функцией

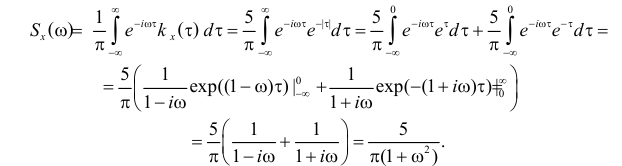

Решение. Вычислим спектральную плотность случайного процесса X(t) по формуле (4.1.12)

В операторной форме уравнение (4.2.8) имеет вид

Поэтому частотная характеристика

Поэтому

Ответ.

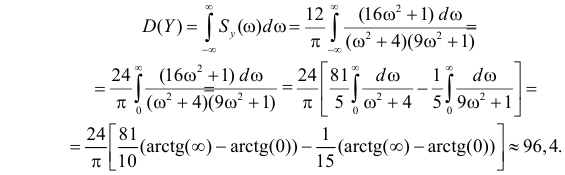

Пример 4.20.

На вход линейной динамической системы, описываемой уравнением

подается стационарный случайный процесс X(t) с математическим ожиданием

Решение. Вычислим спектральную плотность случайного процесса X(t). По формуле (4.1.12)

Обозначим оператор дифференцирования

или

Передаточная функция динамической системы имеет вид

а ее частотная характеристика

Спектральная плотность процесса на выходе системы равна, согласно (4.2.7),

Дисперсия процесса на выходе равна

Если динамическая система устойчива, то при достаточно больших значениях t (после переходного периода) функцию Y(t) можно считать стационарной. Так как X(t) и Y(t) стационарны, то математические ожидания их производных равны нулю. Поэтому переход к математическим ожиданиям в равенстве (4.2.9) дает

Ответ.

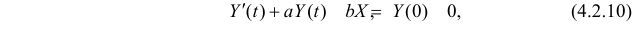

Пример 4.21.

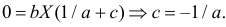

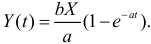

Пусть X – случайная величина с

где

Решение. Решим линейное дифференциальное уравнение (4.2.10) методом Бернулли. Будем искать решение в виде

Подберем u(t) так, чтобы

При начальных условиях

Ответ.

Пример 4.22.

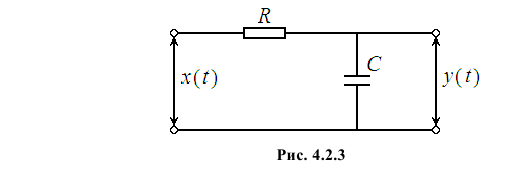

На RC – цепь, схема которой изображена на рис. 4.2.3, подается случайное напряжение X(t) с математическим ожиданием

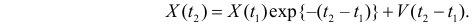

Требуется найти математическое ожидание и дисперсию с напряжения Y(t) на выходе.

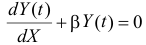

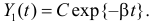

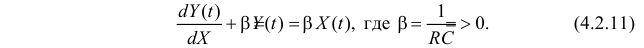

Решение. Дифференциальное уравнение, связывающее сигнал на выходе Y(t) с сигналом X(t) на входе имеет вид

Решение этого уравнения можно получить, например, методом вариации произвольной постоянной. Однородному уравнению

Откуда следует, что

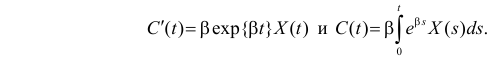

Поэтому решение уравнения (4.2.11) имеет вид

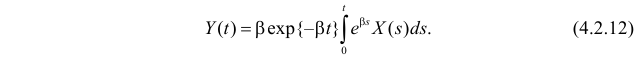

Запись (4.2.12) означает, что Y(t) является результатом действия на X(t) линейного оператора:

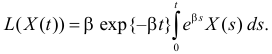

В соответствии с (4.2.1)

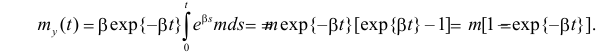

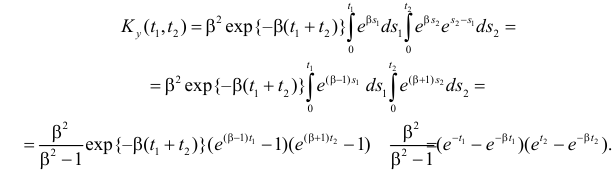

По формуле (4.2.2) при

Аналогично при

Поэтому дисперсия

Ответ.

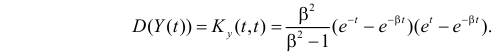

Процессы «гибели и рождения»

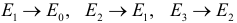

Пусть некоторый объект может в каждый момент времени может находиться в одном из состояний:

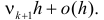

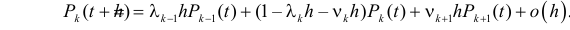

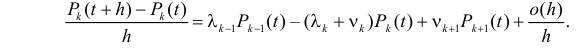

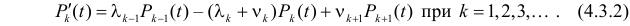

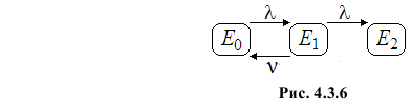

Формально это означает следующее. Если в момент времени t объект находится в состоянии

Пусть постоянные

Процесс изменения состояний объекта по приведенной схеме называется процессом гибели и рождения.

Эти процессы могут служить математической моделью для популяции живых организмов. В этом случае под состоянием

В терминах процессов гибели и размножения можно обсуждать многие технические задачи. Например, для математической модели транспортного предприятия под состоянием можно понимать число автомобилей, которые пригодны для эксплуатации. Тогда выход из стоя автомобиля означает переход в состояние с номером на единицу меньше (т.е. «гибель»), а восстановление машины после ремонта – переход в состояние с номером на единицу больше («рождение»).

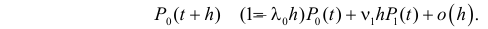

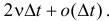

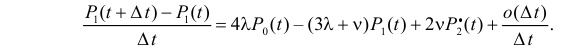

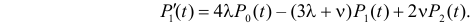

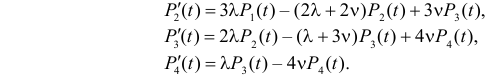

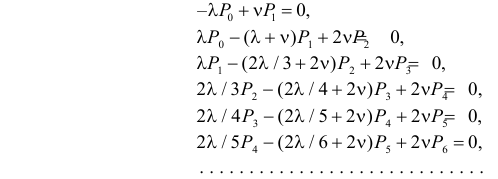

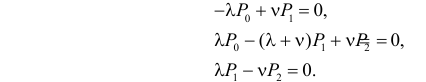

Обозначим через

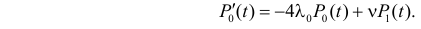

Символическая запись этой фразы имеет вид

Перенесем из правой части в левую

При

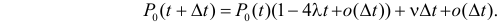

Уравнение для k=0 получается из следующих рассуждений. Объект в момент времени

Перенос слагаемого

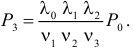

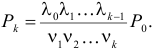

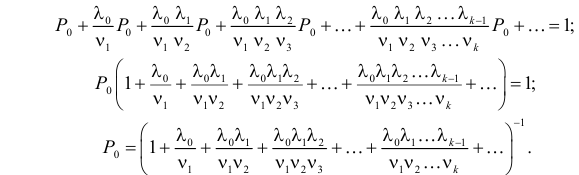

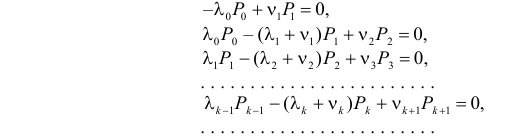

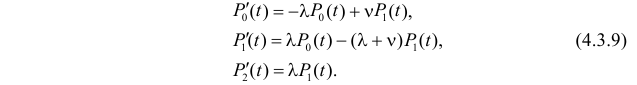

Уравнения (4.3.2) и (4.3.3) называют системой уравнений гибели и рождения. В общем виде решение этой системы получить сложно, но в отдельных частных случаях это вполне обозримая работа.

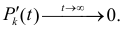

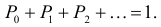

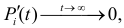

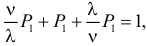

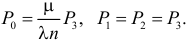

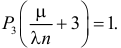

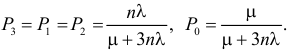

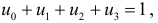

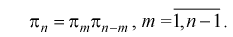

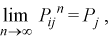

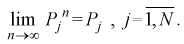

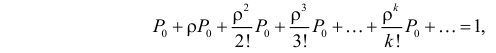

Обычно с течением времени влияние начального состояния иссякает и процесс входит в стационарный режим, при котором переходы из состояния в состояние продолжаются, но сами вероятности состояний стабилизируются и перестают зависеть от времени (от начального состояния), т.е.

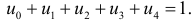

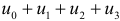

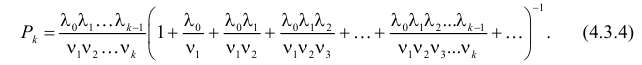

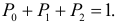

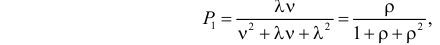

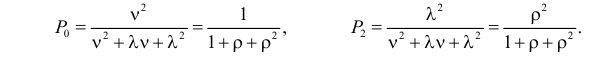

Выбрать единственное решение системы позволяет условие нормировки

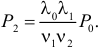

Третье уравнение дает равенство

В итоге получаем, что

Замечание. Если ряд в знаменателе (4.3.4) расходится, то все

т.е. начиная с некоторого номера n интенсивность гибели должна превосходить интенсивность рождений.

Пример 4.23.

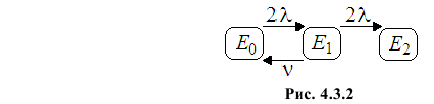

Система состоит из основного блока, одного блока в «горячем» резерве (т.е. работающего одновременно с основным) и одного блока в «холодном» резерве (т.е. этот резервный блок не работает). Длительность безотказной работы работающего блока распределена по показательному закону с параметром

Решение. 1. Состояния системы будем различать по числу вышедших из строя блоков. Обозначим через

Происходит переход

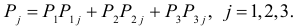

2. Обозначим через

Любое из уравнений системы можно заменить условием нормировки

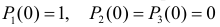

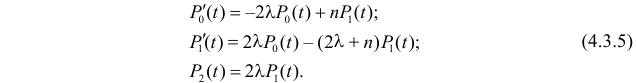

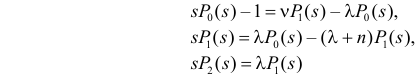

Пусть система начинает свою работу из состояния E1, т.е. имеет начальные условия:

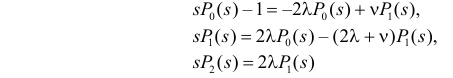

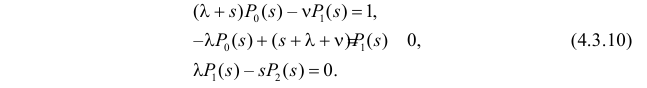

3. Перейдем в системе (4.3.5) к преобразованиям Лапласа:

или

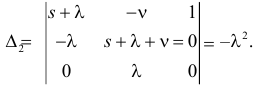

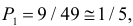

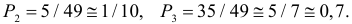

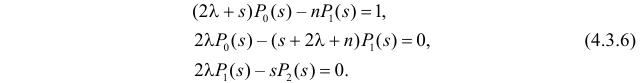

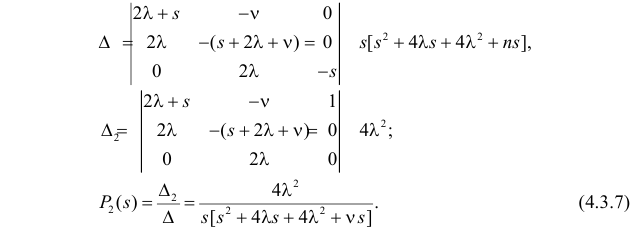

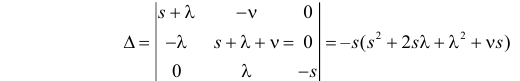

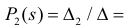

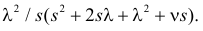

Решение системы (4.3.6), например, по формулам Крамера дает:

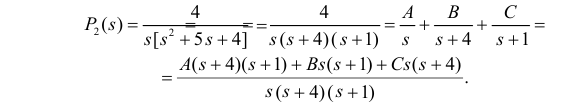

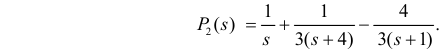

Остается найти обратное преобразование от

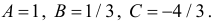

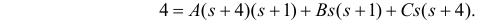

(Здесь мы пользуемся методом неопределенных коэффициентов для разложения на простые дроби). Имея две равные дроби с равными знаменателями, приравниваем числители этих дробей

Приравнивая в правой и левой частях равенства коэффициенты при равных степенях

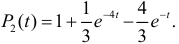

Обращение преобразования Лапласа дает искомую вероятность

Ответ.

Пример 4.24.

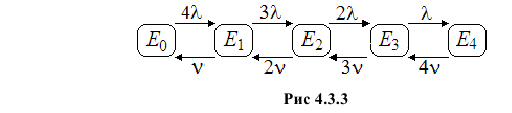

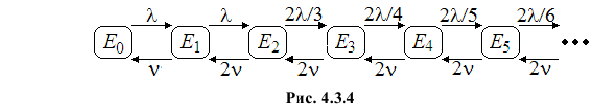

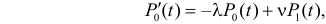

На контактном многоканальном телефоне фирмы работает четыре оператора. Каждый свободный оператор независимо от других на интервале времени

Решение. Состояния контактного телефона будем различать по числу занятых операторов. Пусть Ek – означает, что заняты k из них. Тогда граф состояний имеет вид, изображенный на рис. 4.3.3.

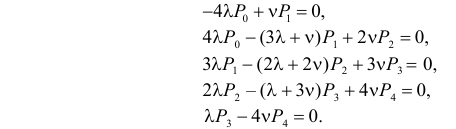

Составим уравнения для вероятностей

Перенос слагаемого

На контактном телефоне в момент времени

Символическая запись этой фразы имеет вид

Перенесем из правой части в левую

При

Аналогично выводятся уравнения

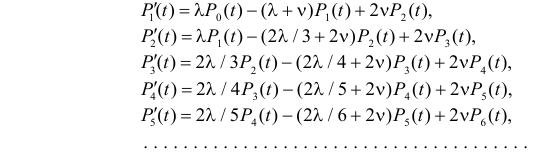

С течением времени вероятности состояний стабилизируются и перестают зависеть от времени (от начального состояния), т.е.

Но при этом

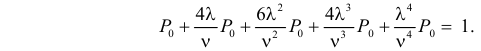

Выбрать единственное решение системы позволяет условие нормировки

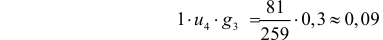

Третье уравнение дает равенство

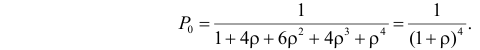

Обозначим

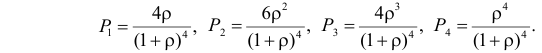

Откуда

Ответ.

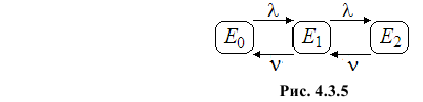

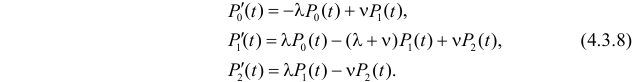

Пример 4.25.

Система массового обслуживания состоит из двух обслуживающих устройств. В систему поступает простейший поток требований на обслуживание интенсивности

Решение. Обозначим через Ek – состояние системы, когда в ней находятся k требований. Если в системе находится

Составим систему уравнений гибели и размножения

Для стационарного режима

Эту систему естественно дополнить условием нормировки

откуда

где

Вероятность того, что требование поступит на обслуживание без ожидания в очереди, равна

Ответ.

Пример 4.26.

Система массового обслуживания состоит из одного обслуживающего прибора и одного прибора в холодном резерве. Интенсивность выхода из строя работающего прибора равна

Требуется найти долю времени простоя системы из-за выхода из строя приборов. Найти наработку на отказ, т.е. среднее время работы системы между пребываниями в отказных состояниях.

Решение. Состояния системы будем различать по числу вышедших из строя приборов. Обозначим через

Если считать выход из строя прибора рождением неполадки, а завершение ремонта ее гибелью, то система уравнений гибели и размножения по формулам (4.3.2), (4.3.3) для нашего случая принимает вид

Это система линейных однородных дифференциальных уравнений с постоянными коэффициентами. Любое уравнение системы можно заменить условием нормировки:

С учетом того, что

Эта система имеет бесконечно много решений. Для выбора приемлемого для нас решения одно из уравнений, например, второе заменим условием нормировки

Из первого уравнения имеем

где

Стационарную вероятность P2 можно понимать как долю времени, в течение которой система находится в нерабочем состоянии (оба прибора вышли из строя).

Для вычисления наработки на отказ сделаем состояние E2 поглощающим, т.е. исключим переход

Этому графу состояний соответствует система уравнений

Зададим начальное состояние. Пусть, например,

или

Найдем

и

Обозначим через

Заметим, что

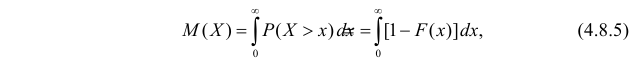

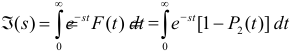

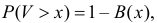

Последний вывод основан на следующих соображениях. Пусть X – неотрицательная случайная величина с функцией распределения

В нашем случае

Ответ.

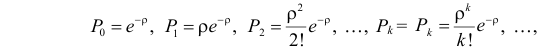

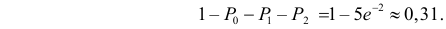

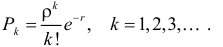

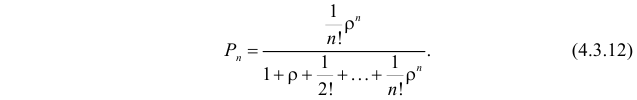

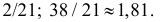

Рассмотрим систему массового обслуживания, в которую поступает простейший поток требований интенсивности

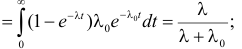

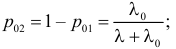

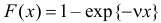

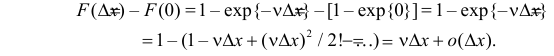

Замечание. Пусть время обслуживания имеет показательное распределение с функцией распределения

Под состоянием

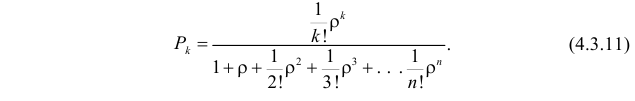

Формулы (4.3.11) называют формулами Эрланга, который их впервые вывел в 1917 г. В последующем оказалось, что для систем с потерями формулы Эрланга сохраняют свою структуру при любом распределении длительности обслуживания, лишь бы среднее время обслуживания равнялось

При

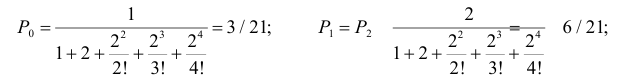

Пример 4.27.

В систему массового обслуживания, состоящую из четырех каналов обслуживания, поступает простейший поток требований интенсивности

Требование, заставшее все каналы обслуживания занятыми, теряется. Необходимо найти вероятность потери требования и среднее число занятых обслуживанием каналов.

Решение. Пусть V – время обслуживания требования. Вычислим среднее время обслуживания

В формулах Эрланга

Среднее число занятых каналов равно

Ответ.

Пример 4.28.

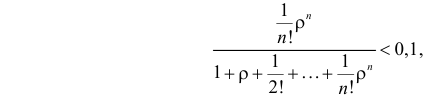

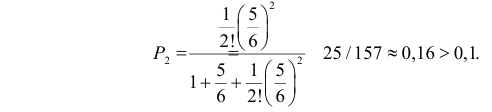

На многоканальный контактный телефон фирмы поступает простейший поток звонков интенсивности пять звонков в час. Время разговора с каждым клиентом в среднем занимает 10 минут. Звонки, заставшие все каналы занятыми, теряются. Сколько должно быть каналов для того, чтобы терялось не более 10% звонков?

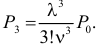

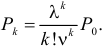

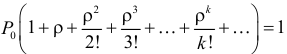

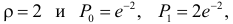

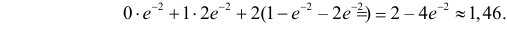

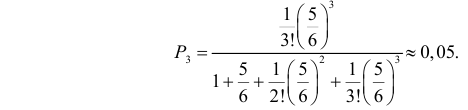

Решение. Формулы Эрланга сохраняют свою структуру при любом распределении времени обслуживания и зависят только от среднего значения длительности обслуживания. В нашем случае

даже при известном значении

По той же формуле при n=3

Вычисления показали, что при двух каналах теряется около 16% звонков, а уже при трех каналах потери составят около 5% звонков.

Ответ. Достаточно трех каналов.

Метод фаз Эрланга

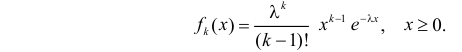

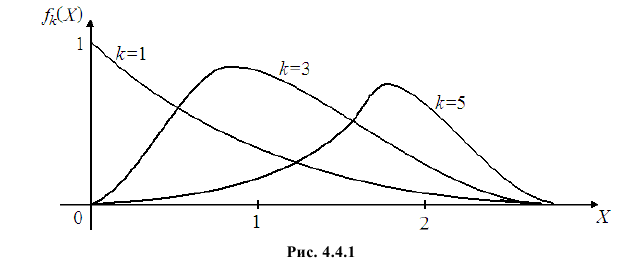

Случайная величина X имеет распределение Эрланга порядка k с параметром

На рис. 4.4.1 приведены графики распределения Эрланга при значении параметра

При k=1 получается плотность показательного распределения.

Метод фаз Эрланга применяется тогда, когда наряду с показательными распределениями в стохастической системе встречаются распределения Эрланга.

Математическое описание такой системы возможно с помощью Марковского процесса. Эта возможность основана на том, что случайную величину, имеющую распределение Эрланга порядка k с параметром

Оказывается, что многие функции распределения допускают хорошую аппроксимацию с помощью линейной комбинации функций распределения Эрланга.

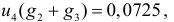

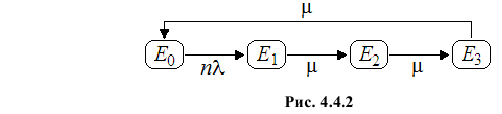

Пример 4.29 (система Энгсета с потерями)

Система обслуживания состоит из одного прибора. Из n независимых источников поступают требования. Время обслуживания любого требования имеет распределение Эрланга 3-го порядка с параметром

Решение. Выделим состояния системы:

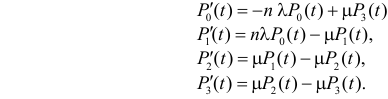

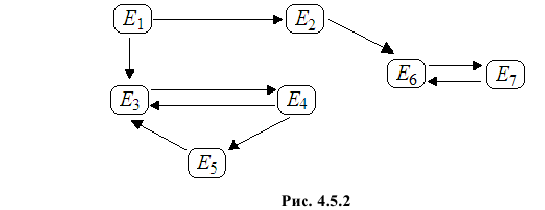

Для вероятностей состояний системы в момент времени t можно составить систему уравнений:

Тогда для стационарных вероятностей

из которой

Ответ.

Марковские процессы с дискретным множеством состояний

Цепи Маркова:

Случайным процессом

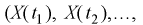

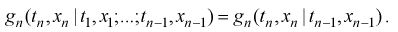

Определение. Случайный процесс Xt называется марковским, если для любого момента времени

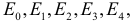

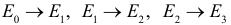

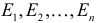

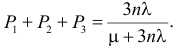

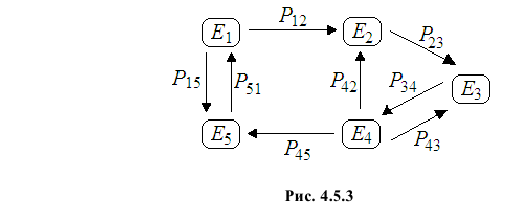

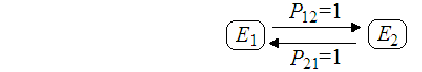

Пусть некоторый физический объект в каждый момент времени может находиться в одном из своих возможных состояний, число которых конечно или счетное. В этом случае иногда говорят о дискретном множестве состояний. Состояния могут быть качественными и описываться словами, или количественными и характеризоваться некоторыми числами. Представление о множестве состояний и о структуре переходов из состояния в состояние дает схема, которая называется графом состояний. Будем стрелками обозначать возможные переходы, а через

Например, в графе состояний (рис. 4.5.1) E0 означает, что устройство новое и не включено в работу, E1 – устройство работает, E2 – устройство неисправно, E3 – происходит поиск причин неисправности, E4 – производится ремонт, E5 – устройство признано не подлежащим ремонту и утилизировано. Если ремонт удался, то происходит переход в состояние E1.

Взаимное расположение состояний в графе позволяет их классифицировать следующим образом:

- Состояние называется источником, если объект может выйти их него, но попасть вновь в него не может (в приведенном примере состояние E0).

- Состояние называется поглощающим (или концевым), если в него можно войти, но из него выйти нельзя (в приведенном примере состояние E5).

- Состояние Ei называется соседним к состоянию Ej , если возможен непосредственный переход из состояния Ej в состояние Ei . В приведенном примере E3 соседнее состояние по отношению к E2, но E2 не соседнее состояние по отношению к E3.

- Подмножество состояний называется эргодическим (или связным), если из каждого состояния этого подмножества можно попасть в любое другое состояние этого подмножества.

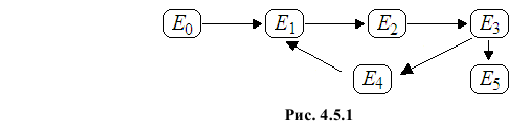

Например, в графе (см. рис. 4.5.2)два эргодических подмножества состояний:

Случайный процесс изменения состояний объекта можно понимать как процесс блуждания по множеству состояний графа.

С точки зрения описания объекта первостепенный интерес представляют вероятности состояний этого объекта. Обозначим через

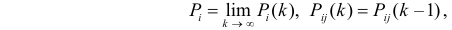

Часто интерес представляет лишь установившийся режим работы (или стационарный режим), в который объект входит после достаточно долгого времени работы. При стационарном режиме процесс перехода из состояния в состояние продолжается, но вероятности состояний не изменяются. Обозначим эти вероятности через Pi . Так что

Величину Pi можно понимать как среднюю долю времени, в течение которой объект находится в состоянии Ei. В общем случае

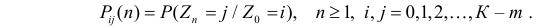

Еще раз повторим, что случайный процесс с дискретным множеством состояний называется марковским, если для любого момента времени t0 вероятность каждого из его состояний в будущем (при

Если переходы из состояния в состояние могут происходить только в определенные моменты времени

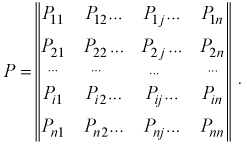

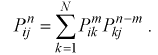

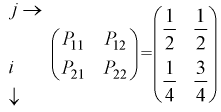

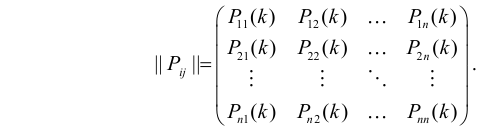

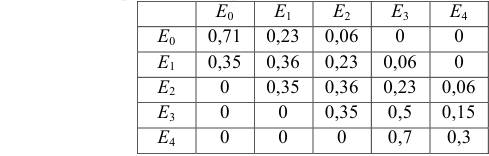

Важными характеристиками марковской цепи являются условные вероятности перехода системы на k-м шаге в состояние Ej, если на предыдущем

Эту матрицу называют матрицей переходных вероятностей или просто переходной матрицей. Так как на каждом шаге система находиться в одном из своих возможных состояний, то для любой строки матрицы сумма ее элементов равна единице. Матрицы, обладающие этим свойством, называют стохастическими.

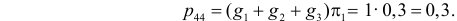

Для однозначного в вероятностном смысле описания процесса переходов из состояния в состояние нужно, помимо переходных матриц, указать начальное распределение состояний, т.е. вероятности

Цепь Маркова называется однородной, если переходные вероятности не меняются от шага к шагу, т.е.

Заметим, что каждому графу состояний для однородной цепи соответствует определенная переходная матрица.

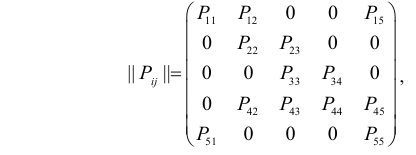

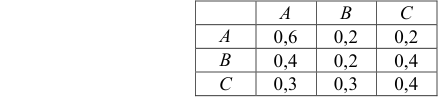

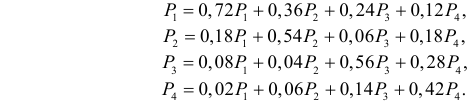

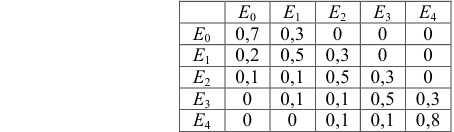

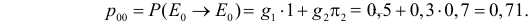

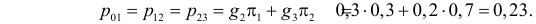

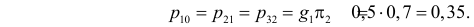

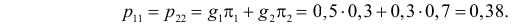

Графу состояний (рис. 4.5.3) соответствует переходная матрица

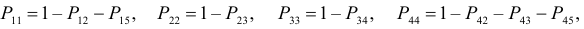

где

Пусть задано распределение состояний в начальный момент времени:

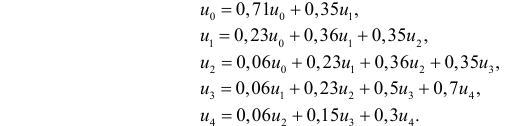

Используя полученные вероятности, можно по формуле полной вероятности вычислить вероятности состояний на втором шаге:

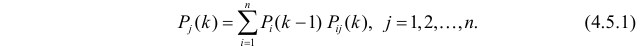

Продолжение этих рассуждений приводит к рекуррентному соотношению

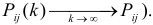

При определенных условиях цепи Маркова входят в стационарный режим, при котором переходы из состояния в состояние продолжаются, но вероятности переходов не изменяются и не зависят от номера шага. Эти вероятности называют финальными или предельными. Будем обозначать финальные вероятности через

Условия существования финальных вероятностей:

- множество всех состояний должно быть эргодическим;

- цепь должна быть однородной (во всяком случае переходные вероятности должны удовлетворять условию:

- должно быть хорошее перемешивание состояний (не должно быть периодических циклов).

Например, для цепи с графом состояний условие 3) не выполняется, так как при начале из состояния Е1 на нечетном шаге цепь будет находиться в состоянии Е2, а на четном — в состоянии Е1.

Если для однородной цепи финальное распределение существует, то

и равенства (4.5.1) имеют вид

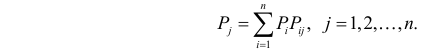

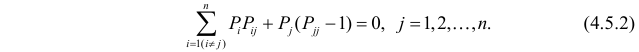

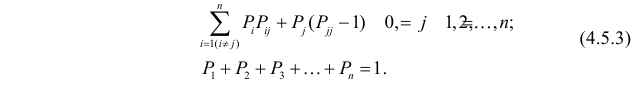

Иногда в этой записи выделяют слагаемые в правой части с

или

Для определения финальных вероятностей нужно решить систему линейных однородных уравнений (4.5.2). Такая система всегда совместна, (имеет тривиальное решение

Это равенство можно добавить вместо одного из уравнений системы (4.5.2). Итак, для нахождения финальных вероятностей состояний марковской цепи нужно решить систему уравнений

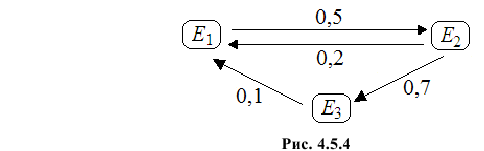

Пример 4.30.

Граф состояний марковской цепи изображен на рис. 4.5.4. При начальном распределении

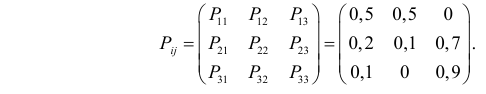

Решение. Переходная матрица этой цепи имеет вид

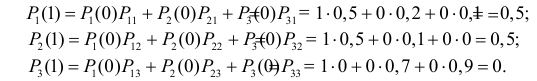

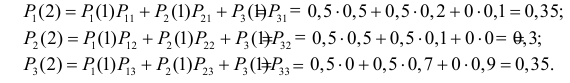

Найдем вероятности состояний цепи на первом шаге. Воспользуемся формулой (4.5.1), но учтем, что переходные вероятности нам каждом шаге одинаковы (цепь однородная) и поэтому

На втором шаге имеем вероятности состояний:

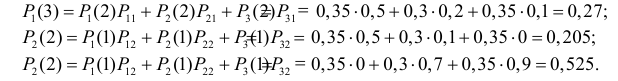

Для третьего шага получаем вероятности:

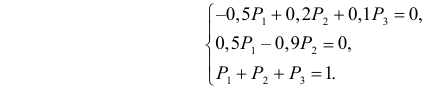

Можно, повторяя вывод уравнений (4.5.1), для определения финальных вероятностей записать систему равенств

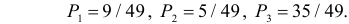

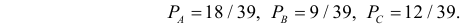

Решая систему, например, по правилу Крамера, получим

Ответ. Е2 – наименее вероятное состояние на третьем шаге;

Пример 4.31.

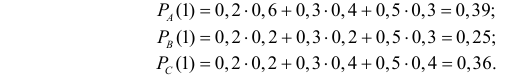

В городе N каждый житель имел одну из профессий A, B или C. Дети в следующем поколении сохраняли профессию отцов с вероятностями соответственно 0,6, 0,2 и 0,4 и с равными вероятностями выбирали любую из двух других профессий. Если в данный момент профессию A имеет 20% жителей города, профессию B – 30%, а профессию C – 50% жителей, то

1) каково распределение по профессиям будет в следующем поколении;

2) каким будет распределение по профессиям через много поколений (финальное распределение)?

Решение. Смену поколений будем считать шагом Марковской цепи. Имеем начальное распределение (на нулевом шаге):

В соответствии с формулами (4.5.1) получаем распределение вероятностей на первом шаге (в первом поколении):

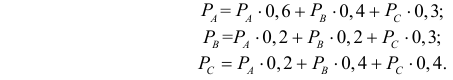

Для вычисления финальных вероятностей составляем систему уравнений (4.5.2)

Эта система уравнений при условии нормировки

Ответ.

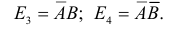

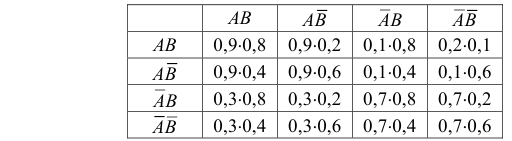

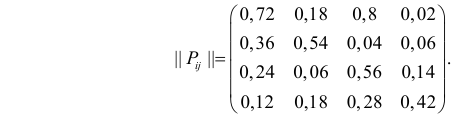

Пример 4.32.

Устройство состоит из двух блоков (например, двигатель и ходовая часть). Пусть A означает безотказную работу первого блока, B – безотказную работу второго блока. По истечении каждой единицы времени проверяется состояние этих блоков, и в случае неисправности производится их ремонт. Вероятность безотказной работы блоков в течение единицы времени равны соответственно 0,9 и 0,8. Если неисправность блока обнаружена, то вероятность отремонтировать блок в течение единицы времени равна соответственно 0,3 и 0,4. Найти предельные вероятности для состояний устройства:

Замечание. В сформулированном примере по умолчанию предполагается, что распределение времени безотказной работы и распределение времени ремонта каждого блока не имеют «памяти» о прошлом. Единственным распределением такого сорта является показательное распределение. Если, например, время ремонта распределено по показательному закону и ремонт уже продолжается некоторое время, то оставшаяся часть времени ремонта имеет то же самое распределение, что и в начале ремонта.

Решение. Поскольку состояния блоков наблюдаются в конце каждой единицы времени, то моменты наблюдения можно считать шагами однородной марковской цепи. Учитывая независимость времени безотказной работы и времени ремонта узлов, определим переходные вероятности:

В итоге переходная матрица имеет вид

Составим систему уравнений для определения финальных вероятностей:

Это система линейных однородных уравнений, она имеет бесконечно много решений. Для получения единственного нужного нам решения вместо любого из уравнений запишем условие нормировки

Ответ.

Пример 4.33.

В зоне обслуживания бригады ремонтников находится три прибора, работающих в автоматическом режиме. В конце каждого месяца ремонтники проводят профилактический осмотр приборов и, в случае обнаружения неисправных, забирают их для ремонта или замены на новые. Отремонтированный (или новый) прибор возвращают на место при очередном профилактическом осмотре, т.е. через месяц. Вероятность выхода из строя в течение месяца работающего прибора равна 1/3. Требуется найти стационарное распределение вероятностей числа исправных приборов в начале каждого месяца.

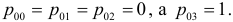

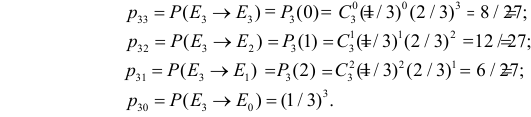

Решение. Рассмотрим марковскую цепь, состояния которой будем различать по числу работоспособных приборов. Пусть

Составим переходную матрицу этой цепи. Если на данном шаге цепь находится в состоянии E0, то на очередном шаге будут доставлены три работоспособных прибора и цепь с вероятностью 1 перейдет в состояние E3. Поэтому

Если на данном шаге цепи имеется только один работоспособный прибор, то следующем шаге будет поставлено два новых прибора и вероятность перехода

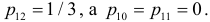

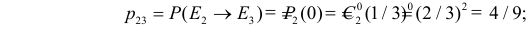

При наличии на данном шаге двух годных приборов в соответствии с формулой Бернулли, имеем переходные вероятности:

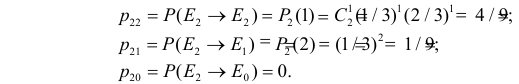

Наконец, при трех годных приборах на данном шаге

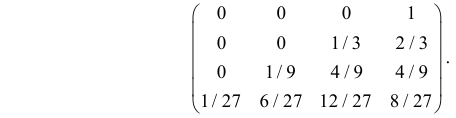

Запишем переходную матрицу:

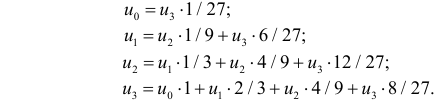

Этой переходной матрице соответствует система уравнений (4.5.2) для вычисления стационарных вероятностей:

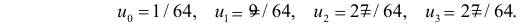

Решая эту систему уравнений, с учетом условия нормировки

Ответ.

Марковские процессы с непрерывным временем и дискретным множеством состояний

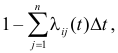

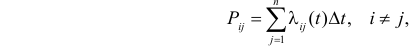

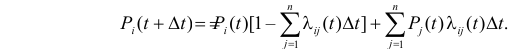

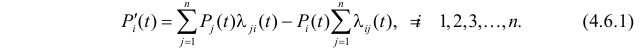

Пусть переходы процесса из состояния в состояние происходят под воздействием каких-то потоков событий (поток отказов, восстановлений и т.д.). Будем считать, что переход процесса из состояния Еi в состояние Ej происходит под воздействием пуассоновского потока событий интенсивности

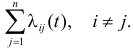

Суммарный поток событий, выводящих процесс из состояния Еi, тоже будет пуассоновским с интенсивностью

а вероятность сохранить состояние Еi за малый промежуток времени

Выведем уравнения для вероятностей состояний процесса

Если перегруппировать слагаемые, разделить равенство на

Это система уравнений Колмогорова А.Н. Для решения системы нужно задать начальные условия, а вместо одного из уравнений можно использовать условие нормировки

Пример 4.34.

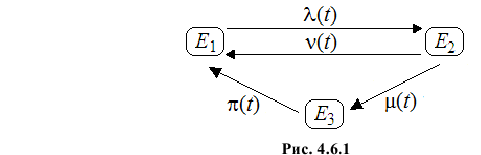

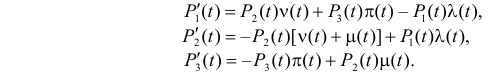

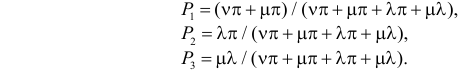

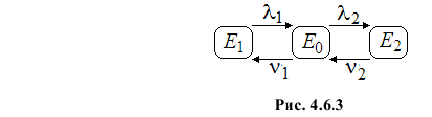

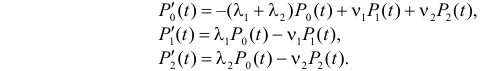

На рис. 4.6.1 дан граф состояний некоторого объекта. Интенсивности переходов из состояния в состояние указаны на этом же рисунке. Записать систему уравнений для вероятностей состояний объекта. При постоянных

Система уравнений Колмогорова (4.6.1) в рассматриваемом случае имеет вид

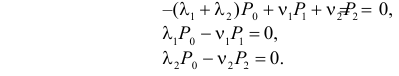

Вместо одного из уравнений (например, вместо второго) можно воспользоваться условием нормировки

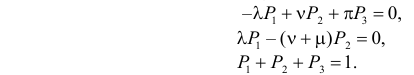

Если

Эта система имеет решение

Пример 4.35.

В некотором механизме могут происходить отказы двух типов. Пусть вероятность отказа первого типа в интервале времени

Решение. Обозначим через

Система уравнений (4.6.1) для этого случая имеет вид

Условия существования стационарных вероятностей марковского процесса выполнены. Поэтому при

Из второго и третьего уравнений находим соответственно

Откуда

Ответ.

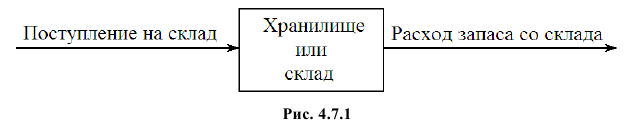

Модели управления запасами

В этом разделе мы рассмотрим простейшие математические модели функционирования систем, которые можно назвать хранилищем или складом. На рис. 4.7.1 изображена общая схема такой системы.

И поступление продукции и ее расход могут быть случайными и во времени и по объему.

Простым примером может служить водохранилище, уровень воды в котором зависит от притока (определяемого случайно выпадающими осадками) и расхода воды на разные нужды.

Представляют, например, интерес:

- 1) стационарное распределение запаса и условия его существования;

- 2) оптимальная политика пополнения и расхода запаса;

- 3) распределение периода нулевого уровня и т.д.

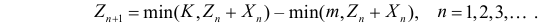

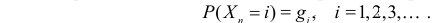

Для определенности будем говорить о модели водохранилища. Рассмотрим простейшую модель с дискретным временем, в которой уровень рассматривается в моменты

1. Приток. Пусть Xk – количество воды, поступившее в водохранилище за единицу времени (год, сутки, час и т.д.) от k до (k +1) моментов. Величины

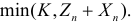

2. Сток. Пусть объем водохранилища равен K. Обозначим через Zn размер запаса в момент

3. Правило расхода воды. В момент времени

Последовательность

Упростим задачу еще, полагая приток дискретным. Пусть

В этом случае цепь Маркова имеет конечное число состояний

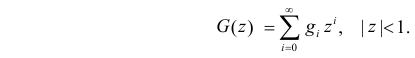

Найдем стационарное распределение размера запаса. Для простоты будем считать, что количество воды, расходуемой в момент

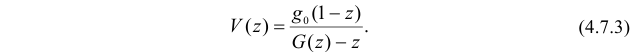

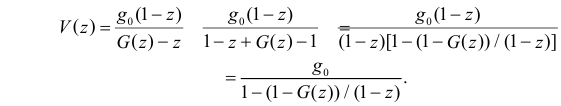

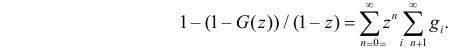

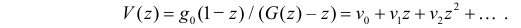

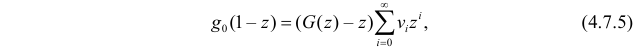

Обозначим производящую функцию распределения вероятностей

Тогда средний приток в единицу времени равен

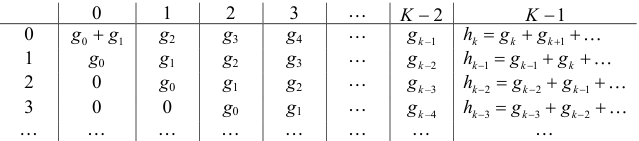

Матрица переходных вероятностей для цепи Маркова

Если все

которые являются единственным решением уравнений

при условии, что

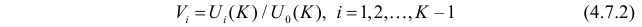

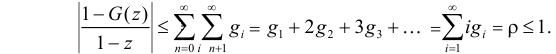

Теорема Морана (Moran P.). 1. Если

не зависят от K.

2. Значения

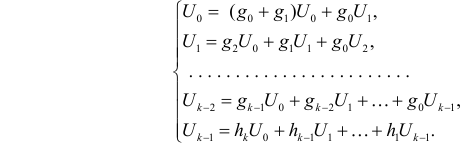

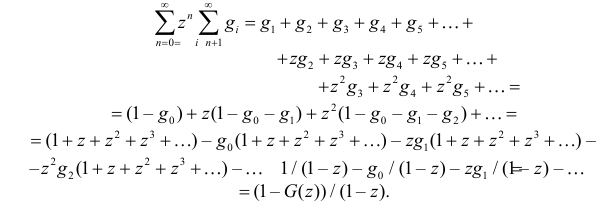

Доказательство. Для доказательства первой части теоремы достаточно записать уравнения для финальных вероятностей

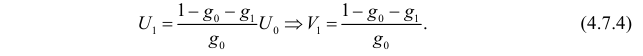

Решая последовательно эти уравнения, получим из первого уравнения:

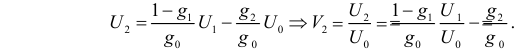

Из второго уравнения получим:

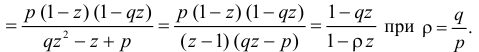

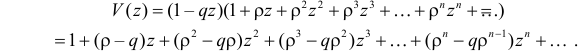

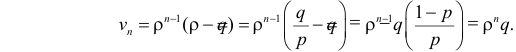

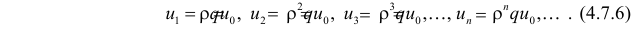

Продолжение этого процесса завершает доказательство первой части. Для доказательства второй части рассмотрим функцию

Можно показать, что

В самом деле,

Отсюда при

Здесь величина

Итак,

Коэффициенты

если приравнять коэффициенты при одинаковых степенях z в его правой и левой частях. Величины этих коэффициентов совпадают с их значениями по формулам (4.7.4). Этим и завершается доказательство теоремы.

Пример 4.36.

Пусть в хранилище объема K поступление запаса имеет распределение

При переполнении хранилища излишки теряются. Каждую единицу времени из хранилища потребляют единицу запаса. Требуется найти вероятность того, что к моменту очередного расхода запаса хранилище окажется пустым.

Решение. Воспользуемся теоремой Морана. Для этого сначала найдем производящую функцию для распределения случайной величины X.

Имеем

Если

Из этой записи следует, что

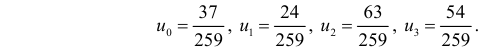

Эти коэффициенты можно преобразовать к виду:

Тогда в соответствии с формулами (4.7.2) имеем

Если объем хранилища неограничен, то из условия нормировки:

Тогда

Если же объем хранилища равен К, то согласно теореме Морана соотношения (4.7.6) остаются в силе, но условие нормировки имеет вид

Поэтому

Ответ.

Пример 4.37.

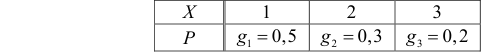

Хранилище имеет емкость шести единиц хранения (например, шесть контейнеров, шесть вагонов и т.д.). В течение каждого дня в хранилище поступает случайное количество продукции X. Величины X независимы и одинаково распределены:

При заполнении хранилища избыток поступившей продукции теряется. В конце каждого дня из хранилища отпускается потребителю две единицы продукции (или весь запас, если он меньше двух).

Для стационарного режима требуется найти: вероятность того, что поставляемая продукция будет полностью (без потерь) принята на хранение; вероятность того, что отпуск продукции будет производиться в полном объеме.

Решение. Будем рассматривать состояния хранилища мгновение спустя после очередной отгрузки. Тогда возможных состояний будет пять:

В нашем примере

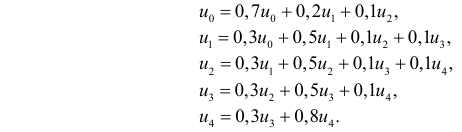

В соответствии с переходной матрицей запишем систему уравнений (4.7.1) для вычисления стационарных вероятностей:

Вместо любого из уравнений можно взять условие нормировки

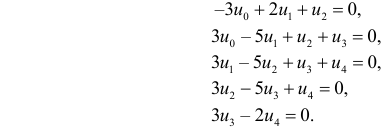

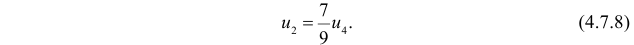

Структура уравнений системы такова, что позволяет легко выразить все неизвестные величины через одну из них. Например, из последнего уравнения имеем

Подставляя найденное выражение для u3 в предыдущее уравнение, получаем

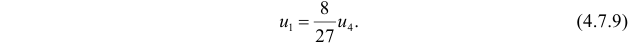

С учетом (4.7.7) и (4.7.8) из третьего уравнения находим, что

Из первого уравнения и соотношений (4.7.7) – (4.7.9) следует, что

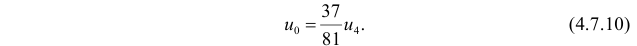

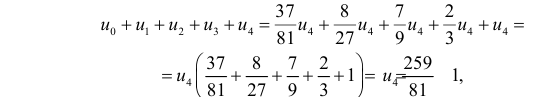

Воспользуемся теперь условием нормировки

откуда

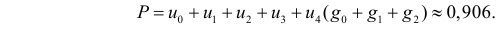

Поставляемая продукция будет полностью (без потерь) принята на хранение, если в хранилище, после очередной отгрузки, останется не более трех единиц продукции (вероятность чего равна

Математическое ожидание количества теряемой продукции при каждом ее поступлении равно

Вероятность того, что отпуск продукции будет производиться в полном объеме (в количестве двух единиц), равна

Заметим, что

Ответ. 0, 906; 0,962.

Пример 4.38.

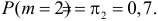

Хранилище имеет емкость пять единиц хранения. В течение каждого дня в хранилище поступает случайное количество X единиц продукции. Величины X независимы и имеют одинаковое распределение

При заполнении хранилища избыток поступившей продукции теряется. В конце каждого дня из хранилища отпускается потребителю случайное число

Для стационарного режима найдите: вероятность того, что поставляемая продукция будет полностью (без потерь) принята на хранение; вероятность того, что отпуск продукции будет производиться в полном объеме.

Решение. Если рассматривать состояние хранилища в моменты сразу после очередной отгрузки продукции, то имеется пять возможных состояний:

Переход

Переходы

Переходы

Хранилище сохранит свое состояние E2 или E3, если поступит столько единиц хранения, сколько и будет отгружено. Поэтому

Переходы

Для перехода

Переход

Если в хранилище четыре единицы продукции, то при любом поступлении новой продукции хранилище будет заполнено целиком. Тогда для перехода

Хранилище сохранит свое состояние E4, если при поступлении любого количества единиц хранения (хранилище тогда будет заполнено) будет отгружена одна единица хранения. Вероятность этого

Итак, переходная матрица имеет вид:

В соответствии с переходной матрицей запишем систему уравнений (4.7.1) для вычисления стационарных вероятностей:

Это система линейных однородных уравнений. Вместо любого из уравнений можно взять условие нормировки

Вероятность потери поступающей продукции из-за переполнения склада равна

Вероятность отгрузки в требуемом объеме равна

Ответ. 0,9275; 0,9153.

Полумарковские процессы

Случайный процесс конечным числом состояний называется полумарковским процессом (ПМП), если время пребывания процесса в каждом из состояний случайно и зависит только от этого состояния и от того, в какое состояние затем перейдет процесс.

Пусть

- матрицу вероятностей переходов

- матрицу функций распределения

– функция распределения времени пребывания процесса в состоянии

при условии, что следующим состоянием будет

- начальное распределение

(например,

при

– это означает, что процесс начинается из состояния Е1).

Заметим, что марковский процесс с непрерывным временем и конечным числом состояний можно считать ПМП, у которого время пребывания в каждом состоянии распределено показательно. Марковскую цепь можно рассматривать в непрерывном времени как ПМП, у которого время пребывания в каждом состоянии равно 1.

Практический интерес представляют многие характеристики ПМП:

- среднее время достижения состояния

из начального состояния;

- среднее число попаданий в состояние

за время t;

- стационарные вероятности того, что процесс находится в состоянии

.

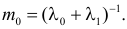

Рассмотрим способы вычисления некоторых характеристик процесса. Если обозначить функцию распределения времени пребывания в состоянии

где

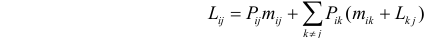

Обозначим через

или

Откуда в силу (4.8.1) получаем систему уравнений для определения

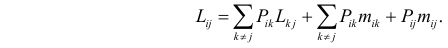

Аналогично можно провести рассуждения о среднем времени пребывания процесса в множестве состояний M. Обозначим через

В заключение приведем частичную формулировку одной из важных теорем о ПМП.

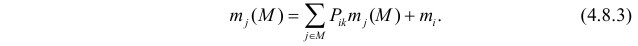

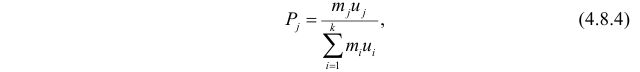

Теорема Пайка (Pyke). Стационарные вероятности пребывания процесса в состояниях

где

Пример 4.39.

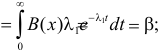

Пусть устройство состоит из трех однотипных приборов. В момент времени t=0 начинает работу прибор №1, который спустя случайное время Т1 выходит из строя. В этот момент начинает работу прибор №2, длительность безотказной работы которого равна Т2, и начинается ремонт прибора № 1, причем время ремонта равно

Пусть

Процесс

Для процесса

Остается вычислить среднюю длительность пребывания системы в множестве состояний

С учетом значений вероятностей переходов

Ответ.

Пример 4.40.

В одноканальную систему с потерями поступает простейший поток требований интенсивности

Решение. Будем различать состояние E0, в котором обслуживающий прибор исправен и свободен, состояние E1, в котором прибор обслуживает требование, состояние E2, в котором прибор неисправен и ремонтируется. Пусть

1. Переходные вероятности:

Итак, переходная матрица имеет вид:

Запишем уравнения для финитных вероятностей вложенной цепи:

Из первого и второго уравнений следует, что

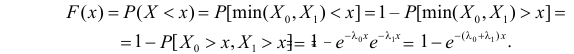

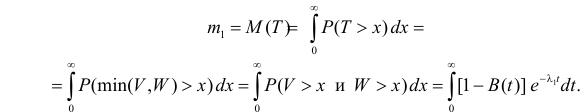

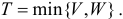

2. Вычислим теперь среднее время пребывания в каждом из состояний. Время пребывания в состоянии E0 равно минимальному из времени паузы и времени безотказной работы свободного прибора. Пусть X – время пребывания в состоянии E0, X0 – время безотказной работы в ненагруженном состоянии, а X1 – время до прихода ближайшего требования. Тогда X имеет функцию распределения

Это показательный закон распределения с параметром

Это равенство получается из следующих соображений. Если X – неотрицательная случайная величина с функцией распределения

в этом можно убедиться, взяв по частям интеграл в правой части равенства.

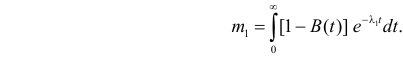

Пусть T – время пребывания системы в состоянии E1, V – время обслуживания, W – время безотказной работы прибора в занятом состоянии. Тогда

Время пребывания в состоянии E3 равно времени ремонта. Поэтому

Доля времени пребывания в отказном состоянии равна стационарной вероятности состояния E2. По формуле (4.8.4) эта стационарная вероятность равна

Ответ.

Задачи с решением на случайные процессы

Поток требований называется простейшим, если интервалы времени между последовательными моментами прихода требований независимы и имеют показательный закон распределения.

Заметим, что в показательном законе распределения наиболее вероятны малые значения случайной величины. Это означает, что часто будут реализовываться малые интервалы между требованиями и редко – большие. Для наблюдателя это будет выглядеть как локальные сгущения требований и локальные разряжения. Тем самым подтверждается бытующее представление о «полосе везения» и «полосе невезения». Действительно, случайные события, даже будучи независимыми, имеют свойство группироваться во времени.

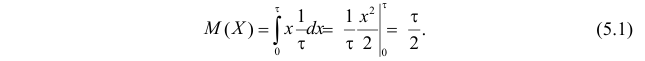

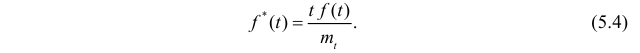

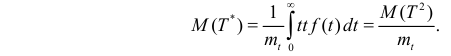

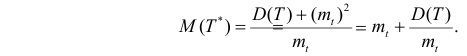

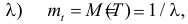

Задача 5.1 (о времени ожидания).

Отметим одну особенность простейшего потока, связанную с «парадоксом времени ожидания». Предположим сначала, что к остановке с равными интервалами подходят автобусы (поток автобусов детерминированный). Пассажир в случайный момент времени приходит на остановку и ожидает ближайшего по времени автобуса. Каково среднее время ожидания пассажира?

Решение. Пусть интервал между автобусами равен t. Так как равновозможно любое значение времени ожидания Х в пределах от 0 до

Пусть теперь моменты прибытия автобусов на остановку образуют простейший поток интенсивности

Интеграл можно взять по частям. Поэтому

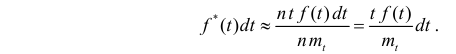

Плотность вероятности того, что момент прихода пассажира придется на интервал между автобусами длины

Согласно (5.1) при интервале между автобусами длиной х среднее время ожидания равно

(последний интеграл дважды берется по частям). Итак, при регулярном потоке среднее время ожидания равно половине интервала между прибытиями автобусов. При чисто случайном потоке автобусов среднее время ожидания совпадает со средним интервалом между автобусами.

Заметим, что среднее время ожидания пассажира может быть значительно больше среднего интервала между автобусами. Например, пусть автобусы приходят по расписанию, но такому, что сначала подряд с интервалами в две минуты проходят пять автобусов, а шестой приходит через 50 минут. Тогда средний интервал будет равен

Пассажир может с вероятностью 1/5 попасть на череду коротких интервалов между автобусами и среднее время ожидания для него будет равно 1 мин. На большой интервал можно попасть с вероятностью 5/6 и тогда среднее время ожидания будет 25 мин. Поэтому среднее время ожидания равно

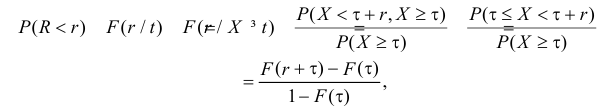

Проведем рассмотрение в общем случае. Момент, начиная с которого мы начинаем наблюдать поток событий, можно считать случайной точкой

Найдем плотность вероятности

Чтобы вычислить эту вероятность, предположим, что имеем дело с большой серией из n интервалов. Среднее число интервалов, имеющих длину в пределах от

При

Средняя длина интервала, в который попала точка, равна

Так как

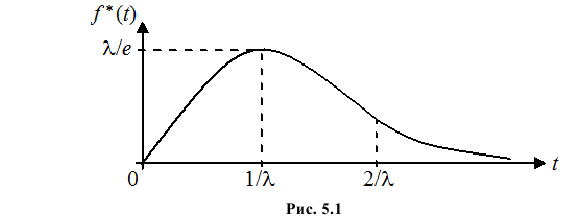

Например, для показательного закона распределения интервалов (для простейшего потока событий интенсивности

График этой функции плотности вероятности

Пусть

откуда

Задача 5.2 (о наилучшем выборе)

Имеется n однородных предметов различного качества, причем заранее о предметах ничего не известно. Предметы можно выбирать наугад по одному и обследовать. Если качество предмета нас не устраивает, то выбираем очередной предмет, но к отвергнутому предмету вернуться нельзя. Какой стратегии следовать, чтобы вероятность выбрать наилучший предмет была наибольшей? (Эту задачу называют еще задачей о разборчивой невесте. К невесте последовательно сватаются n женихов. Жених, получивший отказ, повторно не сватается.)

Решение. Поскольку качество этих предметов нам неизвестно, то для начала необходимо получить представление о том, чего следует ожидать. Рассмотрим следующий порядок действий: Просмотрим

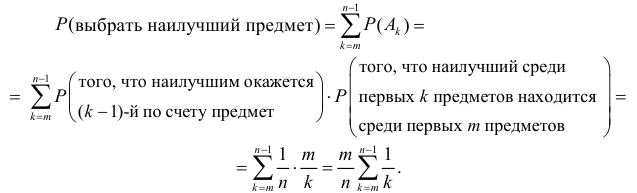

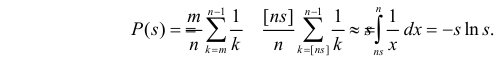

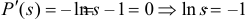

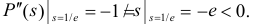

Вычислим вероятность выбрать наилучший предмет при таком образе действий, а затем определим оптимальное значение

Обозначим через

Выберем число s между 0 и 1 и пусть

Найдем максимальное значение функции

Итак, оптимальная стратегия рекомендует просмотреть примерно треть предметов (точнее,

Задача 5.3.

Вы принимаете участие в телеигре, и Вам предлагают выбрать одну из трех шкатулок, в одной из которых лежат деньги. Вы выбрали некоторую шкатулку (например, шкатулку №1). Ведущий после этого открывает одну из двух других шкатулок (например, шкатулку №3), показывает, что она пуста, и спрашивает: не желаете ли Вы изменить свое решение и выбрать шкатулку №2? Следует ли Вам менять свое решение или нет?

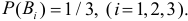

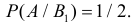

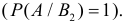

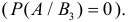

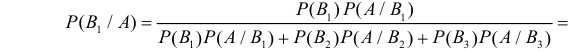

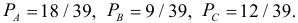

Решение. Будем полагать, что ведущий знает, где деньги лежат, и поэтому открывает именно пустую шкатулку. Насчет шкатулки с деньгами есть три одинаково вероятных предположения:

Событие A состоит в том, что Вы выбрали шкатулку №1, а ведущий открыл шкатулку №3. При пустой третьей шкатулке в силу симметрии Ваши шансы на выигрыш равны 1/2.

Если деньги действительно находятся в первой шкатулке, то ведущий с вероятностью 1/2 откроет именно шкатулку №3. Поэтому

Если деньги находятся во второй шкатулке, то ведущий с вероятностью 1 откроет именно шкатулку №3

Если деньги в третьей шкатулке, то вероятность выбора ведущим третьей шкатулки нулевая

По формулам Байеса

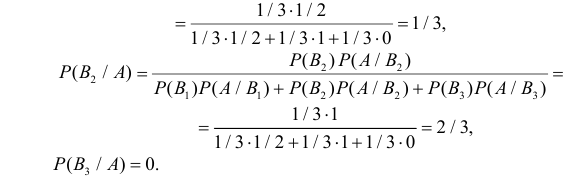

Если ведущий не знает где деньги лежат, то

Итак, игроку предварительно следует осведомиться у ведущего, знает ли он где деньги лежат. При положительном ответе следует изменить свой выбор. Если ведущий не знает, в какой шкатулке деньги, то менять выбор смысла нет.

Задача 5.4.

Производитель некоторой продукции затеял рекламную акцию. Объявлено, что в каждый пакет продукта заложен один из n различных типов жетонов. Покупатель, собравший все n типов жетонов, получает дисконтную карту для длительных скидок на этот продукт. Сколько в среднем пакетов продукта придется купить, чтобы собрать полный комплект из n различных жетонов?

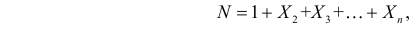

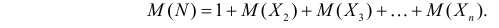

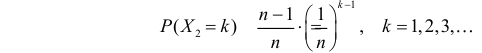

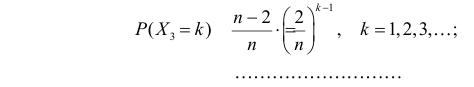

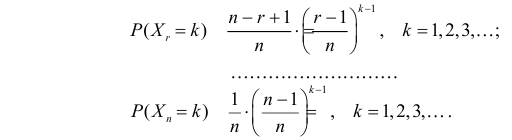

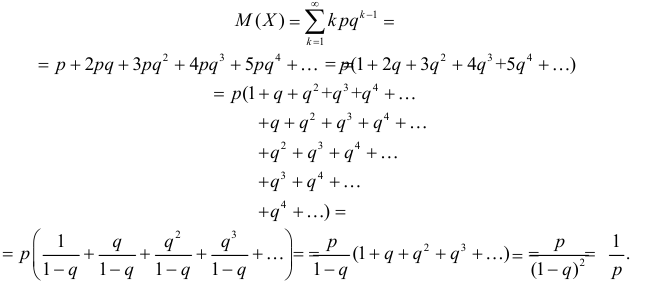

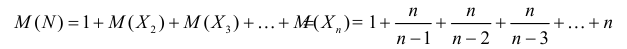

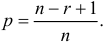

Решение. Понятно, что по мере накопления жетонов, шансы найти новый жетон в очередном пакете убывают. Обозначим через

А математическое ожидание этого числа равно

Вероятность того, что для поиска второго жетона придется вскрыть k пакетов, равна

(имеется в виду, что

Известно, что это геометрический закон распределения. Но для геометрического закона распределения:

В нашем случае для

или

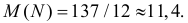

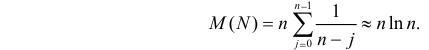

Например, при

В заключение можно заметить, что при больших n можно воспользоваться асимптотической формулой

Приложения

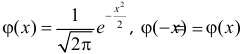

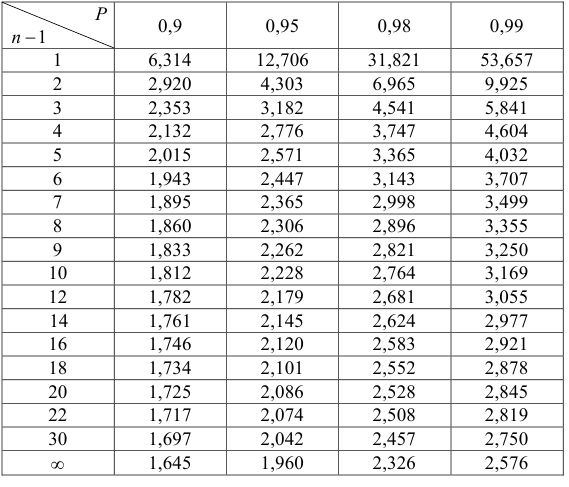

Таблица П.1

Таблица значений функции

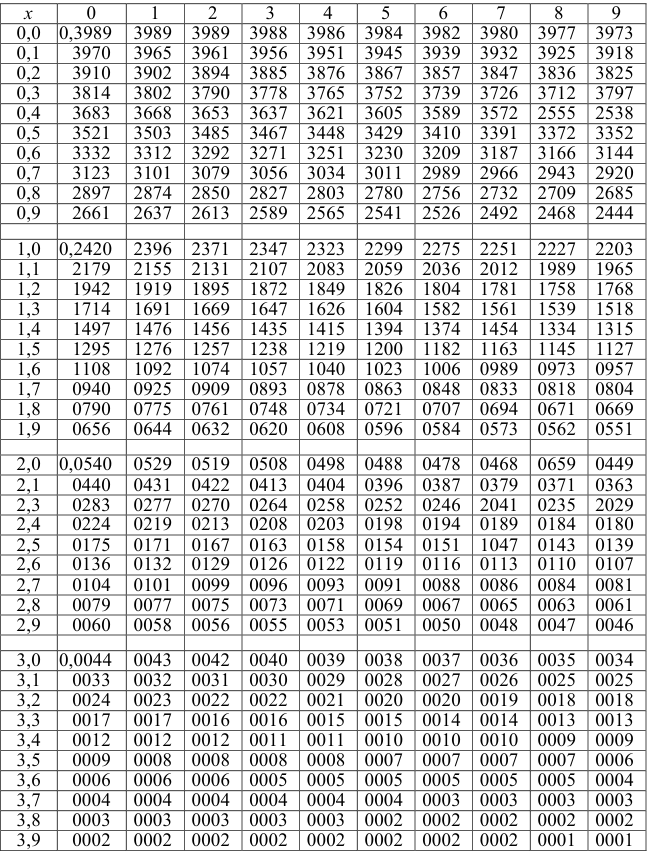

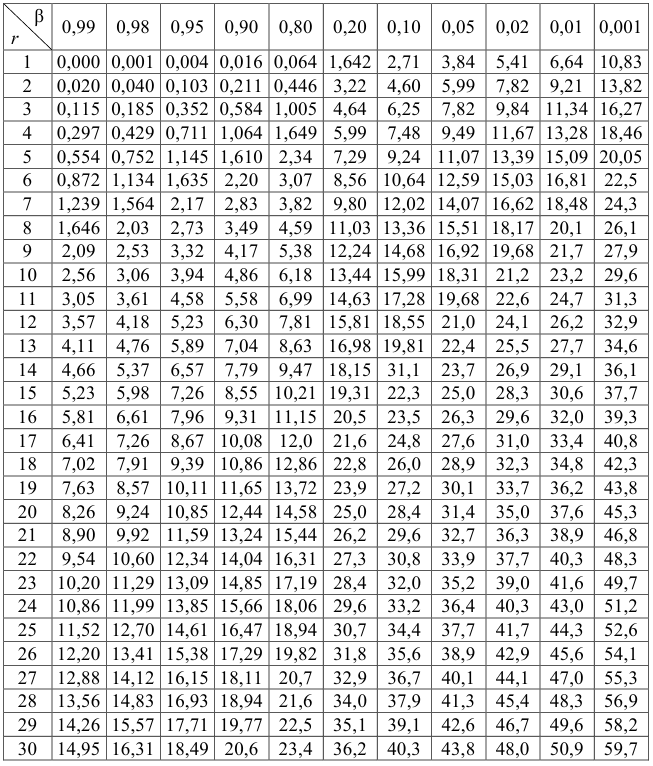

Таблица П.2

Таблица значений функции

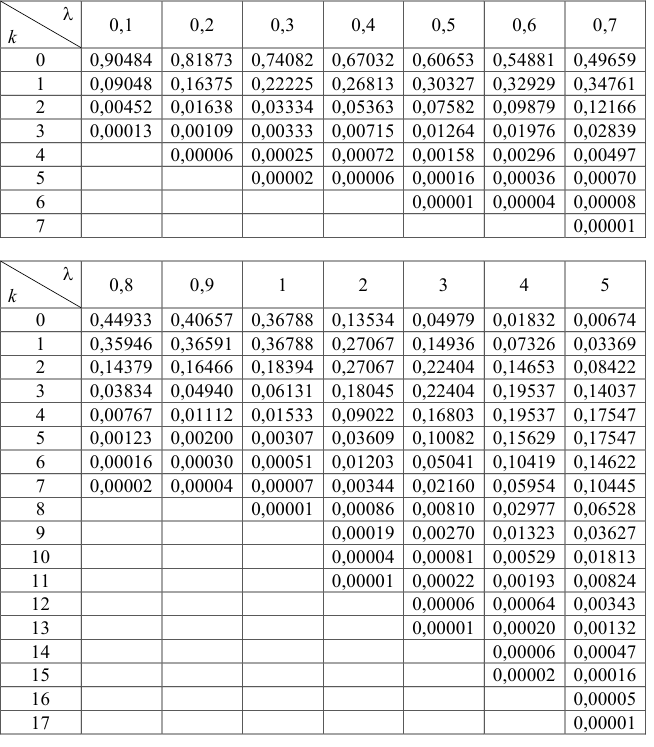

Таблица П.3

Значения

Таблица П.4

Значения

Таблица П.5

Значения функции

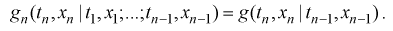

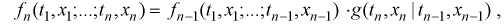

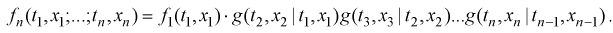

Определение случайных процессов

Элементы теории случайных процессов:

Пусть задано вероятностное пространство

Рассмотрим функцию

Случайным процессом называется случайная величина

Пусть

Рассмотрим отсчет

Если нас интересует только

Более подробное представление о случайном процессе получается, если рассматривать два отсчета

Чем больше берется отсчетов и чем ближе они расположены друг к другу, тем подробнее описывается случайный процесс.

В пределе, когда

Числовые характеристики случайного процесса

При экспериментальном получении случайного процесса можно сравнительно легко указать

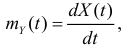

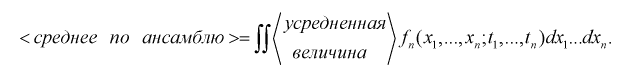

Математическое ожидание случайного процесса (среднее по ансамблю) вводится следующим образом:

В отличие от теории вероятностей

Оно дает некоторую кривую, около которой группируются все реализации случайного процесса (рис. 13.2).

Дисперсия случайного процесса (средняя по ансамблю):

Дисперсия определяет, насколько сильно отдельные реализации могут отклоняться от математического ожидания. В отличие от теории вероятностей это также не число, а функция времени.

Функция корреляции случайного процесса (средняя по ансамблю)’.

Эта функция является важнейшей характеристикой случайного процесса.

Функция корреляции характеризует степень зависимости между отсчетами случайного процесса, взятыми в разные моменты времени.

Наряду с

И нормированная функция корреляцию.

Последняя ничем по смыслу не отличается от коэффициента корреляции и определяет степень линейной зависимости отсчетов случайного процесса в моменты времени

Стационарные случайные процессы

Случайный процесс называется стационарным в узком смысле, если для любых

Смысл определения в следующем.

В левой части равенства стоят отсчеты, берущиеся в моменты времени

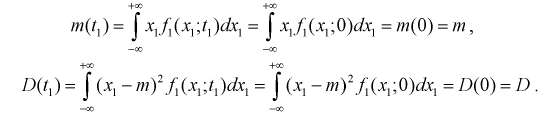

Следствия стационарности:

1. Предположим в (13.7)

Поскольку

Поэтому

Отметим, что у стационарных случайных процессов математическое ожидание, дисперсия и плотность распределения от времени не зависят

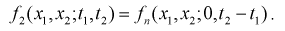

2. Полагая в (13.7)

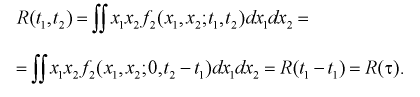

Тогда функция корреляции принимает вид

Видим, что у стационарных случайных процессов функция корреляции зависит лишь от разности

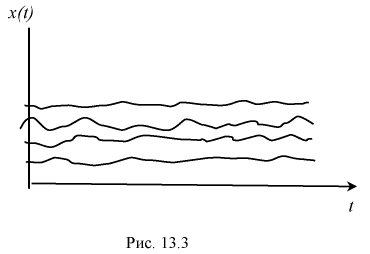

Случайный процесс называется стационарным в широком смысле, если его математическое ожидание и дисперсия от времени не зависят, а функция корреляции зависит лишь от разности моментов времени

На рис. 13.3 показан вид стационарного случайного процесса.

Числовые характеристики случайного процесса — средние по времени

Ранее мы рассмотрели числовые характеристики случайного процесса, средние по ансамблю, общий вид которых

Они называются средними по ансамблю потому, что фиксируются моменты времени

изображены Кривые плотностей распределений

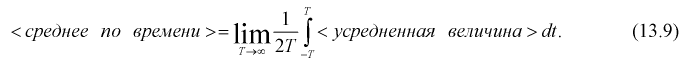

Для стационарных случайных процессов кроме средних по ансамблю можно ввести еще так называемые средние по времени. В общем виде среднее по времени представляет собой:

Характерным для средних по времени является то, что фиксируются реализации, а «перебираются» все моменты времени. В средних по времени характерно также отсутствие плотности распределения

Тогда числовые характеристики средние по времени определяются так:

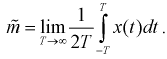

1. Математическое ожидание случайного процесса среднее по времени:

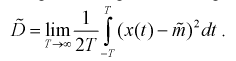

2. Дисперсия случайного процесса средняя по времени:

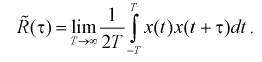

3. Функция корреляции, средняя по времени (в ней фигурирует произведение значений случайного процесса в два различных момента времени

Свойства функций корреляции случайного процесса

1. Функция корреляции является симметричной функцией:

Для стационарного случайного процесса — четная функция:

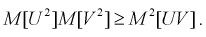

2. Функция корреляции — ограниченная функция. Воспользуемся неравенством

Шварца (неравенство Коши-Буняковского):

Обозначим отсчеты

С учетом определения (13.4), получаем

Тогда

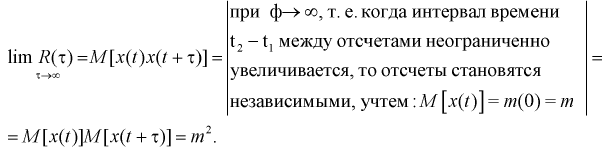

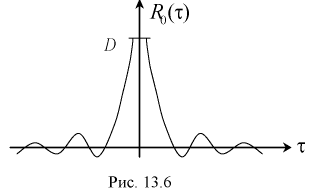

Когда

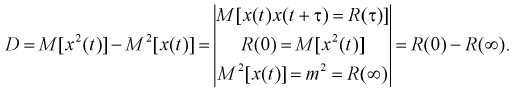

3. Для стационарного случайного процесса дисперсия и математическое ожидание могут быть получены через функцию корреляции:

Откуда следует, что

Найдем дисперсию:

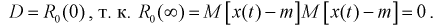

Если рассматривать функцию корреляции флуктуаций (13.5), то

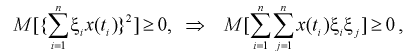

4. Функция корреляции является положительно определенной функцией.

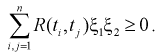

Рассмотрим моменты времени

вычисляя математическое ожидание, получим

Следствие: для любой положительно определенной функции

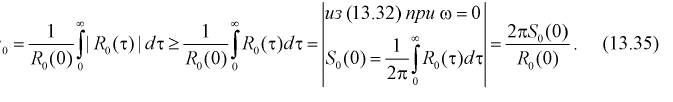

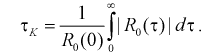

5. Время корреляции для стационарного случайного процесса определяется как

Время корреляции определяет, насколько далеко по времени наблюдается корреляционная связь между отсчетами в случайном процессе.

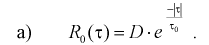

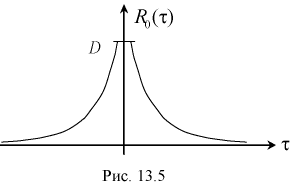

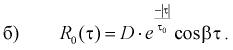

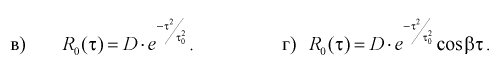

6. При изучении реальных случайных процессов для

Зависимость

Зависимость

Эргодические случайные процессы

Случайный прогресс называется эргодическим, если для него временные средние с вероятностью, равной 1, совпадают с соответствующими средними по ансамблю:

Эргодическим может быть только стационарный случайный процесс, но не всякий стационарный случайный процесс может быть эргодичен. Эргодичность имеет большое значение: она позволяет заменить изучение ансамбля реализаций изучением одной длинной реализации, т. к. каждая реализация (у эргодического случайного процесса) с вероятностью 1 имеет те же характеристики, что и весь ансамбль.

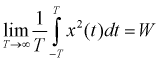

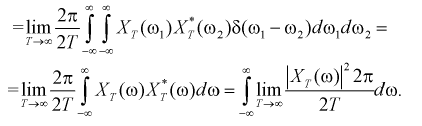

Спектр мощности случайного процесса

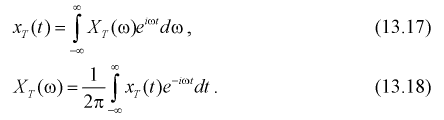

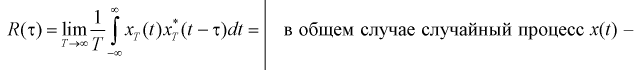

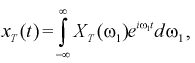

Для стационарного случайного процесса

Тогда

Рассмотрим величину

ее свойство:

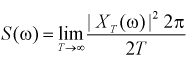

Обозначим

Тогда запишем среднюю мощность так:

где

Спектр мощности не является независимой характеристикой случайного процесса. Спектр мощности

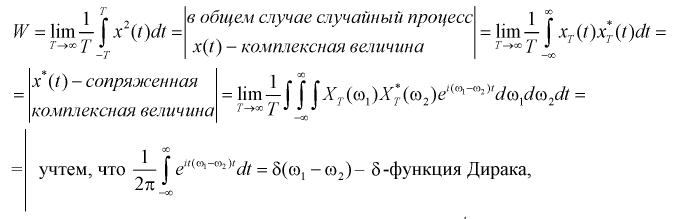

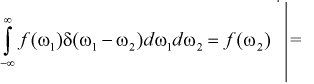

Теорема Винера-Хинчина

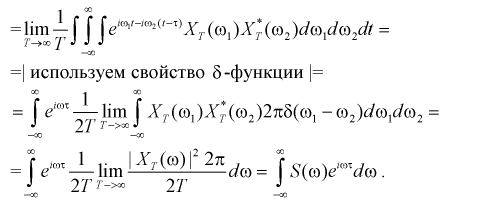

Эта теорема устанавливает связь между спектром мощности и функцией корреляции. Запишем функцию корреляции (13.12) через урезанный случайный процесс:

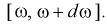

комплексная величина, поэтому запишем

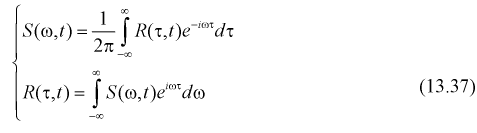

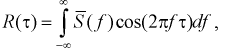

Таким образом, видим, что функция корреляции является прямым преобразованием Фурье от спектра мощности

Тогда спектр мощности определится через обратное преобразование Фурье:

Запишем спектр мощности через тригонометрические функции, используя формулу Эйлера:

Последний интеграл в (13.24) равен нулю, т. к.

Отсюда следует, что спектр мощности

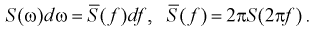

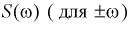

В формулы (13.25), (13.26) входит круговая частота

В этих формулах фигурируют отрицательные частоты от

В (13.29) мощность отрицательных частот прибавили к мощности положительных, тогда

Если вместо

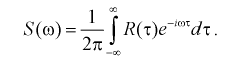

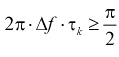

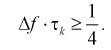

Соотношение неопределенности для стационарных случайных процессов

Шириной спектра случайного процесса называется величина

Время корреляции

Умножая (13.34) на (13.35) получаем

Подставляя в

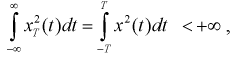

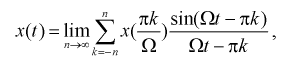

Разложение случайного процесса в ряд Котельникова

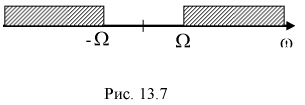

Пусть

Теорема: Если

где

На рис. 13.7 показана заштрихованная область частот, для которой спектр мощности

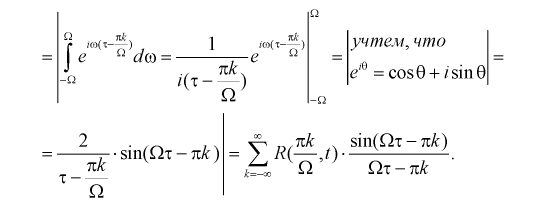

Доказательство:

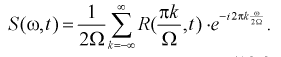

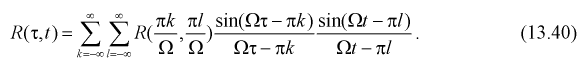

Предположим, что спектр мощности является периодической функцией с периодом

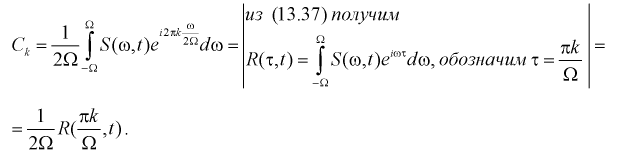

Коэффициенты

Подставим

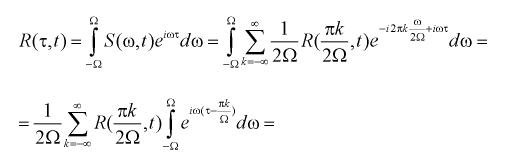

Определим функцию корреляции, используя (13.37):

Поскольку функция корреляции симметрична, то можно записать

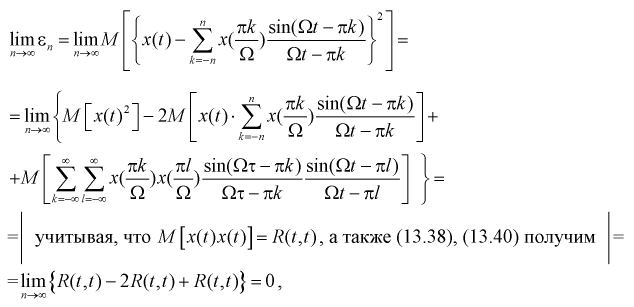

Докажем основное положение теоремы. Используем следующее определение сходимости: Последовательность случайных величин

Используя (13.38), можно записать

что и является доказательством нашей теоремы.

Классификация случайных процессов

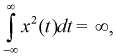

Ранее, в разделе 13.1 мы отмечали, что все случайные процессы делятся на два основных класса: прогрессы с дискретным временем и процессы с непрерывным временем. После описания вероятностных характеристик случайного процесса, в частности

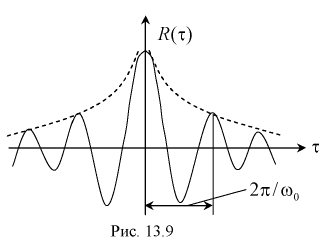

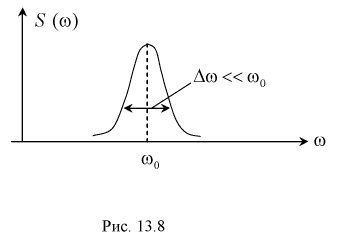

Иногда стационарные случайные процессы классифицируют по спектральным

характеристикам: различают стационарные случайные процессы в широком смысле — узкополосные, когда спектр мощности сосредоточен в узкой полосе частот возле определенной фиксированной частоты

Из рис. 13.9 видим, что функция корреляции узкополосного случайного процесса — это быстро осциллирующая функция с частотой

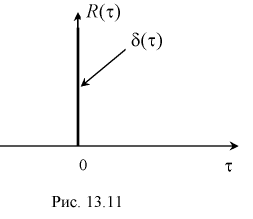

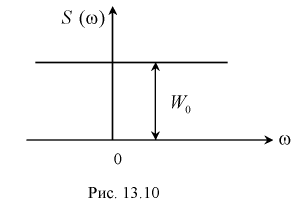

Следующим классом будут стационарные в широком смысле случайные процессы — широкополосные. Здесь спектр мощности сохраняет постоянное значение

Тогда стационарный в широком смысле случайный процесс с равномерным спектром мощности на всех частотах называется белым шумом. Функция корреляции белого шума представляет собой 5-функцию, расположенную в начале координат, (рис. 13.11):

Для белого шума характерно то, что два его отсчета, взятые в сколь угод но близкие моменты времени, некоррелированы. Однако на практике белый шум реализовать невозможно, т. к. полная мощность белого шума бесконечна, а реальные случайные процессы имеют конечную мощность. И для реального случайного процесса рядом стоящие отсчеты коррелированы. Поэтому белый шум используют в качестве математической модели случайного процесса, что позволяет упростить анализ прохождения через линейные радиотехнические устройства с конечной полосой пропускания. Отметим, что любой случайный процесс, у которого спектр мощности сохраняет постоянное значение в некоторой полосе частот, может рассматриваться как белый шум. Но таких случайных процессов в природе не существует. Тем не менее такая модель случайного процесса оказывается удобной для анализа различных радиотехнических систем.

Еще одной моделью случайных процессов, которая находит широкое применение в приложениях теории случайных процессов, являются марковские случайные процессы.

Марковские случайные процессы

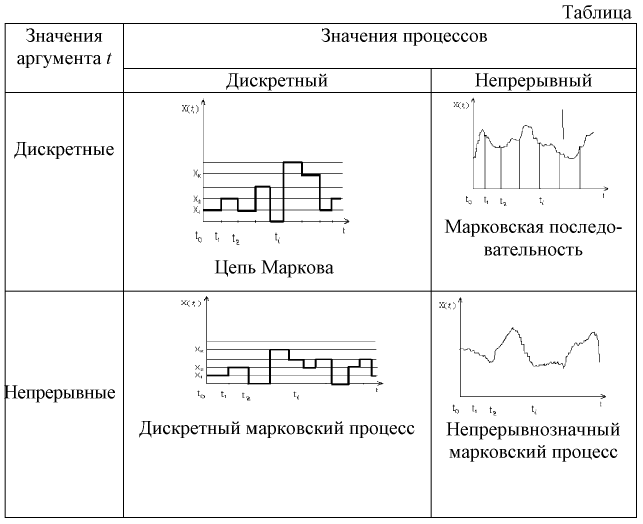

Марковские случайные процессы делятся на четыре основных типа в зависимости от того, какое множество значений (дискретное или непрерывное) принимает случайный процесс

(непрерывный процесс с непрерывным временем). Ниже в таблице приведены временные реализации для этих процессов.

Марковскими процессами называются такие, в которых будущее не зависит от прошлого, а определяется только настоящим.

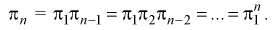

Цепи Маркова

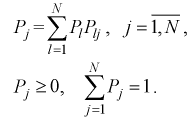

Пусть некоторая физическая система может находиться в состояниях

Дискретной цепью Маркова называется такой случайный процесс, в котором вероятность того, что система окажется в некотором состоянии

Можно отметить, что в цепях Маркова зависимость между состояниями простирается лишь на один шаг назад.

Введем понятие переходной вероятности — это вероятность перехода системы из одного состояния в другое:

Если

Свойства матрицы переходных вероятностей:

1.

2. Сумма по строке —

Матрицы, удовлетворяющие этим свойствам, называются стохастическими. Величины

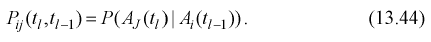

Вероятность перехода за

Формула Маркова для цепей

Обозначим через

Применяя последовательно формулу (13.47), получим

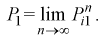

Можно ожидать, что при переходах в п шагов влияние начального распределения с ростом

Пусть

Пусть существует предел

Тогда говорят, что существует предельное, финальное, распределение вероятностей

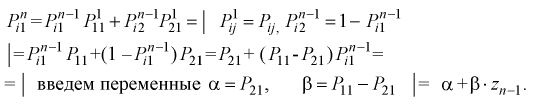

Пример №8

Дана цепь Маркова, которая описывается матрицей переходных вероятностей

Необходимо определить вероятность

Решение.

Запишем вероятность перехода за

Обозначая

Учтем, что

Найдем предел при

Тогда искомая вероятность вычисляется так:

Марковские процессы с непрерывным временем

Случайный процесс X(t) называется марковским, если для любого момента времени

Среди марковских процессов с непрерывным множеством состояний наиболее важными являются процессы, которые имеют

1.

2. Плотность любого

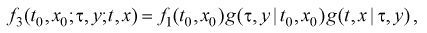

Условная вероятность для марковского процесса

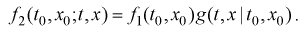

Поскольку вероятностные свойства процесса в момент

Условную плотность распределения

Зная, что

Учитываем свойство марковских цепей:

Тогда

Отсюда видно, что для задания

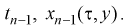

Рассмотрим 3 момента времени:

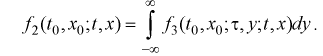

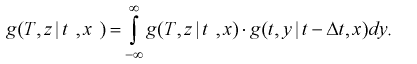

Используя (13.49) для

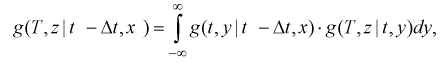

Подставляя в (13.57) уравнения (13.55) и (13.56), получим

Это уравнение Смолуковского (или Колмогорова-Чепмена) является основным в теории непрерывных марковских процессов.

Уравнения Колмогорова

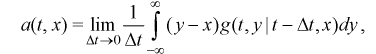

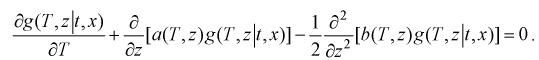

Введем следующие обозначения:

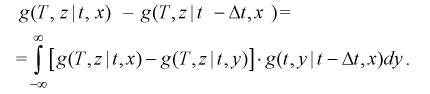

Запишем переходные вероятности через уравнение Смолуковского в моменты

Вычтем из формулы (13.60) формулу (13.59):

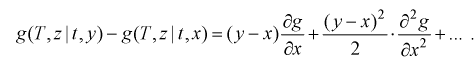

Разложим в ряд Тейлора функцию

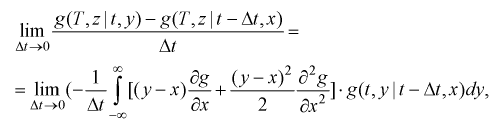

Подставляя это разложение в интеграл (13.61), разделим левую и правую часть на

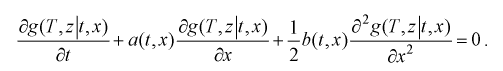

Это первое уравнение Колмогорова, где

Аналогично выводится втрое уравнение Колмогорова:

Здесь

Непрерывный марковский процесс, который описывается уравнениями (13.63) и (13.66) называется диффузионным. Коэффициент

Уравнение (13.66) называется прямым уравнением Колмогорова, а уравнение (13.63) называется обратным уравнением Колмогорова. Уравнения Колмогорова относятся к классу параболических дифференциальных уравнений в частных производных.

- Выборочный метод

- Статистическая проверка гипотез

- Статистические оценки

- Теория статистической проверки гипотез

- Проверка статистических гипотез

- Регрессионный анализ

- Корреляционный анализ

- Статистические решающие функции

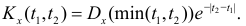

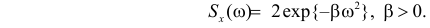

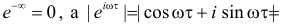

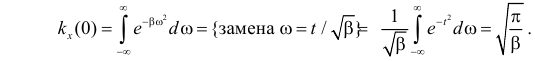

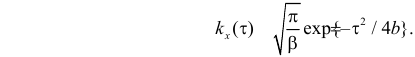

Стационарные случайные процессы

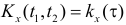

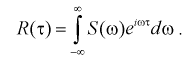

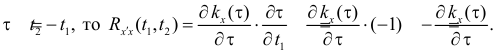

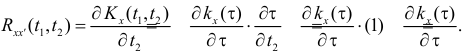

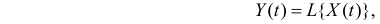

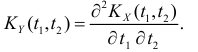

Случайный процесс (или функция) называется станционарным, если его математическое ожидание постояенно, а корреляционная функция зависит только от разности аргументов $t_2-t_1$:

$$K_x(t_1, t_2)=k_x(t_2-t_1)=k_x(tau).$$

Отсюда следует, что дисперсия станционарной случайной функции постоянна и равна $D_x=k_x(0).$

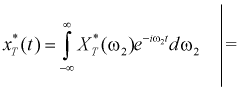

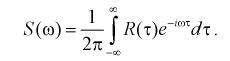

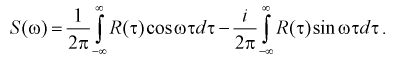

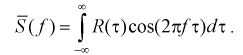

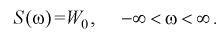

Для стационарной случайной функции вводят спектральную плотность $s_x(w)$, которая связана с корреляционной функцией $k_x(tau)$ взаимно-обратными преобразованиями Фурье:

$$

s_x(w)=frac{1}{2pi}int_{-infty}^{infty} k_x(tau)e^{-iwtau} dtau, quad

k_x(tau)=int_{-infty}^{infty} s_x(w)e^{iwtau} dw.

$$

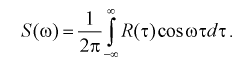

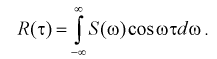

Эти формулы называют формулами Винера-Хинчина. В действительной форме они принимают вид:

$$

s_x(w)=frac{1}{pi}int_{0}^{infty} k_x(tau) cos{wtau} dtau, quad

k_x(tau)=2int_{0}^{infty} s_x(w) cos{wtau} dw.

$$

Ранее: Примеры решений для случайных процессов.

Полезная страница? Сохрани или расскажи друзьям

Примеры решений

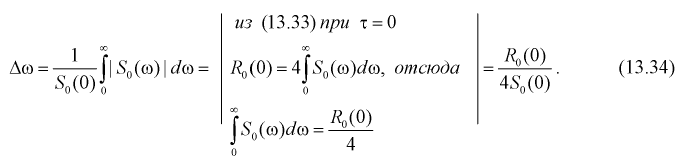

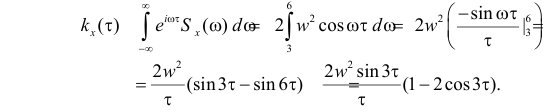

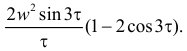

Задача 1. Найти спектральную плотность стационарной случайной функции $X(t)$, если ее корреляционная функция имеет вид:

$$

k_x(tau)=

left{

begin{array}{l}

1-0,5|tau|,, |tau| le 2\

0,, |tau|gt 2. \

end{array}

right.

$$

Задача 2. Дана спектральная плотность

$$

S_q(w)=

left{

begin{array}{l}

a,, |w| le N\

0,, |w|gt N. \

end{array}

right.

$$

Определить корреляционную функцию $K_xi(tau)$ и дисперсию $D_xi$.

Задача 3. Найти спектральную плотность стационарной случайной функции X(t), если ее корреляционная функция имеет вид: $k_x(tau) = e^{-0,3|tau|}$.

Задача 4. Найти одностороннюю $S(w)$ и двустороннюю $S^*(w)$ спектральную плотность стационарного случайного процесса с корреляционной функцией $k(tau) = e^{-6tau} cos 2tau$.

Задача 5. Случайная функция $X(t)$ имеет вид:

$$ X(t)=3+V_1 cos wt +V_2 sin wt,$$

где $V_1$ и $V_2$ – некоррелированные случайные величины с математическими ожиданиями, равными нулю, и с дисперсиями $D_1=D_2=3$. Найти математическое ожидание и корреляционную функцию $X(t)$. Определить, является ли $X(t)$ стационарной случайной функцией?

Задача 6. На вход линейной стационарной динамической системы, описываемой данным дифференциальным уравнением, подаётся стационарная случайная функция $Х(t)$ с математическим ожиданием $m_x$ и корреляционной функцией $k_x(tau)$. Найти

1) математическое ожидание;

2) дисперсию случайной функции Y(t) на выходе системы в установившемся режиме.

$$ Y'(t)+3Y(t)=3X'(t)+X(t), , m_x=12, k_x(tau)=e^{-2|tau|}. $$

Мы отлично умеем решать задачи по теории вероятностей

– функция распределения времени пребывания процесса в состоянии

– функция распределения времени пребывания процесса в состоянии  при условии, что следующим состоянием будет

при условии, что следующим состоянием будет

(например,

(например,  при

при  – это означает, что процесс начинается из состояния Е1).

– это означает, что процесс начинается из состояния Е1). из начального состояния;

из начального состояния; за время t;

за время t; .

.